एंट्रॉपी (सूचना सिद्धांत): Difference between revisions

No edit summary |

No edit summary |

||

| (25 intermediate revisions by 3 users not shown) | |||

| Line 3: | Line 3: | ||

{{Information theory}} | {{Information theory}} | ||

[[सूचना सिद्धांत|'''सूचना सिद्धांत''']] में | [[सूचना सिद्धांत|'''सूचना सिद्धांत''']] में चर के संभावित परिणामों में निहित "सूचना", "सरप्राइज" या "अनिश्चितता" का औसत स्तर स्थित है। असतत यादृच्छिक चर <math>X</math> दिया गया है। जो वर्णमाला <math>\mathcal{X}</math> में मान दर्शाता है और <math>p: \mathcal{X}\to[0, 1]</math> के अनुसार वितरित किया जाता है: | ||

<math display="block">\Eta(X) := -\sum_{x \in \mathcal{X}} p(x) \log p(x) = \mathbb{E}[-\log p(X)] ,</math> | <math display="block">\Eta(X) := -\sum_{x \in \mathcal{X}} p(x) \log p(x) = \mathbb{E}[-\log p(X)] ,</math> | ||

जहाँ <math>\Sigma</math> चर के संभावित मानों पर योगात्मक परिणाम को प्रदर्शित करता है। <math>\log</math> के लिए आधार का चुनाव, लघुगणक, विभिन्न अनुप्रयोगों के लिए भिन्न होता है। बेस 2 [[ अंश | | जहाँ <math>\Sigma</math> चर के संभावित मानों पर योगात्मक परिणाम को प्रदर्शित करता है। <math>\log</math> के लिए आधार का चुनाव, लघुगणक, विभिन्न अनुप्रयोगों के लिए भिन्न होता है। बेस 2 [[ अंश |बिट्स]] (या [[ शैनन (इकाई) |शैनन]]) की इकाई प्रदान करता है। जबकि बेस यूलर की संख्या प्राकृतिक इकाइयां नेट (यूनिट) देती है और बेस 10 डीट्स, बैन या [[ हार्टले (इकाई) |हार्टले (इकाई)]] की इकाइयों को प्रदान करता है। एन्ट्रॉपी की एक समतुल्य परिभाषा चर की स्व-सूचना का [[अपेक्षित मूल्य]] है।<ref name="pathriaBook">{{cite book|last1=Pathria|first1=R. K.|url=https://books.google.com/books?id=KdbJJAXQ-RsC|title=सांख्यिकीय यांत्रिकी|last2=Beale|first2=Paul|date=2011|publisher=Academic Press|isbn=978-0123821881|edition=Third|page=51}}</ref> | ||

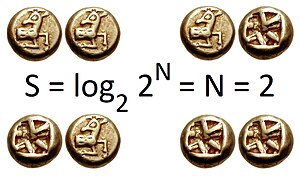

[[File:Entropy flip 2 coins.jpg|thumb|300px| | [[File:Entropy flip 2 coins.jpg|thumb|300px|एन्ट्रॉपी के दो बिट: दो निष्पक्ष सिक्के की स्थिति में बिट्स में सूचना एन्ट्रॉपी संभावित परिणामों की संख्या का आधार-2 लघुगणक है। दो सिक्कों के साथ चार संभावित परिणाम हैं और एंट्रॉपी के दो बिट हैं। सामान्यथः सभी संभावित परिणामों पर विचार करते समय सूचना एन्ट्रॉपी किसी घटना द्वारा दी गई जानकारी की औसत मात्रा होती है।]][[क्लाउड शैनन]] ने अपने 1948 के पेपर [[संचार का एक गणितीय सिद्धांत]] में सूचना एन्ट्रॉपी की अवधारणा को प्रस्तुत किया <ref name="shannonPaper1">{{cite journal|last=Shannon|first=Claude E.|author-link=Claude Shannon|date=July 1948|title=संचार का एक गणितीय सिद्धांत|journal=[[Bell System Technical Journal]]|volume=27|issue=3|pages=379–423|doi=10.1002/j.1538-7305.1948.tb01338.x|hdl-access=free|title-link=संचार का एक गणितीय सिद्धांत|hdl=10338.dmlcz/101429}} ([https://web.archive.org/web/20120615000000*/https://www.alcatel-lucent.com/bstj/vol27-1948/articles/bstj27-3-379.pdf PDF], archived from [http://www.alcatel-lucent.com/bstj/vol27-1948/articles/bstj27-3-379.pdf here])</ref><ref name="shannonPaper2">{{cite journal|last=Shannon|first=Claude E.|author-link=Claude Shannon|date=October 1948|title=संचार का एक गणितीय सिद्धांत|journal=[[Bell System Technical Journal]]|volume=27|issue=4|pages=623–656|doi=10.1002/j.1538-7305.1948.tb00917.x|hdl-access=free|title-link=संचार का एक गणितीय सिद्धांत|hdl=11858/00-001M-0000-002C-4317-B}} ([https://web.archive.org/web/20120615000000*/https://www.alcatel-lucent.com/bstj/vol27-1948/articles/bstj27-4-623.pdf PDF], archived from [http://www.alcatel-lucent.com/bstj/vol27-1948/articles/bstj27-4-623.pdf here])</ref> और इसे एक नये नाम शैनन एंट्रॉपी से भी जाना जाता है। शैनन का सिद्धांत [[डेटा संचार]] प्रणाली के तीन तत्वों से मिलकर बना हुआ है। जो कि निम्न हैं- डेटा का स्रोत, संचार चैनल और एक रिसीवर। जैसा कि शैनन द्वारा प्रदर्शित किया गया है कि संचार की मौलिक कठिनता रिसीवर के लिए यह पहचानने में सक्षम होना है कि चैनल के माध्यम से प्राप्त सिग्नल के आधार पर स्रोत द्वारा कौन सा डेटा उत्पन्न किया गया था।<ref name="shannonPaper1" /><ref name="shannonPaper2" /> शैनन ने डेटा स्रोत से संदेशों को इनकोड, कंप्रेस और ट्रांसमिट करने के विभिन्न प्रकारों पर विचार किया और अपने प्रसिद्ध शैनन के स्रोत कोडिंग प्रमेय में प्रमाणित किया कि एन्ट्रॉपी एक पूर्ण गणितीय सीमा का प्रतिनिधित्व करती है कि स्रोत से डेटा को [[शोर-चैनल कोडिंग प्रमेय|न्वाइस-चैनल]] पर [[दोषरहित|बिना त्रुटि]] रूप से कैसे संकुचित किया जा सकता है। शैनन ने अपने [[शोर-चैनल कोडिंग प्रमेय|न्वाइस-चैनल कोडिंग प्रमेय]] में न्वाइस चैनलों के लिए इस परिणाम को अधिक शक्तिशाली बनाया है। | ||

सूचना सिद्धांत में एन्ट्रॉपी सीधे [[सांख्यिकीय ऊष्मप्रवैगिकी]] में [[एंट्रॉपी (सांख्यिकीय ऊष्मप्रवैगिकी)]] के अनुरूप है। एनालॉगी का परिणाम तब प्रदर्शित होता है, जब यादृच्छिक चर के मान माइक्रोस्टेट्स की ऊर्जा को प्रदान करते हैं। इसलिए | सूचना सिद्धांत में एन्ट्रॉपी सीधे [[सांख्यिकीय ऊष्मप्रवैगिकी]] में [[एंट्रॉपी (सांख्यिकीय ऊष्मप्रवैगिकी)]] के अनुरूप है। एनालॉगी का परिणाम तब प्रदर्शित होता है, जब यादृच्छिक चर के मान माइक्रोस्टेट्स की ऊर्जा को प्रदान करते हैं। इसलिए एन्ट्रॉपी के लिए गिब्स सूत्र औपचारिक रूप से शैनन के सूत्र के समान है। एंट्रॉपी का गणित के अन्य क्षेत्रों जैसे कि [[साहचर्य]] और [[ यंत्र अधिगम |यंत्र अधिगम]] से प्रासंगिकता है। इसकी परिभाषा को [[स्वयंसिद्ध|ऑक्जिओम्स]] के एक समुच्चय से प्राप्त किया जा सकता है। जो यह स्थापित करता है कि एन्ट्रॉपी को इसकी जानकारी होनी चाहिए कि एक चर का औसत परिणाम कितना सूचनात्मक है। निरंतर यादृच्छिक चर के लिए अंतर एन्ट्रॉपी एंट्रॉपी के अनुरूप प्रदर्शित करता है। | ||

== परिचय == | == परिचय == | ||

सूचना सिद्धांत का मूल विचार यह है कि संप्रेषित संदेश का सूचनात्मक मूल्य उस डिग्री पर निर्भर करता है, जिस पर संदेश की सामग्री सरप्राइजलजनक है। यदि अत्यधिक संभावित घटना प्रदर्शित होती है, तो संदेश से बहुत कम जानकारी प्राप्त होती है। दूसरी ओर यदि कोई अत्यधिक असंभावित घटना प्रदर्शित होती है, तो संदेश बहुत अधिक जानकारी से परिपूर्ण होता है। उदाहरण के लिए यह जानकारी कि कोई विशेष संख्या किसी लॉटरी की विजेता संख्या नहीं होगी और बहुत कम जानकारी प्रदान करती है क्योंकि कोई विशेष चुनी गई संख्या लगभग निश्चित रूप से नहीं जीतेगी। चूंकि यह ज्ञान कि एक विशेष संख्या लॉटरी जीतेगी, उच्च सूचनात्मक मूल्य है क्योंकि यह बहुत कम संभावना वाली घटना के परिणाम का संचार करता है। | सूचना सिद्धांत का मूल विचार यह है कि संप्रेषित संदेश का सूचनात्मक मूल्य उस डिग्री पर निर्भर करता है, जिस पर संदेश की सामग्री सरप्राइजलजनक है। यदि अत्यधिक संभावित घटना प्रदर्शित होती है, तो संदेश से बहुत कम जानकारी प्राप्त होती है। दूसरी ओर यदि कोई अत्यधिक असंभावित घटना प्रदर्शित होती है, तो संदेश बहुत अधिक जानकारी से परिपूर्ण होता है। उदाहरण के लिए यह जानकारी कि कोई विशेष संख्या किसी लॉटरी की विजेता संख्या नहीं होगी और बहुत कम जानकारी प्रदान करती है क्योंकि कोई विशेष चुनी गई संख्या लगभग निश्चित रूप से नहीं जीतेगी। चूंकि यह ज्ञान कि एक विशेष संख्या लॉटरी जीतेगी, उच्च सूचनात्मक मूल्य है क्योंकि यह बहुत कम संभावना वाली घटना के परिणाम का संचार करता है। | ||

सूचना सामग्री, जिसे किसी घटना की सरप्राइजलजनक या आत्म-सूचना भी कहा जाता है, <math>E</math> एक ऐसा | सूचना सामग्री, जिसे किसी घटना की सरप्राइजलजनक या आत्म-सूचना भी कहा जाता है, <math>E</math> एक ऐसा फलन है। जो संभावना <math>p(E)</math> के रूप में बढ़ता है और घटना घटित हो जाती है। जब <math>p(E)</math> 1 के निकट होता है। तब घटना का सरप्राइजल कम है। किन्तु यदि <math>p(E)</math> 0 के निकट है, तो घटना का सरप्राइजल अधिक है। इस संबंध को निम्नलिखित फलन द्वारा वर्णित किया गया है- | ||

<math display="block">\log\left(\frac{1}{p(E)}\right) ,</math> | <math display="block">\log\left(\frac{1}{p(E)}\right) ,</math> | ||

जहाँ <math>\log</math> लघुगणक है। जो घटना की संभावना 1 होने पर 0 सरप्राइजल प्रदान करता है।<ref>{{cite web| url = https://www.youtube.com/watch?v=YtebGVx-Fxw| title = एंट्रॉपी (डेटा साइंस के लिए) स्पष्ट रूप से समझाया गया !!!| website = [[YouTube]]}}</ref> | जहाँ <math>\log</math> लघुगणक है। जो घटना की संभावना 1 होने पर 0 सरप्राइजल प्रदान करता है।<ref>{{cite web| url = https://www.youtube.com/watch?v=YtebGVx-Fxw| title = एंट्रॉपी (डेटा साइंस के लिए) स्पष्ट रूप से समझाया गया !!!| website = [[YouTube]]}}</ref> यथार्थ रूप में <math>\log</math> एकमात्र फलन है, जो निस्र्पण के इस विशिष्ट समुच्चय को संतुष्ट करता है। | ||

इसलिए हम किसी घटना की जानकारी या सरप्राइजल को <math>E</math> द्वारा परिभाषित कर सकते हैं। | इसलिए हम किसी घटना की जानकारी या सरप्राइजल को <math>E</math> द्वारा परिभाषित कर सकते हैं। | ||

| Line 22: | Line 22: | ||

या समकक्ष, | या समकक्ष, | ||

<math display="block">I(E) = \log_2\left(\frac{1}{p(E)}\right) .</math> | <math display="block">I(E) = \log_2\left(\frac{1}{p(E)}\right) .</math> | ||

एन्ट्रॉपी एक यादृच्छिक परीक्षण के परिणाम की पहचान करके अपेक्षित (अर्थात औसत) सूचना की मात्रा को मापता है।<ref name="mackay2003">{{cite book |last=MacKay|first=David J.C. |author-link=David J. C. MacKay|url=http://www.inference.phy.cam.ac.uk/mackay/itila/book.html|title=सूचना सिद्धांत, अनुमान और लर्निंग एल्गोरिदम|publisher=Cambridge University Press|year=2003|isbn=0-521-64298-1}}</ref>{{rp|67}} इसका अर्थ यह है कि पासे को फेंकने से सिक्के को उछालने की तुलना में अधिक एंट्रोपी होती है क्योंकि पासे को उछालने के प्रत्येक परिणाम की संभावना कम (लगभग) <math>p=1/6</math>) एक सिक्के के टॉस के प्रत्येक परिणाम की तुलना में (<math>p=1/2</math>) होती है। | |||

एक बायस्ड सिक्के पर विचार करें। जिसमें सिर के होने की प्रायिकता p और पट होने की प्रायिकता 1 - p है। अधिकतम सरप्राइजल तब होता है, जब {{math|''p'' {{=}} 1/2}}, जिसके लिए एक परिणाम दूसरे पर अपेक्षित नहीं है। इस स्थिति में एक सिक्का फ्लिप में एक बिट का एंट्रॉपी होता है। (इसी प्रकार परिवर्तनीय मूल्यों के साथ एक टर्नरी अंक प्रणाली सम्मिलित होता है और <math>\log_2 3</math> (लगभग 1.58496) जानकारी के बिट्स क्योंकि इसमें तीन मानों में से एक हो सकता है।) इसका न्यूनतम सरप्राइजल तब होता है, जब {{math|''p'' {{=}} 0}} या {{math|''p'' {{=}} 1}}, जब घटना का परिणाम समय से पहले प्राप्त किया जाता है और एंट्रॉपी शून्य बिट्स है। जब एन्ट्रॉपी शून्य बिट्स होती है। तो इसे कभी-कभी | एक बायस्ड सिक्के पर विचार करें। जिसमें सिर के होने की प्रायिकता p और पट होने की प्रायिकता 1 - p है। अधिकतम सरप्राइजल तब होता है, जब {{math|''p'' {{=}} 1/2}}, जिसके लिए एक परिणाम दूसरे पर अपेक्षित नहीं है। इस स्थिति में एक सिक्का फ्लिप में एक बिट का एंट्रॉपी होता है। (इसी प्रकार परिवर्तनीय मूल्यों के साथ एक टर्नरी अंक प्रणाली सम्मिलित होता है और <math>\log_2 3</math> (लगभग 1.58496) जानकारी के बिट्स क्योंकि इसमें तीन मानों में से एक हो सकता है।) इसका न्यूनतम सरप्राइजल तब होता है, जब {{math|''p'' {{=}} 0}} या {{math|''p'' {{=}} 1}}, जब घटना का परिणाम समय से पहले प्राप्त किया जाता है और एंट्रॉपी शून्य बिट्स है। जब एन्ट्रॉपी शून्य बिट्स होती है। तो इसे कभी-कभी समानता के रूप में संदर्भित किया जाता है। जहां बिल्कुल भी अनिश्चितता नहीं, पसंद की कोई स्वतंत्रता नहीं औऱ कोई सूचना सामग्री नहीं होती है। ''p'' के अन्य मान शून्य और एक बिट के बीच एंट्रॉपी प्रदान करते हैं। | ||

सूचना सिद्धांत डेटा संपीड़न के रूप में संदेश को संप्रेषित करने के लिए आवश्यक छोटी से छोटी जानकारी की गणना करने के लिए उपयोगी है। उदाहरण के लिए एक बाइनरी चैनल पर 4 अक्षर 'A', 'B', 'C', और 'D' वाले अनुक्रमों के प्रसारण पर विचार करें। यदि सभी 4 अक्षर समान रूप से (25%) होने की प्रायिकता है। तो प्रत्येक अक्षर को एन्कोड करने के लिए दो बिट्स का उपयोग करने से अच्छा नहीं हो सकता है। 'A' को '00', 'B' को '01', 'C' को '10' और 'D' को '11' लिखा जा सकता है। चूंकि यदि प्रत्येक अक्षर की | सूचना सिद्धांत डेटा संपीड़न के रूप में संदेश को संप्रेषित करने के लिए आवश्यक छोटी से छोटी जानकारी की गणना करने के लिए उपयोगी है। उदाहरण के लिए एक बाइनरी चैनल पर 4 अक्षर 'A', 'B', 'C', और 'D' वाले अनुक्रमों के प्रसारण पर विचार करें। यदि सभी 4 अक्षर समान रूप से (25%) होने की प्रायिकता है। तो प्रत्येक अक्षर को एन्कोड करने के लिए दो बिट्स का उपयोग करने से अच्छा नहीं हो सकता है। 'A' को '00', 'B' को '01', 'C' को '10' और 'D' को '11' लिखा जा सकता है। चूंकि यदि प्रत्येक अक्षर की प्रायिकताएं असमान हैं। तो 'A' 70% प्रायिकता के साथ होता है, 'B' 26% के साथ होता है और 'C' और 'D' प्रत्येक 2% के साथ होता है और कोई चर लंबाई कोड असाइन कर सकता है। इस स्थिति में 'A' को '0', 'B' को '10', 'C' को '110' और D को '111' के रूप में कोडित किया जाएगा। इस प्रतिनिधित्व के साथ 70% समय केवल एक बिट 26% समय दो बिट्स और केवल 4% समय 3 बिट्स भेजने की आवश्यकता होती है। एंट्रॉपी कम होने के कारण औसतन 2 बिट्स से कम की आवश्यकता होती है ('A' के उच्च प्रसार के बाद 'B' एक साथ 96% अक्षर)। प्रायिकता-भारित लॉग संभावनाओं के योग की गणना इस प्रभाव को मापती है और कैप्चर करती है। अंग्रेजी के टेक्स्ट में वर्णों की एक स्ट्रिंग के रूप में माना जाता है। इसमें बहुत कम एन्ट्रॉपी होती है अर्थात अधिक अनुमानित होता है। हम अधिक निश्चित हो सकते हैं कि उदाहरण के लिए 'e' 'z' की तुलना में कहीं अधिक सामान्य होगा, संयोजन 'qu' किसी भी अन्य संयोजन की तुलना में 'q' के साथ कहीं अधिक सामान्य होगा और यह कि संयोजन 'th' 'z', 'q', या 'qu' से अधिक सामान्य होगा। पहले कुछ अक्षरों के बाद अधिकांशतः शेष शब्द का अनुमान लगाया जा सकता है। अंग्रेजी टेक्स्ट में संदेश के प्रति वर्ण 0.6 और 1.3 बिट एंट्रॉपी के बीच स्थित होती है।<ref name="Schneier, B page 234">Schneier, B: ''Applied Cryptography'', Second edition, John Wiley and Sons.</ref>{{rp|234}} | ||

== परिभाषा == | == परिभाषा == | ||

बोल्ट्ज़मैन के Η-प्रमेय के नाम पर रखा गया | बोल्ट्ज़मैन के Η-प्रमेय के नाम पर रखा गया है। शैनन ने [[असतत यादृच्छिक चर]] <math display="inline">X</math> का एन्ट्रॉपी {{math|Η}} के द्वारा परिभाषित किया (ग्रीक कैपिटल लेटर ईटीए)। जो वर्णमाला में <math>\mathcal{X}</math> मान प्रयुक्त करता है और <math>p: \mathcal{X} \to [0, 1]</math> के अनुसार वितरित किया जाता है। ऐसा प्रदर्शित होता है कि <math>p(x) := \mathbb{P}[X = x]</math>: | ||

<math display="block">\Eta(X) = \mathbb{E}[\operatorname{I}(X)] = \mathbb{E}[-\log p(X)].</math> | <math display="block">\Eta(X) = \mathbb{E}[\operatorname{I}(X)] = \mathbb{E}[-\log p(X)].</math> | ||

यहाँ <math>\mathbb{E}</math> अपेक्षित | यहाँ <math>\mathbb{E}</math> अपेक्षित वैल्यू ऑपरेटर है और {{math|I}}, सूचना सामग्री {{math|''X''}} की जानकारी प्रदान करता है।<ref>{{cite book|author=Borda, Monica|title=सूचना सिद्धांत और कोडिंग में बुनियादी बातों|publisher=Springer|year=2011|isbn=978-3-642-20346-6|url=https://books.google.com/books?id=Lyte2yl1SPAC&pg=PA11}}</ref>{{rp|11}}<ref>{{cite book|authors=Han, Te Sun & Kobayashi, Kingo|title=सूचना और कोडिंग का गणित|publisher=American Mathematical Society|year=2002|isbn=978-0-8218-4256-0|url=https://books.google.com/books?id=VpRESN24Zj0C&pg=PA19}}</ref>{{rp|19–20}} | ||

<math>\operatorname{I}(X)</math> स्वयं एक यादृच्छिक चर है। | <math>\operatorname{I}(X)</math> स्वयं एक यादृच्छिक चर है। | ||

एन्ट्रॉपी को स्पष्ट रूप से इस प्रकार लिखा जा सकता है: | |||

<math display="block">\Eta(X) = -\sum_{x \in \mathcal{X}} p(x)\log_b p(x) ,</math> | <math display="block">\Eta(X) = -\sum_{x \in \mathcal{X}} p(x)\log_b p(x) ,</math>जहाँ {{math|''b''}} प्रयुक्त लघुगणक का [[आधार (घातांक)]] है। {{math|''b''}} की सामान्य वैल्यू 2 हैं। यूलर की संख्या (गणितीय स्थिरांक) {{math|''e''}} और 10 और एन्ट्रॉपी की संबंधित इकाइयां [[ बिट (इकाई) |बिट (इकाई) {{math|''b'' {{=}} 2}}]] के लिए हैं, नेट (यूनिट) के लिए {{math|''b'' {{=}} ''e''}} और प्रतिबंध (यूनिट) के लिए {{math|''b'' {{=}} 10}} हैं।<ref>Schneider, T.D, [http://alum.mit.edu/www/toms/paper/primer/primer.pdf Information theory primer with an appendix on logarithms], National Cancer Institute, 14 April 2007.</ref><math>p(x) = 0</math> की स्थिति में कुछ <math>x \in \mathcal{X}</math> के लिए, संगत योग {{math|0 log<sub>''b''</sub>(0)}} का मान 0 माना जाता है। जो किसी फलन की निर्धारित सीमा के अनुरूप है:<ref name="cover1991" />{{rp|13}} | ||

जहाँ {{math|''b''}} प्रयुक्त लघुगणक का [[आधार (घातांक)]] है। {{math|''b''}} की सामान्य वैल्यू 2 हैं। यूलर की संख्या (गणितीय स्थिरांक) {{math|''e''}} और 10 और एन्ट्रॉपी की संबंधित इकाइयां [[ बिट (इकाई) |बिट (इकाई) {{math|''b'' {{=}} 2}}]] के लिए हैं, नेट (यूनिट) के लिए {{math|''b'' {{=}} ''e''}} और प्रतिबंध (यूनिट) के लिए {{math|''b'' {{=}} 10}} | <math display="block">\lim_{p\to0^+}p\log (p) = 0.</math>कोई दो चरों <math>X</math> की [[सशर्त एन्ट्रापी|नियम के अनुसार एन्ट्रॉपी]] को भी परिभाषित कर सकता है और <math>Y</math> क्रमशः समुच्चय <math>\mathcal{X}</math> और <math>\mathcal{Y}</math> से मान प्राप्त करता है। जैसे:<ref name="cover1991" />{{rp|16}} | ||

<math display="block"> \Eta(X|Y)=-\sum_{x,y \in \mathcal{X} \times \mathcal{Y}} p_{X,Y}(x,y)\log\frac{p_{X,Y}(x,y)}{p_Y(y)} ,</math>जहाँ <math>p_{X,Y}(x,y) := \mathbb{P}[X=x,Y=y]</math> और <math>p_Y(y) = \mathbb{P}[Y = y]</math> इस मात्रा को यादृच्छिक चर <math>X</math> में शेष यादृच्छिकता <math>Y</math> के रूप में समझा जाना चाहिए। | |||

=== [[माप सिद्धांत|<u>माप सिद्धांत</u>]]- === | |||

== | माप सिद्धांत की भाषा में एंट्रॉपी को औपचारिक रूप से निम्नानुसार परिभाषित किया जा सकता है:<ref>{{nlab|id=entropy|title=Entropy}}</ref> माना कि <math>(X, \Sigma, \mu)</math> एक [[संभाव्यता स्थान|प्रायिकता स्थान]] प्राप्त होता है। माना कि <math>A \in \Sigma</math> एक घटना (प्रायिकता सिद्धांत) हो। तब <math>A</math> का [[आश्चर्य|सरप्राइजल]] है- | ||

<math display="block"> \sigma_\mu(A) = -\ln \mu(A) .</math><math>A</math> का अपेक्षित सरप्राइजल है- | |||

<math display="block"> h_\mu(A) = \mu(A) \sigma_\mu(A) .</math><math>\mu</math>-एक समुच्चय का लगभग विभाजन एक [[सेट परिवार|समुच्चय फैमली]] <math>P \subseteq \mathcal{P}(X)</math> है। ऐसा है कि <math>\mu(\mathop{\cup} P) = 1</math> और <math>\mu(A \cap B) = 0</math> सभी विशिष्ट के लिए <math>A, B \in P</math>. (यह एक विभाजन के लिए सामान्य स्थितियों की छूट है।) <math>P</math> की एन्ट्रॉपी है- | |||

<math display="block"> \Eta_\mu(P) = \sum_{A \in P} h_\mu(A) .</math>माना कि <math>X</math> पर <math>M</math> एक [[सिग्मा-बीजगणित]] बनें। तब <math>M</math> की एन्ट्रॉपी है- | |||

<math display="block"> \Eta_\mu(M) = \sup_{P \subseteq M} \Eta_\mu(P) .</math>अंत में प्रायिकता स्थान की एन्ट्रॉपी <math>\Eta_\mu(\Sigma)</math> है। जो कि <math>\mu</math> के संबंध में एन्ट्रॉपी के सभी मापने योग्य उपसमुच्चयों के सिग्मा-बीजगणित का <math>X</math> के मान को प्रदर्शित करता है। | |||

<math display="block"> \Eta_\mu(P) = \sum_{A \in P} h_\mu(A) .</math> | |||

माना कि <math>X</math> पर <math>M</math> एक [[सिग्मा-बीजगणित]] बनें। <math>M</math> की | |||

<math display="block"> \Eta_\mu(M) = \sup_{P \subseteq M} \Eta_\mu(P) .</math> | |||

अंत में | |||

=== एलरमैन की परिभाषा === | === एलरमैन की परिभाषा === | ||

[[डेविड एलरमैन]] यह व्याख्या करना चाहते थे कि क्यों नियमानुसार एन्ट्रॉपी और अन्य फलनों में प्रायिकता सिद्धांत में फलनों के समान गुण होते हैं। उनका प्रमाण है कि माप सिद्धांत पर आधारित | [[डेविड एलरमैन]] यह व्याख्या करना चाहते थे कि क्यों नियमानुसार एन्ट्रॉपी और अन्य फलनों में प्रायिकता सिद्धांत में फलनों के समान गुण प्रदर्शित होते हैं। उनका प्रमाण यह है कि माप सिद्धांत पर आधारित पूर्व ज्ञात परिभाषाएँ केवल 2 की घात के साथ कार्य करती हैं।<ref>{{cite journal |last1=Ellerman |first1=David |title=Logical Information Theory: New Logical Foundations for Information Theory |journal=Logic Journal of the IGPL |date=October 2017 |volume=25 |issue=5 |pages=806–835 |doi=10.1093/jigpal/jzx022 |url=http://philsci-archive.pitt.edu/13213/1/Logic-to-information-theory3.pdf |access-date=2 November 2022}}</ref> | ||

एलरमैन ने विभाजन का एक तर्क | एलरमैन ने विभाजन का एक तर्क बनाया। जो एक यूनिवर्सल समुच्चय के उपसमुच्चय का [[द्वैत (गणित)]] है। सूचना को "डिट्स" (भेद) विभाजन पर एक उपाय के रूप में परिमाणित किया जाता है। कन्डिशनल एन्ट्रॉपी आदि के सूत्र को प्राप्त करने के लिए "डिट्स" को शैनन के बिट्स में सरलतम प्रकार से परिवर्तित किया जा सकता है। | ||

== उदाहरण == | == उदाहरण == | ||

{{Main|बाइनरी एन्ट्रापी फलन|बरनौली प्रक्रिया}} | {{Main|बाइनरी एन्ट्रापी फलन|बरनौली प्रक्रिया}} | ||

ज्ञात के साथ एक सिक्का उछालने पर विचार | ज्ञात प्रायिकताओँ के साथ एक सिक्का उछालने पर विचार करें। आवश्यक नहीं है कि यह हेड या टेल आने की प्रायिकताएं उचित हों। इसे बर्नौली प्रक्रिया के रूप में तैयार किया जा सकता है। | ||

सिक्के के अगले टॉस के अज्ञात परिणाम की | सिक्के के अगले टॉस के अज्ञात परिणाम की एन्ट्रॉपी अधिकतम हो जाती है। यदि सिक्का उचित है (अर्थात, यदि हेड और टेल दोनों की समान संभावना 1/2 है)। यह अधिकतम अनिश्चितता की स्थिति है क्योंकि अगले टॉस के परिणाम की भविष्यवाणी करना सबसे कठिन है। सिक्के के प्रत्येक टॉस का परिणाम एक पूरी जानकारी प्रदान करता है। यह प्रायिकताएं प्रदर्शित करती है क्योंकि- | ||

<math display="block">\begin{align} | <math display="block">\begin{align} | ||

\Eta(X) &= -\sum_{i=1}^n {p(x_i) \log_b p(x_i)} | \Eta(X) &= -\sum_{i=1}^n {p(x_i) \log_b p(x_i)} | ||

| Line 75: | Line 68: | ||

\\ &= -\sum_{i=1}^2 {\frac{1}{2} \cdot (-1)} = 1 | \\ &= -\sum_{i=1}^2 {\frac{1}{2} \cdot (-1)} = 1 | ||

\end{align}</math> | \end{align}</math> | ||

चूंकि यदि हम जानते हैं कि सिक्का उचित नहीं है, किन्तु संभावनाओं p और q के साथ हेड या टेल आता है। जहाँ {{math|''p'' ≠ ''q''}}, तो | चूंकि यदि हम जानते हैं कि सिक्का उचित नहीं है, किन्तु संभावनाओं p और q के साथ हेड या टेल आता है। जहाँ {{math|''p'' ≠ ''q''}}, तो अनिश्चिततायें कम प्राप्क होती है। प्रत्येक स्थिति में जब इसे उछाला जाता है। तो एक पक्ष के दूसरे की तुलना में ऊपर आने की प्रायिकता अधिक होती है। घटी हुई अनिश्चितता को कम एन्ट्रॉपी में परिमाणित किया जाता है। औसतन सिक्के का प्रत्येक टॉस एक पूर्ण बिट से कम सूचना प्रदान करता है। उदाहरण के लिए यदि {{math|''p''}} = 0.7, फिर- | ||

<math display="block">\begin{align} | <math display="block">\begin{align} | ||

\Eta(X) &= - p \log_2 (p) - q \log_2 (q) | \Eta(X) &= - p \log_2 (p) - q \log_2 (q) | ||

| Line 82: | Line 75: | ||

\\ &= 0.8816 < 1 | \\ &= 0.8816 < 1 | ||

\end{align}</math> | \end{align}</math> | ||

समान प्रायिकता अधिकतम अनिश्चितता और | समान प्रायिकता अधिकतम अनिश्चितता प्रदर्शित होती है और इस कारण अधिकतम एन्ट्रॉपी उत्पन्न करती है। एन्ट्रॉपी तब केवल एकसमान प्रायिकता से जुड़े मूल्य से घट सकती है। उच्च स्थिति एक दो हेड वाले सिक्के का है। जो कभी भी टेल नहीं आता है या एक दो टेल वाला सिक्का है। जिसके परिणामस्वरूप कभी भी हेड नहीं आता है। फिर कोई अनिश्चितता प्राप्त नहीं होती है। एन्ट्रॉपी शून्य है। सिक्के का प्रत्येक टॉस कोई नई जानकारी नहीं देता है क्योंकि प्रत्येक सिक्के के टॉस का परिणाम सदैव निश्चित होता है।<ref name=cover1991/>{{rp|14–15}} | ||

सूचना की लंबाई से विभाजित करके | सूचना की लंबाई से विभाजित करके एन्ट्रॉपी को सामान्य किया जा सकता है। इस अनुपात को [[मीट्रिक एन्ट्रापी|मीट्रिक एन्ट्रॉपी]] भी कहा जाता है और यह सूचना की यादृच्छिकता का एक प्रमुख उपाय है। | ||

== लक्षण विवरण == | == लक्षण का विवरण == | ||

{{math|−Σ ''p''<sub>''i''</sub> log(''p''<sub>''i''</sub>)}} का अर्थ समझने के लिए पहले एक सूचना फलन | {{math|−Σ ''p''<sub>''i''</sub> log(''p''<sub>''i''</sub>)}} का अर्थ समझने के लिए पहले एक सूचना फलन {{math|I}} को घटना {{math|''i''}} के संदर्भ में {{math|''p''<sub>''i''</sub>}} प्रायिकता के साथ परिभाषित करें। घटना के अवलोकन के कारण प्राप्त जानकारी की मात्रा {{math|''i''}} सूचना सामग्री के मूलभूत गुणों के शैनन के समाधान से अनुसरण करता है:<ref>{{cite book |last=Carter |first=Tom |date=March 2014|title=सूचना सिद्धांत और एन्ट्रॉपी का परिचय|url= http://csustan.csustan.edu/~tom/Lecture-Notes/Information-Theory/info-lec.pdf|location=Santa Fe|access-date=4 August 2017}}</ref> | ||

# {{math|I(''p'')}} {{math|''p''}} में [[नीरस रूप से घट रहा है|मोनोटोनिकल रूप से घट रहा है]] : किसी घटना की संभावना में वृद्धि किसी प्रेक्षित घटना से सूचना को कम करती है और इसके विपरीत भी घटनायें घटित होती हैं। | # {{math|I(''p'')}} {{math|''p''}} में [[नीरस रूप से घट रहा है|मोनोटोनिकल रूप से घट रहा है]] : किसी घटना की संभावना में वृद्धि किसी प्रेक्षित घटना से सूचना को कम करती है और इसके विपरीत भी घटनायें घटित होती हैं। | ||

# {{math|I(1) {{=}} 0}}: सदैव घटित होने वाली घटनाएँ सूचनाओं का आदान-प्रदान नहीं करती हैं। | # {{math|I(1) {{=}} 0}}: सदैव घटित होने वाली घटनाएँ सूचनाओं का आदान-प्रदान नहीं करती हैं। | ||

# {{math|I(''p''<sub>1</sub>·''p''<sub>2</sub>) {{=}} I(''p''<sub>1</sub>) + I(''p''<sub>2</sub>)}}: स्वतंत्र घटनाओं से सीखी गई जानकारी प्रत्येक घटना से सीखी गई जानकारी का योगात्मक रूप होता है। | # {{math|I(''p''<sub>1</sub>·''p''<sub>2</sub>) {{=}} I(''p''<sub>1</sub>) + I(''p''<sub>2</sub>)}}: स्वतंत्र घटनाओं से सीखी गई जानकारी प्रत्येक घटना से सीखी गई जानकारी का योगात्मक रूप होता है। | ||

दो स्वतंत्र घटनाओं को देखते हुए यदि पहली घटना n | दो स्वतंत्र घटनाओं को देखते हुए, यदि पहली घटना n सम-संभाव्य परिणामों में से एक उत्पन्न कर सकती है और दूसरी में m सम-संभाव्य परिणामों में से एक है। तो संयुक्त घटना के ''mn'' परिवर्तनीय परिणाम हैं। इसका अर्थ यह है कि यदि {{math|log<sub>2</sub>(''n'')}} बिट्स को पहले मान को एनकोड करने की आवश्यकता होती है और {{math|log<sub>2</sub>(''m'')}} दूसरे को सांकेतिक शब्दों में बदलने के लिए {{math|log<sub>2</sub>(''mn'') {{=}} log<sub>2</sub>(''m'') + log<sub>2</sub>(''n'')}} दोनों को एनकोड करने के लिए एक की आवश्यकता होती है। | ||

शैनन ने अपने सिद्धांत में पाया कि एक उपयुक्त विकल्प <math>\operatorname{I}</math> द्वारा प्रदर्शित किया गया है:<ref>Chakrabarti, C. G., and Indranil Chakrabarty. "Shannon entropy: axiomatic characterization and application." International Journal of Mathematics and Mathematical Sciences 2005.17 (2005): 2847-2854 [https://arxiv.org/pdf/quant-ph/0511171.pdf url]</ref> | |||

<math display="block">\operatorname{I}(p) = \log\left(\tfrac{1}{p}\right) = -\log(p)</math>यथार्थ रूप में <math>\operatorname{I}(u) = k \log u</math> के लिए <math>k<0</math> के केवल संभव वैल्यू <math>\operatorname{I}</math> हैं। इसके अतिरिक्त <math>x>1</math> के लिए <math>k = - 1/\log x</math> के लिए एक मान चुनना {{math|''k''}} मान चुनने के समान है। जिससे {{math|''x''}} लघुगणक के आधार से संबंधित है। इस प्रकार उपरोक्त चार गुणों द्वारा एन्ट्रॉपी [[लक्षण वर्णन (गणित)|लक्षण का वर्णन (गणित)]] है। | |||

:{| class="toccolours collapsible collapsed" width="80%" style="text-align:left" | :{| class="toccolours collapsible collapsed" width="80%" style="text-align:left" | ||

!Proof | !Proof | ||

| Line 113: | Line 104: | ||

This [[differential equation]] leads to the solution <math>\operatorname{I}(u) = k \log u + c</math> for some <math>k, c \in \mathbb{R}</math>. Property 2 gives <math>c = 0</math>. Property 1 and 2 give that <math>\operatorname{I}(p)\ge 0</math> for all <math>p\in [0,1]</math>, so that <math>k < 0</math>. | This [[differential equation]] leads to the solution <math>\operatorname{I}(u) = k \log u + c</math> for some <math>k, c \in \mathbb{R}</math>. Property 2 gives <math>c = 0</math>. Property 1 and 2 give that <math>\operatorname{I}(p)\ge 0</math> for all <math>p\in [0,1]</math>, so that <math>k < 0</math>. | ||

|} | |} | ||

सूचना की विभिन्न इकाइयां ([[द्विआधारी लघुगणक]] के लिए बिट्स {{math|log<sub>2</sub>}}, नेट (यूनिट) [[प्राकृतिक]] लघुगणक के लिए {{math|ln}}, [[दशमलव लघुगणक]] के लिए प्रतिबंध (इकाई) | सूचना की विभिन्न इकाइयां ([[द्विआधारी लघुगणक]] के लिए बिट्स {{math|log<sub>2</sub>}}, नेट (यूनिट) [[प्राकृतिक]] लघुगणक के लिए {{math|ln}}, [[दशमलव लघुगणक]] के लिए प्रतिबंध (इकाई) {{math|log<sub>10</sub>}} और इसी प्रकार) एक दूसरे के [[आनुपातिकता (गणित)]] होती हैं। उदाहरण के लिए एक निष्पक्ष सिक्के के टॉस के स्थिति में हेड {{math|log<sub>2</sub>(2) {{=}} 1}} बिट जानकारी प्रदान करता है। जो लगभग 0.693 नेट्स या 0.301 दशमलव अंक है। योगात्मकता के कारण, n टॉस जानकारी के n बिट्स प्रदान करते हैं। जो लगभग 0.693n नेट्स या 0.301n दशमलव अंक हैं। | ||

देखी गई घटनाओं का अर्थ (संदेशों का अर्थ) एंट्रॉपी की परिभाषा में कोई अन्य अर्थ नहीं प्रदान करती हैं। एन्ट्रॉपी केवल एक विशिष्ट घटना को देखने की | देखी गई घटनाओं का अर्थ (संदेशों का अर्थ) एंट्रॉपी की परिभाषा में कोई अन्य अर्थ नहीं प्रदान करती हैं। एन्ट्रॉपी केवल एक विशिष्ट घटना को देखने की प्रायिकता को ध्यान में रखता है। इसलिए यह जो जानकारी प्राप्त करता है। वह अंतर्निहित प्रायिकता वितरण के विषय में जानकारी है, न कि स्वयं घटनाओं के अर्थ की जानकारी प्रदान करता है। | ||

=== वैकल्पिक लक्षण वर्णन === | === वैकल्पिक लक्षण वर्णन === | ||

एंट्रॉपी का एक और लक्षण वर्णन निम्नलिखित गुणों का उपयोग करता है। हम {{math|''p''<sub>''i''</sub> {{=}} Pr(''X'' {{=}} ''x''<sub>''i''</sub>)}} और {{math|Η<sub>''n''</sub>(''p''<sub>1</sub>, ..., ''p''<sub>''n''</sub>) {{=}} Η(''X'')}} निरूपित करते हैं। | एंट्रॉपी का एक और लक्षण वर्णन निम्नलिखित गुणों का उपयोग करता है। हम {{math|''p''<sub>''i''</sub> {{=}} Pr(''X'' {{=}} ''x''<sub>''i''</sub>)}} और {{math|Η<sub>''n''</sub>(''p''<sub>1</sub>, ..., ''p''<sub>''n''</sub>) {{=}} Η(''X'')}} निरूपित करते हैं। | ||

# निरंतरता: | # निरंतरता: [[निरंतर कार्य|निरंतर फलन]] {{math|H}} होना चाहिए। जिससे बहुत कम मात्रा में प्रायिकताओं के मूल्यों को बदलने से एन्ट्रॉपी को केवल थोड़ी मात्रा में बदलना चाहिए। | ||

# समरूपता: {{math|H}} | # समरूपता: परिणाम {{math|H}} अपरिवर्तित होना चाहिए और {{math|''x''<sub>''i''</sub>}} को पुनः आदेश दिया जाता है। वह किसी क्रम[[परिवर्तन]] के लिए <math>\{i_1, ..., i_n\}</math> का <math>\{1, ..., n\}</math> <math>\Eta_n\left(p_1, p_2, \ldots p_n \right) = \Eta_n\left(p_{i_1}, p_{i_2}, \ldots, p_{i_n} \right)</math> है। | ||

# अधिकतम: <math>\Eta_n</math> अधिकतम होना चाहिए। यदि सभी परिणाम समान रूप से होने की | # अधिकतम: <math>\Eta_n</math> अधिकतम होना चाहिए। यदि सभी परिणाम समान रूप से होने की प्रायिकता है अर्थात <math>\Eta_n(p_1,\ldots,p_n) \le \Eta_n\left(\frac{1}{n}, \ldots, \frac{1}{n}\right)</math>. | ||

# परिणामों की बढ़ती संख्या: परिवर्तनीय घटनाओं के लिए एंट्रॉपी को परिणामों की संख्या के साथ बढ़ाना चाहिए अर्थात <math>\Eta_n\bigg(\underbrace{\frac{1}{n}, \ldots, \frac{1}{n}}_{n}\bigg) < \Eta_{n+1}\bigg(\underbrace{\frac{1}{n+1}, \ldots, \frac{1}{n+1}}_{n+1}\bigg).</math> | # परिणामों की बढ़ती संख्या: परिवर्तनीय घटनाओं के लिए एंट्रॉपी को परिणामों की संख्या के साथ बढ़ाना चाहिए अर्थात <math>\Eta_n\bigg(\underbrace{\frac{1}{n}, \ldots, \frac{1}{n}}_{n}\bigg) < \Eta_{n+1}\bigg(\underbrace{\frac{1}{n+1}, \ldots, \frac{1}{n+1}}_{n+1}\bigg).</math> | ||

# एडीटीविटी: ''n'' समान रूप से वितरित तत्वों का एक समूह दिया गया है। जो ''b''<sub>1</sub>, ..., ''b<sub>k</sub>'' तत्वों के साथ के बॉक्स (उप-प्रणालियों) में बांटा गया है, | # एडीटीविटी: ''n'' समान रूप से वितरित तत्वों का एक समूह दिया गया है। जो ''b''<sub>1</sub>, ..., ''b<sub>k</sub>'' तत्वों के साथ के बॉक्स (उप-प्रणालियों) में बांटा गया है, सम्पूर्ण एंट्रॉपी बॉक्स की प्रणाली के एन्ट्रॉपी के योग के बराबर होनी चाहिए और बक्सों की अलग-अलग एन्ट्रॉपी, प्रत्येक को उस विशेष बॉक्स में होने की संभावना के साथ प्रयुक्त किया जाता है। | ||

योगात्मकता के नियम के निम्नलिखित परिणाम होते हैं: धनात्मक पूर्णांकों के लिए {{math|''b''<sub>''i''</sub>}}, जहाँ {{math|''b''<sub>1</sub> + ... + ''b''<sub>''k''</sub> {{=}} ''n''}}, | योगात्मकता के नियम के निम्नलिखित परिणाम होते हैं: धनात्मक पूर्णांकों के लिए {{math|''b''<sub>''i''</sub>}}, जहाँ {{math|''b''<sub>1</sub> + ... + ''b''<sub>''k''</sub> {{=}} ''n''}}, | ||

:<math>\Eta_n\left(\frac{1}{n}, \ldots, \frac{1}{n}\right) = \Eta_k\left(\frac{b_1}{n}, \ldots, \frac{b_k}{n}\right) + \sum_{i=1}^k \frac{b_i}{n} \, \Eta_{b_i}\left(\frac{1}{b_i}, \ldots, \frac{1}{b_i}\right).</math> | :<math>\Eta_n\left(\frac{1}{n}, \ldots, \frac{1}{n}\right) = \Eta_k\left(\frac{b_1}{n}, \ldots, \frac{b_k}{n}\right) + \sum_{i=1}^k \frac{b_i}{n} \, \Eta_{b_i}\left(\frac{1}{b_i}, \ldots, \frac{1}{b_i}\right).</math> | ||

''k'' = ''n'', ''b''<sub>1</sub> = ... = ''b<sub>n</sub>'' = 1 का चयन करना इसका तात्पर्य है कि एक निश्चित परिणाम की एंट्रॉपी शून्य है। इसका तात्पर्य यह है कि एक निश्चित परिणाम की एंट्रॉपी | ''k'' = ''n'', ''b''<sub>1</sub> = ... = ''b<sub>n</sub>'' = 1 का चयन करना, इसका तात्पर्य है कि एक निश्चित परिणाम की एंट्रॉपी शून्य है। इसका तात्पर्य यह है कि एक निश्चित परिणाम की एंट्रॉपी {{math|Η<sub>1</sub>(1) {{=}} 0}} शून्य है। इसका तात्पर्य है कि स्रोत वर्णमाला की दक्षता {{math|''n''}} प्रतीकों को इसके बराबर होने के रूप में परिभाषित किया जा सकता है। यह {{math|''n''}}-एरी एन्ट्रॉपी को दर्शाता है। [[अतिरेक (सूचना सिद्धांत)]] भी देखें। | ||

'''<u><big>एडिटिविटी और | '''<u><big>एडिटिविटी और सब-एडिटिविटी के माध्यम से वैकल्पिक लक्षणों का वर्णन-</big></u>''' | ||

शैनन एन्ट्रॉपी का एक और संक्षिप्त स्वयंसिद्ध लक्षण वर्णन जानोस_एक्ज़ेल_(गणितज्ञ)|एक्ज़ेल, फोर्ट और एनजी द्वारा दिया गया था।<ref name="aczelentropy">{{cite journal|last1=Aczél|first1=J.|title=क्यों शैनन और हार्टले एन्ट्रापी 'प्राकृतिक' हैं|last2=Forte|first2=B.|last3=Ng|first3=C. T.|journal=Advances in Applied Probability|date=1974|volume=6|issue=1|page=131-146|doi=10.2307/1426210 |jstor=1426210 |s2cid=204177762 }}</ref> निम्नलिखित गुणों के माध्यम से: | शैनन एन्ट्रॉपी का एक और संक्षिप्त स्वयंसिद्ध लक्षण वर्णन जानोस_एक्ज़ेल_(गणितज्ञ)|एक्ज़ेल, फोर्ट और एनजी द्वारा दिया गया था।<ref name="aczelentropy">{{cite journal|last1=Aczél|first1=J.|title=क्यों शैनन और हार्टले एन्ट्रापी 'प्राकृतिक' हैं|last2=Forte|first2=B.|last3=Ng|first3=C. T.|journal=Advances in Applied Probability|date=1974|volume=6|issue=1|page=131-146|doi=10.2307/1426210 |jstor=1426210 |s2cid=204177762 }}</ref> निम्नलिखित गुणों के माध्यम से: | ||

# उप-विषमता: | # उप-विषमता: <math>\Eta(X,Y) \le \Eta(X)+\Eta(Y)</math> संयुक्त रूप से वितरित यादृच्छिक चर के लिए <math>X,Y</math>. | ||

# एडिटिविटी: | # एडिटिविटी: <math>\Eta(X,Y) = \Eta(X)+\Eta(Y)</math> जब यादृच्छिक चर <math>X,Y</math> स्वतंत्र हैं। | ||

# विस्तारशीलता: | # विस्तारशीलता: <math>\Eta_{n+1}(p_1, \ldots, p_n, 0) = \Eta_n(p_1, \ldots, p_n)</math>, अर्थात प्रायिकता शून्य के साथ एक परिणाम जोड़ने से एंट्रॉपी नहीं बदलती है। | ||

# समरूपता: <math>\Eta_n(p_1, \ldots, p_n)</math> के क्रमपरिवर्तन के | # समरूपता: <math>\Eta_n(p_1, \ldots, p_n)</math> के क्रमपरिवर्तन के अनुसार अपरिवर्तनीय है <math>p_1, \ldots, p_n</math>. | ||

# छोटी संभावनाओं के लिए छोटा: | # छोटी संभावनाओं के लिए छोटा: <math>\lim_{q \to 0^+} \Eta_2(1-q, q) = 0</math>. | ||

यह | यह प्रदर्शित किया गया था कि कोई भी फलन <math>\Eta</math> उपर्युक्त गुणों को संतुष्ट करना एक गैर-ऋणात्मक स्थिरांक के साथ शैनन एंट्रॉपी का निरंतर गुणक होना चाहिए।<ref name="aczelentropy"/>एंट्रॉपी के पहले वर्णित लक्षणों की तुलना में, यह लक्षण वर्णन संभावना वेक्टर के एक फलन के रूप में एंट्रॉपी के गुणों के अतिरिक्त यादृच्छिक चर (उप-विषमता और योगात्मकता) के एक फलन के रूप में एंट्रॉपी के गुणों पर केंद्रित है। <math>p_1,\ldots ,p_n</math>. | ||

यह ध्यान देने योग्य है कि यदि हम छोटी संभावनाओं के लिए छोटी संपत्ति को छोड़ देते | यह ध्यान देने योग्य है कि यदि हम छोटी संभावनाओं के लिए छोटी संपत्ति को छोड़ देते हैं। जिससे <math>\Eta</math> शैनन एंट्रॉपी और [[हार्टले एंट्रॉपी]] का एक गैर-श्रणात्मक रैखिक संयोजन होना चाहिए।<ref name="aczelentropy"/> | ||

== | == अन्य गुण == | ||

शैनन | शैनन एन्ट्रॉपी निम्नलिखित गुणों को संतुष्ट करती है। जिनमें से कुछ के लिए एन्ट्रॉपी की व्याख्या करना उपयोगी होता है क्योंकि एक यादृच्छिक चर के मान को प्रकट करके सीखी गई जानकारी की अपेक्षित मात्रा (या अनिश्चितता समाप्त हो जाती है) {{math|''X''}} हो तो: | ||

* प्रायिकता शून्य के साथ किसी घटना को जोड़ना या हटाना एन्ट्रॉपी में योगदान नहीं देता है: | * प्रायिकता शून्य के साथ किसी घटना को जोड़ना या हटाना एन्ट्रॉपी में योगदान नहीं देता है: | ||

::<math>\Eta_{n+1}(p_1,\ldots,p_n,0) = \Eta_n(p_1,\ldots,p_n)</math>. | ::<math>\Eta_{n+1}(p_1,\ldots,p_n,0) = \Eta_n(p_1,\ldots,p_n)</math>. | ||

* [[जेन्सेन असमानता]] और फिर सेड्राक्यान की असमानता का उपयोग करके इसकी पुष्टि की जा सकती | * [[जेन्सेन असमानता]] और फिर सेड्राक्यान की असमानता का उपयोग करके इसकी पुष्टि की जा सकती है। | ||

::<math>\Eta(X) = \mathbb{E}[-\log_b p(X)] \leq -\log_b \left( \mathbb{E}[ p(X) ] \right) \leq \log_b n</math>.<ref name=cover1991>{{cite book |author1=Thomas M. Cover |author2=Joy A. Thomas |title=सूचना सिद्धांत के तत्व|publisher=Wiley |location=Hoboken, New Jersey |isbn=978-0-471-24195-9|date=1991}}</ref>{{rp|29}} | ::<math>\Eta(X) = \mathbb{E}[-\log_b p(X)] \leq -\log_b \left( \mathbb{E}[ p(X) ] \right) \leq \log_b n</math>.<ref name=cover1991>{{cite book |author1=Thomas M. Cover |author2=Joy A. Thomas |title=सूचना सिद्धांत के तत्व|publisher=Wiley |location=Hoboken, New Jersey |isbn=978-0-471-24195-9|date=1991}}</ref>{{rp|29}} | ||

: | : {{math|log<sub>''b''</sub>(''n'')}} की यह अधिकतम एन्ट्रॉपी एक समान प्रायिकता वितरण वाले स्रोत वर्णमाला द्वारा प्रभावी प्रकार से प्राप्त किया जाता है। अनिश्चितता की मात्रा अधिकतम होती है। जब सभी संभावित घटनाएं परिवर्तनीय होती हैं। | ||

* | * एन्ट्रॉपी या मूल्यांकन द्वारा प्रकट की गई जानकारी की मात्रा {{math|(''X'',''Y'')}} (अर्थात् मूल्यांकन करना {{math|''X''}} और {{math|''Y''}} एक साथ) निरंतर दो प्रयोग करके प्रकट की गई जानकारी के बराबर है। पहले के मूल्य {{math|''Y''}} का मूल्यांकन करना, फिर X का मान प्रकट करते हुए दिया गया है कि आप Y का मान जानते हैं। इसे इस रूप में लिखा जा सकता है। इसे इस प्रकार लिखा जा सकता है:<ref name=cover1991/>{{rp|16}} | ||

::<math> \Eta(X,Y)=\Eta(X|Y)+\Eta(Y)=\Eta(Y|X)+\Eta(X).</math> | ::<math> \Eta(X,Y)=\Eta(X|Y)+\Eta(Y)=\Eta(Y|X)+\Eta(X).</math> | ||

* | * यदि <math>Y=f(X)</math>, जहाँ <math>f</math> एक फलन है। तो <math>\Eta(f(X)|X) = 0</math>. पिछले सूत्र <math>\Eta(X,f(X))</math> को संचालित करना। | ||

::<math> \Eta(X)+\Eta(f(X)|X)=\Eta(f(X))+\Eta(X|f(X)),</math> :इसलिए <math>\Eta(f(X)) \le \Eta(X)</math>, एक चर की एन्ट्रॉपी केवल तभी घट सकती है जब बाद वाले को एक | ::<math> \Eta(X)+\Eta(f(X)|X)=\Eta(f(X))+\Eta(X|f(X)),</math> :इसलिए <math>\Eta(f(X)) \le \Eta(X)</math>, एक चर की एन्ट्रॉपी केवल तभी घट सकती है जब बाद वाले को एक फलन के माध्यम से पारित किया जाता है। | ||

* | * यदि {{math|''X''}} और {{math|''Y''}} दो स्वतंत्र यादृच्छिक चर हैं। फिर {{math|''Y''}} के मूल्य को जानना। {{math|''X''}} के मूल्य के बारे में हमारे ज्ञान को प्रभावित नहीं करता है (क्योंकि दोनों स्वतंत्रता से एक दूसरे को प्रभावित नहीं करते हैं): | ||

::<math> \Eta(X|Y)=\Eta(X).</math> | ::<math> \Eta(X|Y)=\Eta(X).</math> | ||

* | * सामान्यतः किसी भी यादृच्छिक चर {{math|''X''}} और {{math|''Y''}} के लिए हमारे पास है- | ||

::<math> \Eta(X|Y)\leq \Eta(X)</math>.<ref name=cover1991/>{{rp|29}} | ::<math> \Eta(X|Y)\leq \Eta(X)</math>.<ref name=cover1991/>{{rp|29}} | ||

* दो एक साथ होने वाली घटनाओं की | * दो एक साथ होने वाली घटनाओं की एन्ट्रॉपी प्रत्येक व्यक्तिगत घटना की एन्ट्रॉपी के योग से अधिक नहीं है, अर्थात, <math> \Eta(X,Y)\leq \Eta(X)+\Eta(Y)</math>, समानता के साथ यदि और केवल यदि दो घटनाएँ स्वतंत्र हैं।<ref name=cover1991/>{{rp|28}} | ||

* एंट्रॉपी <math>\Eta(p)</math> प्रायिकता द्रव्यमान फलन में अवतल फलन | * एंट्रॉपी <math>\Eta(p)</math> प्रायिकता द्रव्यमान फलन में अवतल फलन <math>p</math> है। अर्थात।<ref name=cover1991/>{{rp|30}} | ||

::<math>\Eta(\lambda p_1 + (1-\lambda) p_2) \ge \lambda \Eta(p_1) + (1-\lambda) \Eta(p_2)</math> | ::<math>\Eta(\lambda p_1 + (1-\lambda) p_2) \ge \lambda \Eta(p_1) + (1-\lambda) \Eta(p_2)</math> | ||

: सभी प्रायिकता | : सभी प्रायिकता के <math>p_1,p_2</math> और <math> 0 \le \lambda \le 1</math> द्रव्यमान फलन स्थित है।<ref name=cover1991 />{{rp|32}} | ||

: * | : * उसके अनुसार ऋणात्मक एन्ट्रॉपी (नेगेंट्रॉपी) फलन उत्तल है और इसका [[उत्तल संयुग्म]] [[LogSumExp]] है। | ||

== पहलू == | == पहलू == | ||

=== थर्मोडायनामिक एंट्रॉपी से संबंध === | === थर्मोडायनामिक एंट्रॉपी से संबंध === | ||

{{Main| | {{Main|ऊष्मप्रवैगिकी और सूचना सिद्धांत में एन्ट्रॉपी}} | ||

सूचना सिद्धांत में [[एन्ट्रापी]] शब्द को | सूचना सिद्धांत में [[एन्ट्रापी|एन्ट्रॉपी]] शब्द को ग्रहण करने की प्रेरणा शैनन के फार्मूले और [[सांख्यिकीय यांत्रिकी]] से बहुत समान ज्ञात सूत्रों के बीच घनिष्ठ समानता से प्राप्त की गयी है। | ||

सांख्यिकीय | सांख्यिकीय थर्मोडायनामिक्स में थर्मोडायनामिक प्रणाली के थर्मोडायनामिक एन्ट्रॉपी ''S'' के लिए सबसे सामान्य सूत्र [[गिब्स एंट्रॉपी]] है। | ||

:<math>S = - k_\text{B} \sum p_i \ln p_i \,</math> | :<math>S = - k_\text{B} \sum p_i \ln p_i \,</math> | ||

जहाँ {{math|''k''<sub>B</sub>}} [[बोल्ट्जमैन स्थिरांक]] है और {{math|''p''<sub>''i''</sub>}} एक [[माइक्रोस्टेट (सांख्यिकीय यांत्रिकी)]] की प्रायिकता है। एंट्रॉपी (सांख्यिकीय ऊष्मप्रवैगिकी) को जे. विलार्ड गिब्स द्वारा 1878 में [[लुडविग बोल्ट्जमैन]] (1872) द्वारा पहले के काम के बाद परिभाषित किया गया था।<ref>Compare: Boltzmann, Ludwig (1896, 1898). Vorlesungen über Gastheorie : 2 Volumes – Leipzig 1895/98 UB: O 5262-6. English version: Lectures on gas theory. Translated by Stephen G. Brush (1964) Berkeley: University of California Press; (1995) New York: Dover {{isbn|0-486-68455-5}}</ref> | |||

1927 में [[जॉन वॉन न्यूमैन]] द्वारा | |||

1927 में [[जॉन वॉन न्यूमैन]] द्वारा प्रारम्भ की गई [[वॉन न्यूमैन एन्ट्रॉपी]] देने के लिए गिब्स एंट्रॉपी [[क्वांटम भौतिकी]] की विश्व में लगभग अपरिवर्तित अनुवाद करती है। | |||

:<math>S = - k_\text{B} \,{\rm Tr}(\rho \ln \rho) \,</math> | :<math>S = - k_\text{B} \,{\rm Tr}(\rho \ln \rho) \,</math> | ||

जहां ρ क्वांटम मैकेनिकल | जहां ρ क्वांटम मैकेनिकल प्रणाली का [[घनत्व मैट्रिक्स]] है और Tr [[ट्रेस (रैखिक बीजगणित)]] है।<ref>{{Cite book|last=Życzkowski|first=Karol|title=Geometry of Quantum States: An Introduction to Quantum Entanglement|publisher=Cambridge University Press|year=2006|pages=301}}</ref> | ||

दैनिक जीवन के व्यावहारिक स्तर पर सूचना एंट्रॉपी और थर्मोडायनामिक एंट्रॉपी के बीच संबंध स्पष्ट नहीं हैं। भौतिक विज्ञानी और रसायनशास्त्री एन्ट्रॉपी में परिवर्तनों में अधिक रुचि रखते हैं क्योंकि एक अपरिवर्तनीय प्रायिकता वितरण के अतिरिक्त ऊष्मप्रवैगिकी के दूसरे नियम के अनुसार एक प्रणाली सहज रूप से अपनी प्रारंभिक स्थितियों से दूर विकसित होती है। बोल्ट्जमैन स्थिरांक की सूक्ष्मता के रूप में {{math|''k''<sub>B</sub>}} निर्देशित करता है। {{math|''S'' / ''k''<sub>B</sub>}} में परिवर्तन रासायनिक और भौतिक प्रक्रियाओं में पदार्थों की छोटी मात्रा भी एंट्रॉपी की मात्रा का प्रतिनिधित्व करती है। जो डेटा संपीड़न या [[ संकेत आगे बढ़ाना |सिग्नल संचरण]] में किसी भी चीज़ की तुलना में बहुत बड़ी है। मौलिक ऊष्मप्रवैगिकी में एन्ट्रॉपी को मैक्रोस्कोपिक माप के संदर्भ में परिभाषित किया गया है और किसी भी प्रायिकता वितरण का कोई संदर्भ नहीं प्रदान करता है। जो कि सूचना एन्ट्रॉपी की परिभाषा के लिए केंद्रीय है। | |||

ऊष्मप्रवैगिकी और जिसे अब सूचना सिद्धांत के रूप में जाना जाता है, के बीच संबंध सबसे पहले लुडविग बोल्ट्जमैन द्वारा बनाया गया था और उनके | ऊष्मप्रवैगिकी और जिसे अब सूचना सिद्धांत के रूप में जाना जाता है, के बीच संबंध सबसे पहले लुडविग बोल्ट्जमैन द्वारा बनाया गया था और उनके प्रसिद्ध समीकरण द्वारा व्यक्त किया गया था: | ||

:<math>S=k_\text{B} \ln W</math> | :<math>S=k_\text{B} \ln W</math> | ||

जहाँ <math>S</math> एक विशेष मैक्रोस्टेट का थर्मोडायनामिक एन्ट्रॉपी है (तापमान, आयतन, ऊर्जा, आदि जैसे थर्मोडायनामिक मापदंडों द्वारा परिभाषित), {{math|''W''}} माइक्रोस्टेट्स की संख्या है (विभिन्न ऊर्जा राज्यों में कणों के विभिन्न संयोजन) जो दिए गए मैक्रोस्टेट को उत्पन्न कर सकते हैं और {{math|''k''<sub>B</sub>}} बोल्ट्जमैन स्थिरांक है।<ref>{{Cite journal|last1=Sharp|first1=Kim|last2=Matschinsky|first2=Franz|date=2015|title=लुडविग बोल्ट्जमैन के पेपर का अनुवाद "ऊष्मा के यांत्रिक सिद्धांत के दूसरे मौलिक प्रमेय के बीच संबंध और थर्मल संतुलन के लिए शर्तों के संबंध में संभाव्यता गणना"|journal=Entropy|volume=17|pages=1971–2009|doi=10.3390/e17041971|doi-access=free}}</ref> यह माना जाता है कि प्रत्येक माइक्रोस्टेट समान रूप से संभावित है। जिससे किसी दिए गए माइक्रोस्टेट की संभावना {{math|1=''p''<sub>''i''</sub> = 1/''W''}} हो। जब इन संभावनाओं को गिब्स एंट्रॉपी (या समकक्ष ''k''<sub>B</sub> बार शैनन एंट्रॉपी) के लिए उपरोक्त अभिव्यक्ति में प्रतिस्थापित किया जाता है। तो बोल्टज़मान के समीकरण परिणाम को दर्शाता है। सूचना सिद्धांत के संदर्भ में एक प्रणाली की सूचना एन्ट्रॉपी एक माइक्रोस्टेट को निर्धारित करने के लिए आवश्यक "विलुप्त सूचना" की मात्रा है। जिसे मैक्रोस्टेट दिया गया है। | |||

[[एडविन थॉम्पसन जेनेस]] (1957) के विचार में | [[एडविन थॉम्पसन जेनेस]] (1957) के विचार में<ref>{{Cite journal|last=Jaynes|first=E. T.|date=1957-05-15|title=सूचना सिद्धांत और सांख्यिकीय यांत्रिकी|url=https://link.aps.org/doi/10.1103/PhysRev.106.620|journal=Physical Review|volume=106|issue=4|pages=620–630|doi=10.1103/PhysRev.106.620|bibcode=1957PhRv..106..620J}}</ref> थर्मोडायनामिक एन्ट्रॉपी, जैसा कि सांख्यिकीय यांत्रिकी द्वारा समझाया गया है, को शैनन के सूचना सिद्धांत के एक अनुप्रयोग के रूप में देखा जाना चाहिए। थर्मोडायनामिक एन्ट्रॉपी की व्याख्या प्रणाली की विस्तृत सूक्ष्म स्थिति को परिभाषित करने के लिए आवश्यक शैनन जानकारी की मात्रा के आनुपातिक होने के रूप में की जाती है। जो इसके द्वारा असंबद्ध रहती है। क्लासिकल ऊष्मप्रवैगिकी के मैक्रोस्कोपिक चर के संदर्भ में केवल एक विवरण, आनुपातिकता के स्थिरांक के साथ सिर्फ बोल्ट्जमैन स्थिरांक प्रणाली में हीट जोड़ने से इसकी थर्मोडायनेमिक एंट्रॉपी की मात्रा बढ जाती है क्योंकि यह प्रणाली के संभावित सूक्ष्म स्थितियों की संख्या को बढ़ाता है। जो इसके मैक्रोस्कोपिक चर के औसत क्लास के वैल्यू के अनुरूप होते हैं। जिससे कोई भी पूर्ण स्थित विवरण लंबा हो जाता है। (लेख देखें: [[अधिकतम एन्ट्रापी ऊष्मप्रवैगिकी|अधिकतम एन्ट्रॉपी ऊष्मप्रवैगिकी]])। मैक्सवेल डेमॉन व्यक्तिगत अणुओं की अवस्थाओं के बारे में जानकारी का उपयोग करके (काल्पनिक रूप से) एक प्रणाली के थर्मोडायनामिक एन्ट्रॉपी को कम कर सकता है। किन्तु [[रॉल्फ लैंडौएर]] (1961 से) और सहकर्मियों के रूप में<ref>{{Cite journal|last=Landauer|first=R.|date=July 1961|title=कम्प्यूटिंग प्रक्रिया में अपरिवर्तनीयता और ऊष्मा उत्पादन|url=https://ieeexplore.ieee.org/document/5392446|journal=IBM Journal of Research and Development|volume=5|issue=3|pages=183–191|doi=10.1147/rd.53.0183|issn=0018-8646}}</ref> दिखाया गया है। फलन करने के लिए डेमॉन को स्वयं प्रक्रिया में थर्मोडायनामिक एन्ट्रॉपी को कम से कम शैनन की जानकारी की मात्रा को बढ़ाना होगा। जो वह पहले प्राप्त करने और संग्रहीत करने का प्रस्ताव करता है और इसलिए कुल थर्मोडायनामिक एन्ट्रॉपी कम नहीं होती है (जो विरोधाभास को हल करती है)। लैंडौअर का सिद्धांत एक निश्चित मात्रा में सूचना को संसाधित करने के लिए एक कंप्यूटर को उत्पन्न होने वाली गर्मी की मात्रा पर एक निचली सीमा को निर्धारित करता है। चूंकि आधुनिक कंप्यूटर बहुत कम कुशल एवं दक्ष हैं। | ||

=== डेटा संपीड़न === | === डेटा संपीड़न === | ||

{{Main| | {{Main|शैनन का स्रोत कोडिंग प्रमेय|आधार - सामग्री संकोचन}} | ||

जब एक सूचना स्रोत पर संचालित होती है। एन्ट्रॉपी की शैनन की परिभाषा स्रोत को एन्कोडेड बाइनरी अंकों के रूप में विश्वसनीय रूप से प्रसारित करने के लिए आवश्यक न्यूनतम चैनल क्षमता निर्धारित कर सकती है। शैनन की एन्ट्रॉपी संदेश में निहित जानकारी को मापती है। जो संदेश के उस भाग के विपरीत है। जो निर्धारित (या अनुमानित) है। उत्तरार्द्ध के उदाहरणों में भाषा संरचना में अतिरेक या अक्षर या शब्द जोड़े, ट्रिपल आदि की घटना आवृत्तियों से संबंधित सांख्यिकीय गुण सम्मिलित हैं। न्यूनतम चैनल क्षमता को विशिष्ट समुच्चय का उपयोग करके या [[हफ़मैन कोडिंग]], एलजे़ड्ब्लू लेम्पेल का उपयोग करके व्यवहार में अनुभव किया जा सकता है। ज़िव या [[अंकगणितीय कोडिंग]] ([[कोलमोगोरोव जटिलता]] भी देखें।) व्यवहार में संपीड़न एल्गोरिदम जानकारी के बाद भी त्रुटियों से बचाने के लिए [[ अंततः, |अंततः]] के रूप में कुछ विवेकपूर्ण अतिरेक सम्मिलित करते हैं। किसी डेटा स्रोत की [[एन्ट्रापी दर|एन्ट्रॉपी दर]] उसे एन्कोड करने के लिए आवश्यक प्रति प्रतीक बिट्स की औसत संख्या है। मानव भविष्यवक्ताओं के साथ शैनन के प्रयोग अंग्रेजी में प्रति वर्ण 0.6 और 1.3 बिट्स के बीच एक सूचना दर को प्रदर्शित करते हैं।<ref>{{cite web| url=http://marknelson.us/2006/08/24/the-hutter-prize/ | title=द हटर प्राइज| access-date=2008-11-27 | date=24 August 2006 | author=Mark Nelson}}</ref> पीपीएम संपीड़न एल्गोरिदम अंग्रेजी पाठ में प्रति वर्ण 1.5 बिट के संपीड़न अनुपात को प्राप्त कर सकता है। | |||

[[ विज्ञान (पत्रिका) ]] में 2011 के एक अध्ययन में अनुमान लगाया गया है कि वर्ष 2007 में उपलब्ध सबसे प्रभावी संपीड़न एल्गोरिदम पर सामान्य रूप से संकुचित सूचना को संग्रहीत और संप्रेषित करने के लिए | यदि कोई डेटा कम्प्रेशन योजना दोषरहित है। एक जिसमें आप सदैव डीकंप्रेसन द्वारा संपूर्ण मूल संदेश को पुनर्प्राप्त कर सकते हैं। तो एक कंप्रेस्ड संदेश में मूल के समान जानकारी होती है। किन्तु कम वर्णों में संप्रेषित होती है। इसमें प्रति वर्ण अधिक जानकारी (उच्च एन्ट्रॉपी) है। एक संपीड़ित संदेश में अतिरेक (सूचना सिद्धांत) कम होता है। शैनन के स्रोत कोडिंग प्रमेय में कहा गया है कि एक दोषरहित संपीड़न योजना संदेशों को औसत रूप से प्रति बिट संदेश के एक बिट से अधिक जानकारी प्राप्त करने के लिए संपीड़ित नहीं कर सकती है। किन्तु यह कि संदेश के प्रति बिट सूचना के एक बिट से कम किसी भी मूल्य को उपयुक्त नियोजित करके प्राप्त किया जा सकता है। कोडिंग प्रणाली संदेश की लंबाई से प्रति बिट गुणा किए गए संदेश की एन्ट्रॉपी इस बात का एक उपाय है कि संदेश में कुल कितनी जानकारी उपस्थित है। शैनन के प्रमेय का अर्थ यह भी है कि कोई दोषरहित संपीड़न योजना सभी संदेशों को छोटा नहीं कर सकती है। यदि कुछ संदेश छोटे आकार में आते हैं, तो पीजन के सिद्धांत के कारण कम से कम एक संदेश अधिक लंबा होना चाहिए। व्यावहारिक उपयोग में यह सामान्यतः कोई समस्या नहीं है क्योंकि सामान्यतः केवल कुछ प्रकार के संदेशों को संपीड़ित करने में रुचि होती है। जैसे कि अंग्रेजी में एक लेख, जो अस्पष्ट पाठ के विपरीत है या न्वाइस के अतिरिक्त डिजिटल फोटोग्राफ और यह महत्वहीन है। यदि एक संपीड़न एल्गोरिथ्म कुछ असंभावित या अरुचिकर अनुक्रमों को बड़ा बनाता है। | ||

[[ विज्ञान (पत्रिका) | विज्ञान (पत्रिका)]] में 2011 के एक अध्ययन में अनुमान लगाया गया है कि वर्ष 2007 में उपलब्ध सबसे प्रभावी संपीड़न एल्गोरिदम पर सामान्य रूप से संकुचित सूचना को संग्रहीत और संप्रेषित करने के लिए विश्व की प्रणालीी क्षमता है। इसलिए प्रणालीी रूप से उपलब्ध स्रोतों की एन्ट्रॉपी का आकलन करना उचित होता है।<ref name="HilbertLopez2011">[http://www.sciencemag.org/content/332/6025/60 "The World's Technological Capacity to Store, Communicate, and Compute Information"], Martin Hilbert and Priscila López (2011), [[Science (journal)|Science]], 332(6025); free access to the article through here: martinhilbert.net/WorldInfoCapacity.html</ref>{{rp|60–65}} | |||

{| class="wikitable" | {| class="wikitable" | ||

|+ | |+ | ||

एंट्रोपिकली कंप्रेस्ड एक्सबाइट्स में सभी आंकड़े | |||

|- | |- | ||

! | ! सूचना का प्रकार !! 1986 !! 2007 | ||

|- | |- | ||

| | | भंडारण || 2.6 || 295 | ||

|- | |- | ||

| | |प्रसारण | ||

| 432 || 1900 | |||

|- | |- | ||

| | |दूरसंचार | ||

| 0.281 || 65 | |||

|} | |} | ||

लेखक 1986 में और फिर 2007 में सूचना ( | लेखक 1986 में और फिर 2007 में सूचना (पूर्णतयः संकुचित) को संग्रहीत करने के लिए मानव जाति की प्रणालीी क्षमता का अनुमान लगाते हैं। वे सूचना को तीन श्रेणियों में विभाजित करते हैं- एक माध्यम पर सूचना संग्रहीत करने के लिए, एक ओर [[प्रसारण]] नेटवर्क के माध्यम से सूचना प्राप्त करने के लिए या दो ओर से [[दूरसंचार]] नेटवर्क के माध्यम से सूचना का आदान-प्रदान करने के लिए।<ref name="HilbertLopez2011"/> | ||

===विविधता के एक उपाय के रूप में एंट्रॉपी === | ===विविधता के एक उपाय के रूप में एंट्रॉपी === | ||

{{Main| | {{Main|विविधता सूचकांक}} | ||

एन्ट्रॉपी जैव विविधता को मापने के कई प्रकारों में से एक है और इसे [[विविधता सूचकांक]] के रूप में संचालित किया जाता है।<ref>{{Cite journal|last1=Spellerberg|first1=Ian F.|last2=Fedor|first2=Peter J.|date=2003|title=A tribute to Claude Shannon (1916–2001) and a plea for more rigorous use of species richness, species diversity and the 'Shannon–Wiener' Index|url=https://onlinelibrary.wiley.com/doi/abs/10.1046/j.1466-822X.2003.00015.x|journal=Global Ecology and Biogeography|language=en|volume=12|issue=3|pages=177–179|doi=10.1046/j.1466-822X.2003.00015.x|issn=1466-8238}}</ref> एक विविधता सूचकांक एक मात्रात्मक सांख्यिकीय माप है कि एक डेटासेट में कितने अलग-अलग प्रकार उपस्थित होते हैं। जैसे कि एक समूह में प्रजातियां, पारिस्थितिक प्रजातियों की समृद्धि, प्रजातियों की समरूपता और [[प्रभुत्व (पारिस्थितिकी)]] के लिए लेखांकन। विशेष रूप से शैनन एन्ट्रॉपी का लघुगणक {{math|<sup>1</sup>D}} है। जो कि 1 के बराबर पैरामीटर के साथ यथार्थ रूपिक विविधता सूचकांक है। शैनन इंडेक्स प्रकार के आनुपातिक बहुतायत से संबंधित होता है। | |||

=== एन्ट्रॉपी की सीमाएं === | === एन्ट्रॉपी की सीमाएं === | ||

एंट्रॉपी से संबंधित कई अवधारणाएं | एंट्रॉपी से संबंधित कई अवधारणाएं हैं। जो गणितीय रूप से सूचना सामग्री को किसी प्रकार से परिमाणित करती हैं: | ||

* किसी दिए गए प्रायिकता वितरण से लिए गए एक व्यक्तिगत संदेश या प्रतीक की स्व-सूचना, | * किसी दिए गए प्रायिकता वितरण से लिए गए एक व्यक्तिगत संदेश या प्रतीक की स्व-सूचना, | ||

* संदेशों या प्रतीकों के दिए गए प्रायिकता वितरण की एंट्रॉपी | * संदेशों या प्रतीकों के दिए गए प्रायिकता वितरण की एंट्रॉपी और | ||

* एक स्टोकेस्टिक प्रक्रिया की | * एक स्टोकेस्टिक प्रक्रिया की एन्ट्रॉपी दर। | ||

(स्वयं-सूचना की दर को किसी दिए गए स्टोकास्टिक प्रक्रिया द्वारा उत्पन्न संदेशों या प्रतीकों के किसी विशेष अनुक्रम के लिए भी परिभाषित किया जा सकता | (स्वयं-सूचना की दर को किसी दिए गए स्टोकास्टिक प्रक्रिया द्वारा उत्पन्न संदेशों या प्रतीकों के किसी विशेष अनुक्रम के लिए भी परिभाषित किया जा सकता है। यह [[स्थिर प्रक्रिया]] के स्थिति में सदैव एंट्रॉपी दर के बराबर होगा।) जानकारी की अन्य मात्राएं भी हैं। सूचना के विभिन्न स्रोतों की तुलना या संबंधित करने के लिए उपयोग किया जाता है। | ||

उपरोक्त अवधारणाओं को भ्रमित नहीं करना महत्वपूर्ण है। | उपरोक्त अवधारणाओं को भ्रमित नहीं करना महत्वपूर्ण है। अधिकांशतः यह संदर्भ से ही स्पष्ट होता है कि कौन सा अर्थ है। उदाहरण के लिए जब कोई कहता है कि अंग्रेजी भाषा की एन्ट्रॉपी लगभग 1 बिट प्रति वर्ण है। तो वे यथार्थ रूप में अंग्रेजी भाषा को एक [[अनेक संभावनाओं में से चुनी हूई प्रक्रिया]] के रूप में मॉडलिंग कर रहे हैं और इसकी एन्ट्रॉपी ''दर'' के विषय में बात कर रहे हैं। शैनन ने स्वयं इस शब्द का प्रयोग इस प्रकार किया है। | ||

यदि बहुत बड़े ब्लॉकों का उपयोग किया जाता | यदि बहुत बड़े ब्लॉकों का उपयोग किया जाता है। तो प्रति-चरित्र एन्ट्रॉपी दर का अनुमान कृत्रिम रूप से कम हो सकता है क्योंकि अनुक्रम की प्रायिकता वितरण स्पष्ट रूप से ज्ञात नहीं है। यह केवल एक अनुमान है। यदि प्रत्येक पुस्तक के पाठ को एक अनुक्रम के रूप में कभी भी प्रकाशित किया जाता है। जिसमें प्रत्येक प्रतीक एक पूर्ण पुस्तक का पाठ होता है और यदि N प्रकाशित पुस्तकें हैं और प्रत्येक पुस्तक केवल एक बार प्रकाशित होती है। तो प्रत्येक पुस्तक की प्रायिकता का अनुमान 1/N है और एंट्रॉपी (बिट्स में) log2(1/N) = log2(N) है। एक व्यावहारिक कोड के रूप में यह प्रत्येक पुस्तक को एक [[आईएसबीएन]] निर्दिष्ट करने और पुस्तक के पाठ के स्थान पर इसका उपयोग करने के अनुरूप है। जब भी कोई पुस्तक को संदर्भित करना चाहता है। यह पुस्तकों के विषय में बात करने के लिए अत्यधिक उपयोगी है। किन्तु यह किसी एक पुस्तक की सूचना सामग्री या सामान्य रूप से भाषा की विशेषता के लिए इतना उपयोगी नहीं है। प्रायिकता वितरण को जाने बिना पुस्तक को उसके पहचानकर्ता से पुनर्निर्माण करना संभव नहीं है अर्थात सभी पुस्तकों का पूरा पाठ सम्मिलित है। मुख्य विचार यह है कि संभाव्य मॉडल की जटिलता पर विचार किया जाना चाहिए। कोल्मोगोरोव जटिलता इस विचार का एक सैद्धांतिक सामान्यीकरण है। जो किसी विशेष प्रायिकता मॉडल से स्वतंत्र अनुक्रम की सूचना सामग्री पर विचार करने की अनुमति देता है। यह अनुक्रम को आउटपुट करने वाले यूनिवर्सल कंप्यूटर के लिए सबसे छोटा [[कंप्यूटर प्रोग्राम]] मानता है। एक कोड, जो किसी दिए गए मॉडल के लिए अनुक्रम की एंट्रॉपी दर प्राप्त करता है, साथ ही कोडबुक (अर्थात संभाव्य मॉडल), एक ऐसा प्रोग्राम है। किन्तु यह सबसे छोटा नहीं हो सकता है। | ||

फाइबोनैचि अनुक्रम 1, 1, 2, 3, 5, 8, 13, .... अनुक्रम को एक संदेश और प्रत्येक संख्या को एक प्रतीक के रूप में मानते हुए | फाइबोनैचि अनुक्रम 1, 1, 2, 3, 5, 8, 13, .... अनुक्रम को एक संदेश और प्रत्येक संख्या को एक प्रतीक के रूप में मानते हुए लगभग उतने ही प्रतीक हैं। जितने संदेश में वर्ण हैं। इसके अन्तर्गत लगभग एक एन्ट्रॉपी {{math|log<sub>2</sub>(''n'')}} दे रहे हैं। फाइबोनैचि अनुक्रम के पहले 128 प्रतीकों में लगभग 7 बिट/प्रतीक की एन्ट्रॉपी है। किन्तु अनुक्रम को एक सूत्र का उपयोग करके व्यक्त किया जा सकता है। [{{math|F(''n'') {{=}} F(''n''−1) + F(''n''−2)}} के लिए {{math|''n'' {{=}} 3, 4, 5, ...}}, {{math|F(1) {{=}}1}}, {{math|F(2) {{=}} 1}}] और इस सूत्र में बहुत कम एन्ट्रॉपी है और फिबोनैचि अनुक्रम की किसी भी लंबाई पर संचालित होता है। | ||

=== क्रिप्टोग्राफी में | === क्रिप्टोग्राफी में एन्ट्रॉपी की सीमाएं === | ||

[[क्रिप्ट विश्लेषण]] में | [[क्रिप्ट विश्लेषण]] में एन्ट्रॉपी का उपयोग अधिकांशतः सामान्यतः एक क्रिप्टोग्राफ़िक कुंजी की अप्रत्याशितता के माप के रूप में किया जाता है। चूंकि इसका यथार्थ रूपिक अनिश्चितता सिद्धांत मापनीय नहीं है। उदाहरण के लिए एक 128-बिट कुंजी, जो समान रूप से और उत्तम प्रकार से उत्पन्न होती है, में 128 बिट एन्ट्रॉपी होती है। यह <math>2^{127}</math> क्रूर बल द्वारा तोड़ने का अनुमान भी लेता है (औसत पर)। एंट्रॉपी आवश्यक अनुमानों की संख्या को कैप्चर करने में विफल रहता है। यदि संभावित कुंजियों को समान रूप से नहीं चुना जाता है।<ref>{{cite conference |first1=James |last1=Massey |year=1994 |title=अनुमान और एंट्रॉपी|book-title=Proc. IEEE International Symposium on Information Theory |url=http://www.isiweb.ee.ethz.ch/archive/massey_pub/pdf/BI633.pdf |access-date=31 December 2013}}</ref><ref>{{cite conference |first1=David |last1=Malone|first2=Wayne |last2=Sullivan |year=2005 |title=गेसवर्क एंट्रॉपी का विकल्प नहीं है|book-title=Proceedings of the Information Technology & Telecommunications Conference |url=http://www.maths.tcd.ie/~dwmalone/p/itt05.pdf |access-date=31 December 2013}}</ref> इसके अतिरिक्त ब्रूट फ़ोर्स अटैक के लिए आवश्यक प्रयास को मापने के लिए गेसवर्क नामक एक उपाय का उपयोग किया जा सकता है।<ref>{{cite conference |first1=John |last1=Pliam |title=क्रिप्टोग्राफी में चयनित क्षेत्र|year=1999 |chapter=Guesswork and variation distance as measures of cipher security|series=Lecture Notes in Computer Science |volume=1758 |pages=62–77 |book-title=International Workshop on क्रिप्टोग्राफी में चयनित क्षेत्र|doi=10.1007/3-540-46513-8_5 |isbn=978-3-540-67185-5 |doi-access=free }}</ref> | ||

क्रिप्टोग्राफी में प्रयुक्त गैर-समान वितरण से अन्य समस्याएं उत्पन्न हो सकती हैं। उदाहरण के लिए | |||

क्रिप्टोग्राफी में प्रयुक्त गैर-समान वितरण से अन्य समस्याएं उत्पन्न हो सकती हैं। उदाहरण के लिए एक 1,000,000-अंकों वाला बाइनरी वन-टाइम पैड जिसमें एक्सक्लूसिव या यदि पैड में 1,000,000 बिट्स एन्ट्रॉपी है। तो यह पूर्णरूप से सही है। यदि पैड में 999,999 बिट्स एंट्रॉपी है, समान रूप से वितरित (पैड के प्रत्येक बिट में 0.999999 बिट्स एंट्रॉपी है)। तो यह अच्छी सुरक्षा प्रदान कर सकता है। किन्तु यदि पैड में 999,999 बिट्स एंट्रॉपी है। जहां पहला बिट फिक्स है और शेष 999,999 बिट्स पूरी प्रकार यादृच्छिक हैं। तो सिफरटेक्स्ट का पहला बिट एन्क्रिप्ट नहीं किया जाएगा। | |||

=== मार्कोव प्रक्रिया के रूप में डेटा === | === मार्कोव प्रक्रिया के रूप में डेटा === | ||

टेक्स्ट के लिए | टेक्स्ट के लिए एन्ट्रॉपी को परिभाषित करने का एक सामान्य उपाय टेक्स्ट के [[मार्कोव मॉडल]] पर आधारित है। ऑर्डर-0 स्रोत के लिए (प्रत्येक वर्ण को अंतिम वर्णों से स्वतंत्र चुना गया है), बाइनरी एन्ट्रॉपी है: | ||

:<math>\Eta(\mathcal{S}) = - \sum p_i \log p_i ,</math> | :<math>\Eta(\mathcal{S}) = - \sum p_i \log p_i ,</math> | ||

जहाँ {{math|''p''<sub>''i''</sub>}} की संभावना {{math|''i''}} है। पहले क्रम के [[मार्कोव स्रोत]] के लिए (जिसमें एक चरित्र का चयन करने की संभावना केवल तुरंत पूर्ववर्ती चरित्र पर निर्भर है), एंट्रॉपी दर है: | |||

:<math>\Eta(\mathcal{S}) = - \sum_i p_i \sum_j \ p_i (j) \log p_i (j) ,</math> | :<math>\Eta(\mathcal{S}) = - \sum_i p_i \sum_j \ p_i (j) \log p_i (j) ,</math> | ||

जहाँ {{math|''i''}} एक अवस्था है (कुछ पूर्ववर्ती वर्ण) और <math>p_i(j)</math> की सम्भावना {{math|''i''}} पिछले चरित्र के रूप में {{math|''j''}} दिया गया है। | |||

दूसरे क्रम के मार्कोव स्रोत के लिए | दूसरे क्रम के मार्कोव स्रोत के लिए एन्ट्रॉपी दर है। | ||

:<math>\Eta(\mathcal{S}) = -\sum_i p_i \sum_j p_i(j) \sum_k p_{i,j}(k)\ \log \ p_{i,j}(k) .</math> | :<math>\Eta(\mathcal{S}) = -\sum_i p_i \sum_j p_i(j) \sum_k p_{i,j}(k)\ \log \ p_{i,j}(k) .</math> | ||

| Line 247: | Line 245: | ||

== दक्षता (सामान्यीकृत एन्ट्रॉपी) == | == दक्षता (सामान्यीकृत एन्ट्रॉपी) == | ||

गैर-समान वितरण | गैर-समान वितरण वाले स्रोत वर्णमाला में उन प्रतीकों की तुलना में एंट्रोपी की मात्रा कम होगी। जिनका वितरण समान था (अर्थात "अनुकूलित वर्णमाला")। एन्ट्रापी में इस कमी को दक्षता नामक अनुपात के रूप में व्यक्त किया जा सकता है।: | ||

:<math>\eta(X) = \frac{H}{H_{max}} = -\sum_{i=1}^n \frac{p(x_i) \log_b (p(x_i))}{\log_b (n)} | :<math>\eta(X) = \frac{H}{H_{max}} = -\sum_{i=1}^n \frac{p(x_i) \log_b (p(x_i))}{\log_b (n)} | ||

</math> | </math> | ||

लघुगणक के मूल गुणों को | लघुगणक के मूल गुणों को संचालित करते हुए इस मात्रा को इस रूप में भी व्यक्त किया जा सकता है: | ||

:<math>\eta(X) = -\sum_{i=1}^n \frac{p(x_i) \log_b (p(x_i))}{\log_b (n)} = \sum_{i=1}^n \frac{\log_b(p(x_i)^{-p(x_i)})}{\log_b(n)} = | :<math>\eta(X) = -\sum_{i=1}^n \frac{p(x_i) \log_b (p(x_i))}{\log_b (n)} = \sum_{i=1}^n \frac{\log_b(p(x_i)^{-p(x_i)})}{\log_b(n)} = | ||

\sum_{i=1}^n \log_n(p(x_i)^{-p(x_i)}) = | \sum_{i=1}^n \log_n(p(x_i)^{-p(x_i)}) = | ||

\log_n (\prod_{i=1}^n p(x_i)^{-p(x_i)}) | \log_n (\prod_{i=1}^n p(x_i)^{-p(x_i)}) | ||

</math> | </math> | ||

संचार चैनल के प्रभावी उपयोग की मात्रा निर्धारित करने में दक्षता की उपयोगिता है। इस फॉर्मूलेशन को सामान्यीकृत एंट्रॉपी के रूप में भी जाना जाता है | संचार चैनल के प्रभावी उपयोग की मात्रा निर्धारित करने में दक्षता की उपयोगिता है। इस फॉर्मूलेशन को सामान्यीकृत एंट्रॉपी के रूप में भी जाना जाता है क्योंकि एंट्रॉपी को अधिकतम एंट्रॉपी <math>{\log_b (n)}</math> से विभाजित किया जाता है। इसके अतिरिक्त दक्षता (धनात्मक) आधार {{math|''b''}} की पसंद के प्रति उदासीन है। जैसा कि इसके ऊपर अंतिम लघुगणक के अन्दर असंवेदनशीलता द्वारा निर्देशित किया गया है। | ||

== निरंतर यादृच्छिक चर के लिए एंट्रॉपी == | == निरंतर यादृच्छिक चर के लिए एंट्रॉपी == | ||

=== विभेदक एन्ट्रॉपी === | === विभेदक एन्ट्रॉपी === | ||

{{Main| | {{Main|विभेदक एन्ट्रापी}} | ||

शैनन | शैनन एन्ट्रॉपी असतत मान लेने वाले यादृच्छिक चरों तक सीमित है। प्रायिकता घनत्व फलन के साथ एक सतत यादृच्छिक चर के लिए संबंधित सूत्र {{math|''f''(''x'')}} परिमित या अनंत समर्थन के साथ <math>\mathbb X</math> एक अपेक्षा के रूप में एन्ट्रॉपी के उपरोक्त रूप का उपयोग करते हुए यथार्थ रूपिक रेखा पर सादृश्य द्वारा परिभाषित किया गया है।<ref name=cover1991/>{{rp|224}} | ||

:<math>\Eta(X) = \mathbb{E}[-\log f(X)] = -\int_\mathbb X f(x) \log f(x)\, \mathrm{d}x.</math> | :<math>\Eta(X) = \mathbb{E}[-\log f(X)] = -\int_\mathbb X f(x) \log f(x)\, \mathrm{d}x.</math> | ||

यह अंतर एंट्रॉपी (या निरंतर एन्ट्रॉपी) है। निरंतर एन्ट्रॉपी का अग्रदूत {{math|''h''[''f'']}} | यह अंतर एंट्रॉपी (या निरंतर एन्ट्रॉपी) है। निरंतर एन्ट्रॉपी का अग्रदूत {{math|''h''[''f'']}} फलनात्मक के लिए {{math|''Η''}} [[ बोल्ट्जमान |बोल्ट्जमान]] के [[एच-प्रमेय|{{math|''Η''}}-प्रमेय]] में अभिव्यक्ति है। | ||

यद्यपि दोनों | यद्यपि दोनों फलनों के बीच सादृश्य सांकेतिक है। इसके अन्तर्गत निम्नलिखित प्रश्न निर्धारित किया जाना चाहिए: क्या अंतर एन्ट्रॉपी शैनन असतत एन्ट्रॉपी का एक वैध विस्तार है? डिफरेंशियल एंट्रॉपी में कई गुणों का अभाव है। जो शैनन असतत एन्ट्रॉपी में है। यह श्रणात्मक भी हो सकता है और सुधारों का सुझाव दिया गया है, विशेष रूप से [[असतत बिंदुओं के घनत्व को सीमित करना|असतत बिंदुओं के घनत्व को सीमित करनें]] का सुझाव प्रमुख था। | ||

इस प्रश्न का उत्तर देने के लिए | इस प्रश्न का उत्तर देने के लिए दो फलनों के बीच एक संबंध स्थापित किया जाना चाहिए: | ||

सामान्यतः परिमित माप प्राप्त करने के लिए बिन-आकार शून्य हो जाता है। असतत स्थिति में बिन-आकार प्रत्येक {{math|''n''}} की (अंतर्निहित) चौड़ाई है। (परिमित या अनंत) डिब्बे जिनकी संभावनाओं को {{math|''p''<sub>''n''</sub>}} निरूपित किया जाता है। जैसा कि निरंतर डोमेन सामान्यीकृत है और चौड़ाई स्पष्ट होनी चाहिए। | |||

ऐसा करने के लिए | ऐसा करने के लिए एक सतत फलन {{math|''f''}} आकार के डिब्बे में विभाजित <math>\Delta</math> के साथ प्रारंभ करें। | ||

माध्य-मूल्य प्रमेय के अनुसार एक मूल्य | माध्य-मूल्य प्रमेय के अनुसार एक मूल्य {{math|''x''<sub>''i''</sub>}} उपस्थित है। प्रत्येक बिन में ऐसा है कि- | ||

<math display="block">f(x_i) \Delta = \int_{i\Delta}^{(i+1)\Delta} f(x)\, dx</math> | <math display="block">f(x_i) \Delta = \int_{i\Delta}^{(i+1)\Delta} f(x)\, dx</math> | ||

फलन का अभिन्न अंग | फलन का अभिन्न अंग f द्वारा अनुमानित (रीमैनियन अर्थ में) किया जा सकता है।<math display="block">\int_{-\infty}^{\infty} f(x)\, dx = \lim_{\Delta \to 0} \sum_{i = -\infty}^{\infty} f(x_i) \Delta ,</math> | ||

<math display="block">\int_{-\infty}^{\infty} f(x)\, dx = \lim_{\Delta \to 0} \sum_{i = -\infty}^{\infty} f(x_i) \Delta ,</math> | जहाँ यह सीमा और बिन आकार शून्य हो जाता है और समतुल्यता की स्थिति में भी हैं। | ||

जहाँ यह सीमा और बिन आकार शून्य हो जाता है | |||

हम निरूपित | हम निरूपित करेंगे। | ||

<math display="block">\Eta^{\Delta} := - \sum_{i=-\infty}^{\infty} f(x_i) \Delta \log \left( f(x_i) \Delta \right)</math> | <math display="block">\Eta^{\Delta} := - \sum_{i=-\infty}^{\infty} f(x_i) \Delta \log \left( f(x_i) \Delta \right)</math> | ||

और लघुगणक का विस्तार | और लघुगणक का विस्तार होगा। हमारे पास है- | ||

<math display="block">\Eta^{\Delta} = - \sum_{i=-\infty}^{\infty} f(x_i) \Delta \log (f(x_i)) -\sum_{i=-\infty}^{\infty} f(x_i) \Delta \log (\Delta).</math> | <math display="block">\Eta^{\Delta} = - \sum_{i=-\infty}^{\infty} f(x_i) \Delta \log (f(x_i)) -\sum_{i=-\infty}^{\infty} f(x_i) \Delta \log (\Delta).</math> | ||

जैसा {{math|Δ → 0}}, | जैसा {{math|Δ → 0}}, हमारे पास है- | ||

:<math>\begin{align} | :<math>\begin{align} | ||

| Line 295: | Line 292: | ||

:<math>h[f] = \lim_{\Delta \to 0} \left(\Eta^{\Delta} + \log \Delta\right) = -\int_{-\infty}^{\infty} f(x) \log f(x)\,dx,</math> | :<math>h[f] = \lim_{\Delta \to 0} \left(\Eta^{\Delta} + \log \Delta\right) = -\int_{-\infty}^{\infty} f(x) \log f(x)\,dx,</math> | ||

जैसा कि पहले कहा गया | जैसा कि पहले कहा गया है। जिसे डिफरेंशियल एंट्रॉपी कहा जाता है। इसका अर्थ यह है कि अंतर एंट्रॉपी शैनन एंट्रॉपी की सीमा {{math|''n'' → ∞}} नहीं है। इसके अतिरिक्त यह शैनन एंट्रोपी की सीमा से एक अनंत ऑफसेट द्वारा भिन्न होता है ([[सूचना आयाम]] पर लेख भी देखें)। | ||

=== असतत बिंदुओं का घनत्व सीमित करना === | === असतत बिंदुओं का घनत्व सीमित करना === | ||

{{Main| | {{Main|असतत बिंदुओं का घनत्व सीमित करना}} | ||

इसका परिणाम यह | इसका परिणाम हमें यह प्राप्त होता है कि शैनन एंट्रॉपी के विपरीत डिफरेंशियल एन्ट्रॉपी सामान्य रूप से अनिश्चितता या सूचना का एक अच्छा उपाय नहीं है। उदाहरण के लिए विभेदक एंट्रोपी ऋणात्मक हो सकती है। साथ ही यह निरंतर समन्वय परिवर्तनों के अनुसार अपरिवर्तनीय नहीं है। इस समस्या को इकाइयों के परिवर्तन से स्पष्ट किया जा सकता है। जिसमें {{math|''x''}} एक आयामी चर है। {{math|''f''(''x'')}} की इकाइयाँ {{math|1/''x''}} होंगी। लघुगणक का तर्क विमाहीन होना चाहिए अन्यथा यह अनुचित है। जिससे कि ऊपर दिए गए अंतर एंट्रॉपी अनुचित होंगे। यदि {{math|''Δ''}} का कुछ मानक मान {{math|''x''}} (अर्थात बिन आकार) है और इसलिए एक ही इकाइयां हैं। तो एक संशोधित अंतर एन्ट्रॉपी को उचित रूप में लिखा जा सकता है: | ||

:<math display="block">\Eta=\int_{-\infty}^\infty f(x) \log(f(x)\,\Delta)\,dx ,</math> | :<math display="block">\Eta=\int_{-\infty}^\infty f(x) \log(f(x)\,\Delta)\,dx ,</math> | ||

और परिणाम | और परिणाम {{math|''x''}} इकाइयों के किसी भी विकल्प के लिए समान होगा। यथार्थ रूप में असतत एन्ट्रॉपी की सीमा के रूप में <math> N \rightarrow \infty </math> की अवधि <math> \log(N)</math> भी सम्मिलित होगी। जो सामान्य रूप से अनंत होगी। यह अपेक्षित है: विखंडित होने पर निरंतर चर में सामान्यतः अनंत एन्ट्रॉपी होती है। असतत बिंदुओं का सीमित घनत्व यथार्थ रूप में इस विषय का माप है कि वितरण की तुलना में वितरण कितना सरल है। जो इसकी परिमाणीकरण योजना पर एक समान होता है। | ||

=== सापेक्ष एन्ट्रॉपी === | === सापेक्ष एन्ट्रॉपी === | ||

{{main| | {{main|सामान्यीकृत सापेक्ष एन्ट्रापी}} | ||

एन्ट्रॉपी का एक और उपयोगी माप जो असतत और निरंतर स्थिति में समान रूप से अच्छी प्रकार से काम करता है। वह वितरण की सापेक्ष एन्ट्रॉपी है। इसे कुल्बैक-लीब्लर विचलन के रूप में वितरण से एक संदर्भ माप के रूप में {{math|''m''}} निम्नलिखित अनुसार परिभाषित किया गया है। माना कि एक प्रायिकता वितरण {{math|''p''}} किसी माप {{math|''m''}} के संबंध में बिल्कुल सतत है। अर्थात् फॉर्म p(dx) = f(x)m(dx) का है। कुछ गैर-श्रणात्मक {{math|''m''}}-इंटीग्रेबल फलन f के लिए {{math|''m''}}-इंटीग्रल 1 के साथ स्थित है। फिर सापेक्ष एंट्रॉपी को परिभाषित किया जा सकता है- | |||

:<math>D_{\mathrm{KL}}(p \| m ) = \int \log (f(x)) p(dx) = \int f(x)\log (f(x)) m(dx) .</math> | :<math>D_{\mathrm{KL}}(p \| m ) = \int \log (f(x)) p(dx) = \int f(x)\log (f(x)) m(dx) .</math> | ||

इस रूप में सापेक्ष एन्ट्रॉपी सामान्यीकरण (संकेत में परिवर्तन तक) असतत एन्ट्रॉपी दोनों को करता | इस रूप में सापेक्ष एन्ट्रॉपी सामान्यीकरण (संकेत में परिवर्तन तक) असतत एन्ट्रॉपी दोनों को करता है। जहां माप {{math|''m''}} गणना माप है और अंतर एन्ट्रॉपी, जहाँ माप {{math|''m''}} [[लेबेस्ग उपाय|लेबेस्ग माप]] है। यदि माप {{math|''m''}} स्वयं में एक प्रायिकता वितरण है औऱ सापेक्ष एन्ट्रॉपी गैर-ऋणात्मक है और यदि {{math|''p'' {{=}} ''m''}} उपायों के रूप में शून्य है। यह किसी भी माप स्थान के लिए परिभाषित किया गया है। इसलिए समन्वय पुनर्मूल्यांकन के अनुसार स्वतंत्र और अपरिवर्तनीय समन्वय करें। यदि कोई माप {{math|''m''}} के परिवर्तन को ठीक से ध्यान में रखता है। सापेक्ष एन्ट्रॉपी और (निहित रूप से) एंट्रॉपी और अंतर एंट्रॉपी, संदर्भ माप {{math|''m''}} पर निर्भर करते हैं। | ||

== कॉम्बिनेटरिक्स में प्रयोग करें == | == कॉम्बिनेटरिक्स में प्रयोग करें == | ||

| Line 314: | Line 312: | ||

===लूमिस–व्हिटनी असमानता=== | ===लूमिस–व्हिटनी असमानता=== | ||

इसका एक सरल उदाहरण लूमिस-व्हिटनी असमानता का एक वैकल्पिक प्रमाण | इसका एक सरल उदाहरण लूमिस-व्हिटनी असमानता का एक वैकल्पिक प्रमाण प्रत्येक उपसमुच्चय के लिए {{math|''A'' ⊆ '''Z'''<sup>''d''</sup>}} है। हमारे पास है- | ||

:<math> |A|^{d-1}\leq \prod_{i=1}^{d} |P_{i}(A)|</math> | :<math> |A|^{d-1}\leq \prod_{i=1}^{d} |P_{i}(A)|</math> | ||

जहाँ {{math|''P''<sub>''i''</sub>}} में [[ऑर्थोगोनल प्रक्षेपण]] {{math|''i''}}वां निर्देशांक है: | |||

:<math> P_{i}(A)=\{(x_{1}, \ldots, x_{i-1}, x_{i+1}, \ldots, x_{d}) : (x_{1}, \ldots, x_{d})\in A\}.</math> | :<math> P_{i}(A)=\{(x_{1}, \ldots, x_{i-1}, x_{i+1}, \ldots, x_{d}) : (x_{1}, \ldots, x_{d})\in A\}.</math> | ||

प्रमाण शियर्र की असमानता के सरल परिणाम के रूप में अनुसरण करता है: यदि {{math|''X''<sub>1</sub>, ..., ''X''<sub>''d''</sub>}} यादृच्छिक चर हैं और {{math|''S''<sub>1</sub>, ..., ''S''<sub>''n''</sub>}} के उपसमुच्चय | प्रमाण शियर्र की असमानता के सरल परिणाम के रूप में अनुसरण करता है: यदि {{math|''X''<sub>1</sub>, ..., ''X''<sub>''d''</sub>}} यादृच्छिक चर हैं और {{math|''S''<sub>1</sub>, ..., ''S''<sub>''n''</sub>}} के उपसमुच्चय {{math|{1, ..., ''d''}}} हैं। जैसे कि प्रत्येक पूर्णांक 1 और के बीच {{math|''d''}} बिल्कुल निहित है। {इन उपसमुच्चयों में से}, तब- | ||

:<math> \Eta[(X_{1}, \ldots ,X_{d})]\leq \frac{1}{r}\sum_{i=1}^{n}\Eta[(X_{j})_{j\in S_{i}}]</math> | :<math> \Eta[(X_{1}, \ldots ,X_{d})]\leq \frac{1}{r}\sum_{i=1}^{n}\Eta[(X_{j})_{j\in S_{i}}]</math> | ||

जहाँ <math> (X_{j})_{j\in S_{i}}</math> यादृच्छिक चर का कार्टेशियन उत्पाद {{math|''X''<sub>''j''</sub>}} अनुक्रमणिका के साथ {{math|''j''}} में {{math|''S''<sub>''i''</sub>}} है। (इसलिए इस सदिश का आयाम {{math|''S''<sub>''i''</sub>}} के आकार के बराबर है।). | |||

हम स्केच करते हैं कि लूमिस-व्हिटनी इससे कैसे अनुसरण करता | हम स्केच करते हैं कि लूमिस-व्हिटनी इससे कैसे अनुसरण करता है। यथार्थ रूप में {{math|''X''}} मूल्यों के साथ एक समान रूप से वितरित यादृच्छिक चर {{math|''A''}} हो और जिससे प्रत्येक बिंदु में {{math|''A''}} समान प्रायिकता के साथ होता है। तब (उपर्युक्त एंट्रॉपी के और गुणों द्वारा) {{math|Η(''X'') {{=}} log{{abs|''A''}}}}, जहाँ {{math|{{abs|''A''}}}} की प्रमुखता {{math|''A''}} को दर्शाता है। माना कि {{math|''S''<sub>''i''</sub> {{=}} {1, 2, ..., ''i''−1, ''i''+1, ..., ''d''}}}. <math>(X_{j})_{j\in S_{i}}</math> की सीमा {{math|''P''<sub>''i''</sub>(''A'')}} में निहित है और इसलिए <math> \Eta[(X_{j})_{j\in S_{i}}]\leq \log |P_{i}(A)|</math> अब इसका उपयोग शियरर की असमानता के दाहिने पक्ष को बाध्य करने के लिए करें और परिणामी असमानता के विपरीत पक्षों को प्रतिपादित करें। | ||

=== द्विपद गुणांक का सन्निकटन === | === द्विपद गुणांक का सन्निकटन === | ||

{{math|0 < ''k'' < ''n''}} पूर्णांकों के लिए माना कि {{math|''q'' {{=}} ''k''/''n''}}. तब- | |||

:<math>\frac{2^{n\Eta(q)}}{n+1} \leq \tbinom nk \leq 2^{n\Eta(q)},</math> | :<math>\frac{2^{n\Eta(q)}}{n+1} \leq \tbinom nk \leq 2^{n\Eta(q)},</math> | ||

जहाँ | |||

:<math>\Eta(q) = -q \log_2(q) - (1-q) \log_2(1-q).</math><ref>Aoki, New Approaches to Macroeconomic Modeling.</ref>{{rp|43}} | :<math>\Eta(q) = -q \log_2(q) - (1-q) \log_2(1-q).</math><ref>Aoki, New Approaches to Macroeconomic Modeling.</ref>{{rp|43}} | ||

| Line 339: | Line 337: | ||

since there are {{math|''n'' + 1}} terms in the summation. Rearranging gives the lower bound. | since there are {{math|''n'' + 1}} terms in the summation. Rearranging gives the lower bound. | ||

|} | |} | ||

इसकी एक अच्छी व्याख्या यह है कि लंबाई के बाइनरी स्ट्रिंग्स की संख्या {{math|''n''}} के साथ बिल्कुल {{math|''k''}} अनेक 1 लगभग | इसकी एक अच्छी व्याख्या यह है कि लंबाई के बाइनरी स्ट्रिंग्स की संख्या {{math|''n''}} के साथ बिल्कुल {{math|''k''}} अनेक 1 लगभग <math>2^{n\Eta(k/n)}</math> है।<ref>Probability and Computing, M. Mitzenmacher and E. Upfal, Cambridge University Press</ref> | ||

== मशीन लर्निंग में प्रयोग == | == मशीन लर्निंग में प्रयोग == | ||

मशीन लर्निंग | मशीन लर्निंग प्रणाली अधिक सीमा तक सांख्यिकी और सूचना सिद्धांत से भी उत्पन्न होती है। सामान्यतः एन्ट्रॉपी अनिश्चितता का एक उपाय है और मशीन लर्निंग का उद्देश्य अनिश्चितता को कम करना है। | ||

डिसीजन ट्री लर्निंग एल्गोरिदम प्रत्येक नोड पर डेटा को नियंत्रित करने वाले निर्णय नियमों को निर्धारित करने के लिए सापेक्ष एन्ट्रॉपी का उपयोग करते हैं।<ref>{{Cite journal|last1=Batra|first1=Mridula|last2=Agrawal|first2=Rashmi|date=2018|editor-last=Panigrahi|editor-first=Bijaya Ketan|editor2-last=Hoda|editor2-first=M. N.|editor3-last=Sharma|editor3-first=Vinod|editor4-last=Goel|editor4-first=Shivendra|title=डिसीजन ट्री एल्गोरिदम का तुलनात्मक विश्लेषण|url=https://link.springer.com/chapter/10.1007/978-981-10-6747-1_4|journal=Nature Inspired Computing|series=Advances in Intelligent Systems and Computing|volume=652|language=en|location=Singapore|publisher=Springer|pages=31–36|doi=10.1007/978-981-10-6747-1_4|isbn=978-981-10-6747-1}}</ref> [[निर्णय पेड़ों में सूचना लाभ|डिसीजन ट्री में सूचना लाभ]] <math>IG(Y,X)</math>, जो <math>Y</math>की एन्ट्रॉपी के बीच के अंतर के बराबर है और <math>Y</math> की सशर्त एन्ट्रॉपी दिया गया <math>X</math>, किसी विशेषता के अतिरिक्त मूल्य को जानने से अपेक्षित जानकारी या एन्ट्रॉपी <math>X</math> में कमी की मात्रा निर्धारित करता है। सूचना लाभ का उपयोग यह पहचानने के लिए किया जाता है कि डेटासेट की कौन सी विशेषताएँ सबसे अधिक जानकारी प्रदान करती हैं और इसका उपयोग ट्री के नोड्स को उत्तम प्रकार से विभाजित करने के लिए किया जाना चाहिए। | |||

बायेसियन अनुमान मॉडल | बायेसियन अनुमान मॉडल अधिकांशतः प्रायिक प्रायिकता वितरण प्राप्त करने के लिए अधिकतम एन्ट्रॉपी के सिद्धांत को संचालित करते हैं।<ref>{{Cite journal|last=Jaynes|first=Edwin T.|date=September 1968|title=पूर्व संभावनाएं|url=https://ieeexplore.ieee.org/document/4082152|journal=IEEE Transactions on Systems Science and Cybernetics|volume=4|issue=3|pages=227–241|doi=10.1109/TSSC.1968.300117|issn=2168-2887}}</ref> विचार यह है कि वितरण जो एक प्रणाली के ज्ञान की वर्तमान स्थिति का सबसे अच्छा प्रतिनिधित्व करता है। वह सबसे बड़ी एन्ट्रॉपी वाला है और इसलिए पूर्व होने के लिए उपयुक्त है। | ||

[[ संभार तन्त्र परावर्तन ]] या [[ कृत्रिम तंत्रिका नेटवर्क ]] द्वारा किए गए [[मशीन लर्निंग में वर्गीकरण]] | [[ संभार तन्त्र परावर्तन |संभार तन्त्र परावर्तन]] या [[ कृत्रिम तंत्रिका नेटवर्क |कृत्रिम तंत्रिका नेटवर्क]] द्वारा किए गए [[मशीन लर्निंग में वर्गीकरण]] अधिकांशतः एक मानक हानि फलन को नियोजित करता है। जिसे [[क्रॉस एन्ट्रापी|क्रॉस एन्ट्रॉपी]] लॉस कहा जाता है। जो सतही ट्रुथ और अनुमानित वितरण के बीच औसत क्रॉस एन्ट्रॉपी को कम करता है।<ref>{{Cite book|last1=Rubinstein|first1=Reuven Y.|url=https://books.google.com/books?id=8KgACAAAQBAJ&dq=machine+learning+cross+entropy+loss+introduction&pg=PA1|title=The Cross-Entropy Method: A Unified Approach to Combinatorial Optimization, Monte-Carlo Simulation and Machine Learning|last2=Kroese|first2=Dirk P.|date=2013-03-09|publisher=Springer Science & Business Media|isbn=978-1-4757-4321-0|language=en}}</ref> सामान्यतः क्रॉस एंट्रॉपी KL डाइवर्जेंस (जिसे सापेक्ष एंट्रॉपी भी कहा जाता है) के समान दो डेटासेट के बीच अंतर का एक उपाय है। | ||

== यह भी देखें == | == यह भी देखें == | ||

{{Portal|Mathematics}} | {{Portal|Mathematics}} | ||

{{colbegin}} | {{colbegin}} | ||

* [[अनुमानित एन्ट्रापी]] ( | * [[अनुमानित एन्ट्रापी]] (ए पी ई एन) | ||

* [[एंट्रॉपी (थर्मोडायनामिक्स)]] | * [[एंट्रॉपी (थर्मोडायनामिक्स)]] | ||

*क्रॉस एन्ट्रापी - दो संभाव्यता वितरणों के बीच संभावनाओं के एक | *क्रॉस एन्ट्रापी - दो संभाव्यता वितरणों के बीच संभावनाओं के एक समूह से एक घटना की पहचान करने के लिए आवश्यक बिट्स की औसत संख्या का एक उपाय है। | ||

* [[एंट्रॉपी (समय का तीर)]] | * [[एंट्रॉपी (समय का तीर)]] | ||

*[[एंट्रॉपी एन्कोडिंग]] - एक कोडिंग योजना जो प्रतीकों को कोड प्रदान करती | *[[एंट्रॉपी एन्कोडिंग]] - एक कोडिंग योजना जो प्रतीकों को कोड प्रदान करती है। जिससे प्रतीकों की संभावनाओं के साथ कोड की लंबाई का मिलान किया जा सके। | ||

* एंट्रॉपी अनुमान | * एंट्रॉपी अनुमान | ||

* [[एन्ट्रापी शक्ति असमानता]] | * [[एन्ट्रापी शक्ति असमानता]] | ||

* | *फिसर की जानकारी | ||

* [[ग्राफ एन्ट्रापी]] | * [[ग्राफ एन्ट्रापी]] | ||

* [[हैमिंग दूरी]] | * [[हैमिंग दूरी]] | ||

| Line 376: | Line 374: | ||

* रेनी एंट्रॉपी - शैनन एंट्रॉपी का एक सामान्यीकरण; यह एक प्रणाली की विविधता, अनिश्चितता या यादृच्छिकता को मापने के लिए कार्यात्मकताओं के परिवार में से एक है। | * रेनी एंट्रॉपी - शैनन एंट्रॉपी का एक सामान्यीकरण; यह एक प्रणाली की विविधता, अनिश्चितता या यादृच्छिकता को मापने के लिए कार्यात्मकताओं के परिवार में से एक है। | ||

*यादृच्छिकता | *यादृच्छिकता | ||

*[[नमूना एन्ट्रापी]] ( | *[[नमूना एन्ट्रापी]] (सैम्पेन) | ||

* [[शैनन इंडेक्स]] | * [[शैनन इंडेक्स]] | ||

*[[ भाग सूचकांक ]] | *[[ भाग सूचकांक ]] | ||

| Line 410: | Line 408: | ||

{{Compression Methods}} | {{Compression Methods}} | ||

{{Authority control}} | {{Authority control}} | ||

[[Category: | [[Category:Articles with hatnote templates targeting a nonexistent page]] | ||

[[Category:CS1 English-language sources (en)]] | |||

[[Category:CS1 maint]] | |||

[[Category:Collapse templates]] | |||

[[Category:Created On 24/04/2023]] | [[Category:Created On 24/04/2023]] | ||

[[Category:Data compression]] | |||

[[Category:Lua-based templates]] | |||

[[Category:Machine Translated Page]] | |||

[[Category:Multi-column templates]] | |||

[[Category:Navigational boxes| ]] | |||

[[Category:Navigational boxes without horizontal lists]] | |||

[[Category:Pages using div col with small parameter]] | |||

[[Category:Pages with empty portal template]] | |||

[[Category:Pages with script errors]] | |||

[[Category:Portal templates with redlinked portals]] | |||

[[Category:Sidebars with styles needing conversion]] | |||

[[Category:Template documentation pages|Documentation/doc]] | |||

[[Category:Templates Vigyan Ready]] | |||

[[Category:Templates generating microformats]] | |||

[[Category:Templates that add a tracking category]] | |||

[[Category:Templates that are not mobile friendly]] | |||

[[Category:Templates using TemplateData]] | |||

[[Category:Templates using under-protected Lua modules]] | |||

[[Category:Wikipedia articles incorporating text from PlanetMath|एंट्रॉपी (सूचना सिद्धांत)]] | |||

[[Category:Wikipedia fully protected templates|Div col]] | |||

[[Category:Wikipedia metatemplates]] | |||

[[Category:एंट्रॉपी और सूचना| एंट्रॉपी और सूचना ]] | |||

[[Category:सांख्यिकीय यादृच्छिकता]] | |||

[[Category:सूचना सिद्धांत]] | |||

Latest revision as of 18:24, 16 May 2023

| Information theory |

|---|

|

सूचना सिद्धांत में चर के संभावित परिणामों में निहित "सूचना", "सरप्राइज" या "अनिश्चितता" का औसत स्तर स्थित है। असतत यादृच्छिक चर दिया गया है। जो वर्णमाला में मान दर्शाता है और के अनुसार वितरित किया जाता है:

क्लाउड शैनन ने अपने 1948 के पेपर संचार का एक गणितीय सिद्धांत में सूचना एन्ट्रॉपी की अवधारणा को प्रस्तुत किया [2][3] और इसे एक नये नाम शैनन एंट्रॉपी से भी जाना जाता है। शैनन का सिद्धांत डेटा संचार प्रणाली के तीन तत्वों से मिलकर बना हुआ है। जो कि निम्न हैं- डेटा का स्रोत, संचार चैनल और एक रिसीवर। जैसा कि शैनन द्वारा प्रदर्शित किया गया है कि संचार की मौलिक कठिनता रिसीवर के लिए यह पहचानने में सक्षम होना है कि चैनल के माध्यम से प्राप्त सिग्नल के आधार पर स्रोत द्वारा कौन सा डेटा उत्पन्न किया गया था।[2][3] शैनन ने डेटा स्रोत से संदेशों को इनकोड, कंप्रेस और ट्रांसमिट करने के विभिन्न प्रकारों पर विचार किया और अपने प्रसिद्ध शैनन के स्रोत कोडिंग प्रमेय में प्रमाणित किया कि एन्ट्रॉपी एक पूर्ण गणितीय सीमा का प्रतिनिधित्व करती है कि स्रोत से डेटा को न्वाइस-चैनल पर बिना त्रुटि रूप से कैसे संकुचित किया जा सकता है। शैनन ने अपने न्वाइस-चैनल कोडिंग प्रमेय में न्वाइस चैनलों के लिए इस परिणाम को अधिक शक्तिशाली बनाया है।