अपर्यवेक्षित अधिगम: Difference between revisions

(Created page with "{{Short description|Machine learning task}} {{Machine learning|Problems}} अनपर्यवेक्षित अध्ययन उन एल्गोरिदम...") |

No edit summary |

||

| Line 1: | Line 1: | ||

{{Short description|Machine learning task}} | {{Short description|Machine learning task}} | ||

{{Machine learning| | {{Machine learning|समस्या}} | ||

अन[[ पर्यवेक्षित अध्ययन ]] उन एल्गोरिदम को संदर्भित करता है जो बिना लेबल वाले डेटा से पैटर्न सीखते हैं। | अन[[ पर्यवेक्षित अध्ययन ]] उन एल्गोरिदम को संदर्भित करता है जो बिना लेबल वाले डेटा से पैटर्न सीखते हैं। | ||

| Line 25: | Line 25: | ||

{| class="wikitable" | {| class="wikitable" | ||

|- | |- | ||

! | ! हॉपफ़ील्ड !! बोल्ट्ज़मैन !! आरबीएम !! स्टैक्ड बोल्ट्ज़मैन | ||

|- | |- | ||

| [[File:Hopfield-net-vector.svg |thumb| | | [[File:Hopfield-net-vector.svg |thumb|एकल स्व-जुड़ी परत के साथ लोहे में चुंबकीय डोमेन पर आधारित एक नेटवर्क। इसका उपयोग कंटेंट एड्रेसेबल मेमोरी के रूप में किया जा सकता है।]] | ||

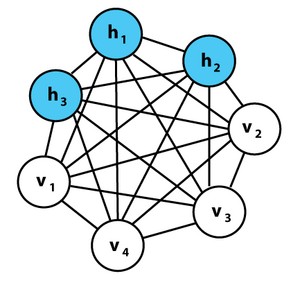

|| [[File:Boltzmannexamplev1.png |thumb| | || [[File:Boltzmannexamplev1.png |thumb|नेटवर्क को 2 परतों (छिपे हुए बनाम दृश्यमान) में विभाजित किया गया है, लेकिन फिर भी सममित 2-तरफ़ा वज़न का उपयोग किया जाता है। बोल्ट्ज़मैन के थर्मोडायनामिक्स के बाद, व्यक्तिगत संभावनाएं स्थूल ऊर्जा को जन्म देती हैं।]] | ||

|| [[File:Restricted Boltzmann machine.svg|thumb| | || [[File:Restricted Boltzmann machine.svg|thumb|प्रतिबंधित बोल्ट्ज़मैन मशीन। यह एक बोल्ट्ज़मैन मशीन है जहां विश्लेषण को सुव्यवस्थित बनाने के लिए एक परत के भीतर पार्श्व कनेक्शन निषिद्ध है।]] | ||

|| [[File:Stacked-boltzmann.png|thumb| | || [[File:Stacked-boltzmann.png|thumb| इस नेटवर्क में छिपी हुई विशेषताओं के पदानुक्रम को एनकोड करने के लिए कई आरबीएम हैं। एक आरबीएम को प्रशिक्षित करने के बाद, एक और नीली छिपी हुई परत (बाएं आरबीएम देखें) जोड़ी जाती है, और शीर्ष 2 परतों को लाल और नीले आरबीएम के रूप में प्रशिक्षित किया जाता है। इस प्रकार आरबीएम की मध्य परतें छिपी या दृश्यमान के रूप में कार्य करती हैं, यह इस बात पर निर्भर करता है कि यह किस प्रशिक्षण चरण में है।]] | ||

|} | |} | ||

Revision as of 23:03, 30 June 2023

| Part of a series on |

| Machine learning and data mining |

|---|

|

अनपर्यवेक्षित अध्ययन उन एल्गोरिदम को संदर्भित करता है जो बिना लेबल वाले डेटा से पैटर्न सीखते हैं।

पर्यवेक्षित शिक्षण के विपरीत, जहां मॉडल इनपुट को लक्ष्य आउटपुट में मैप करना सीखते हैं (उदाहरण के लिए बिल्ली या मछली के रूप में लेबल की गई छवियां), बिना पर्यवेक्षित तरीके इनपुट डेटा का संक्षिप्त प्रतिनिधित्व सीखते हैं, जिसका उपयोग डेटा अन्वेषण या विश्लेषण या नए उत्पन्न करने के लिए किया जा सकता है आंकड़े। पर्यवेक्षण स्पेक्ट्रम में अन्य स्तर सुदृढीकरण शिक्षण हैं जहां मशीन को मार्गदर्शन के रूप में केवल एक प्रदर्शन स्कोर दिया जाता है, और अर्ध-पर्यवेक्षित शिक्षण जहां प्रशिक्षण डेटा का केवल एक हिस्सा लेबल किया जाता है।

तंत्रिका नेटवर्क

कार्य बनाम विधियाँ

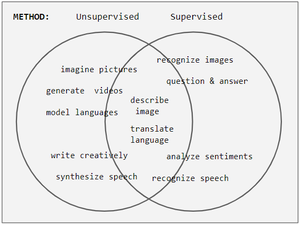

तंत्रिका नेटवर्क कार्यों को अक्सर भेदभावपूर्ण (मान्यता) या उत्पादक (कल्पना) के रूप में वर्गीकृत किया जाता है। अक्सर लेकिन हमेशा नहीं, भेदभावपूर्ण कार्यों में पर्यवेक्षित तरीकों का उपयोग किया जाता है और जेनरेटर कार्यों में बिना पर्यवेक्षित तरीकों का उपयोग किया जाता है (वेन आरेख देखें); हालाँकि, अलगाव बहुत धुंधला है। उदाहरण के लिए, वस्तु पहचान पर्यवेक्षित शिक्षण को बढ़ावा देती है लेकिन बिना पर्यवेक्षित शिक्षण भी वस्तुओं को समूहों में विभाजित कर सकता है। इसके अलावा, जैसे-जैसे प्रगति आगे बढ़ती है, कुछ कार्य दोनों तरीकों का उपयोग करते हैं, और कुछ कार्य एक से दूसरे की ओर झूलते रहते हैं। उदाहरण के लिए, छवि पहचान की शुरुआत अत्यधिक निगरानी के साथ हुई, लेकिन बिना पर्यवेक्षित पूर्व-प्रशिक्षण को नियोजित करने से यह हाइब्रिड हो गई, और फिर डिल्यूशन_(न्यूरल_नेटवर्क्स), रेक्टिफायर_(न्यूरल_नेटवर्क्स), और लर्निंग_रेट के आगमन के साथ फिर से पर्यवेक्षण की ओर बढ़ गई।

प्रशिक्षण

सीखने के चरण के दौरान, एक अप्रशिक्षित नेटवर्क दिए गए डेटा की नकल करने की कोशिश करता है और खुद को सही करने के लिए अपने नकल किए गए आउटपुट में त्रुटि का उपयोग करता है (यानी अपने वजन और पूर्वाग्रहों को ठीक करता है)। कभी-कभी त्रुटि को गलत आउटपुट होने की कम संभावना के रूप में व्यक्त किया जाता है, या इसे नेटवर्क में अस्थिर उच्च ऊर्जा स्थिति के रूप में व्यक्त किया जा सकता है।

पर्यवेक्षित तरीकों के पश्चप्रचार के प्रमुख उपयोग के विपरीत, अनसुपरवाइज्ड लर्निंग अन्य तरीकों को भी नियोजित करता है जिनमें शामिल हैं: होपफील्ड लर्निंग नियम, बोल्ट्जमैन लर्निंग नियम, कंट्रास्टिव डाइवर्जेंस, जागो-नींद एल्गोरिथ्म, वेरिएशनल अनुमान, अधिकतम संभावना, अधिकतम ए पोस्टीरियोरी, गिब्स सैंपलिंग और बैकप्रोपेगेटिंग। पुनर्निर्माण त्रुटियाँ या छिपी हुई स्थिति का पुनर्मूल्यांकन। अधिक विवरण के लिए नीचे दी गई तालिका देखें।

ऊर्जा

एक ऊर्जा फ़ंक्शन किसी नेटवर्क की सक्रियण स्थिति का एक स्थूल माप है। बोल्ट्ज़मैन मशीनों में, यह लागत फ़ंक्शन की भूमिका निभाता है। भौतिकी के साथ यह सादृश्य कण गति की सूक्ष्म संभावनाओं से गैस की स्थूल ऊर्जा के लुडविग बोल्ट्जमैन के विश्लेषण से प्रेरित है। , जहां k बोल्ट्जमैन स्थिरांक है और T तापमान है। Restricted_Boltzmann_machine नेटवर्क में संबंध है ,[1]कहाँ और प्रत्येक संभावित सक्रियण पैटर्न में भिन्नता होती है और . अधिक स्पष्ट करने के लिए, , कहाँ सभी न्यूरॉन्स (दृश्यमान और छिपे हुए) का एक सक्रियण पैटर्न है। इसलिए, प्रारंभिक तंत्रिका नेटवर्क का नाम बोल्ट्ज़मैन मशीन है। पॉल स्मोलेंस्की कॉल करता है सद्भाव. एक नेटवर्क कम ऊर्जा चाहता है जो उच्च सद्भाव है।

नेटवर्क

यह तालिका विभिन्न गैर-पर्यवेक्षित नेटवर्कों के कनेक्शन आरेख दिखाती है, जिनका विवरण नेटवर्क की तुलना अनुभाग में दिया जाएगा। वृत्त न्यूरॉन्स हैं और उनके बीच के किनारे कनेक्शन भार हैं। जैसे-जैसे नेटवर्क डिज़ाइन बदलता है, नई क्षमताओं को सक्षम करने के लिए सुविधाएँ जोड़ी जाती हैं या सीखने को तेज़ बनाने के लिए हटा दी जाती हैं। उदाहरण के लिए, मजबूत आउटपुट की अनुमति देने के लिए न्यूरॉन्स नियतात्मक (हॉपफील्ड) और स्टोकेस्टिक (बोल्ट्ज़मैन) के बीच बदलते हैं, सीखने में तेजी लाने के लिए एक परत (आरबीएम) के भीतर वजन हटा दिया जाता है, या कनेक्शन को असममित (हेल्महोल्ट्ज़) बनने की अनुमति दी जाती है।

| Helmholtz | Autoencoder | VAE |

|---|---|---|

लोगों के नाम वाले नेटवर्क में से केवल होपफ़ील्ड ने सीधे तंत्रिका नेटवर्क के साथ काम किया। बोल्ट्ज़मैन और हेल्महोल्ट्ज़ कृत्रिम तंत्रिका नेटवर्क से पहले आए थे, लेकिन भौतिकी और शरीर विज्ञान में उनके काम ने इस्तेमाल की जाने वाली विश्लेषणात्मक विधियों को प्रेरित किया।

इतिहास

| 1969 | Perceptrons by Minsky & Papert shows a perceptron without hidden layers fails on XOR |

| 1970s | (approximate dates) First AI winter |

| 1974 | Ising magnetic model proposed by WA Little for cognition |

| 1980 | Fukushima introduces the neocognitron, which is later called a convolution neural network. It is mostly used in SL, but deserves a mention here. |

| 1982 | Ising variant Hopfield net described as CAMs and classifiers by John Hopfield. |

| 1983 | Ising variant Boltzmann machine with probabilistic neurons described by Hinton & Sejnowski following Sherington & Kirkpatrick's 1975 work. |

| 1986 | Paul Smolensky publishes Harmony Theory, which is an RBM with practically the same Boltzmann energy function. Smolensky did not give a practical training scheme. Hinton did in mid-2000s |

| 1995 | Schmidthuber introduces the LSTM neuron for languages. |

| 1995 | Dayan & Hinton introduces Helmholtz machine |

| 1995-2005 | (approximate dates) Second AI winter |

| 2013 | Kingma, Rezende, & co. introduced Variational Autoencoders as Bayesian graphical probability network, with neural nets as components. |

विशिष्ट नेटवर्क

यहां, हम चुनिंदा नेटवर्क की कुछ विशेषताओं पर प्रकाश डालते हैं। प्रत्येक का विवरण नीचे तुलना तालिका में दिया गया है।

- Hopfield Network

- Ferromagnetism inspired Hopfield networks. A neuron correspond to an iron domain with binary magnetic moments Up and Down, and neural connections correspond to the domain's influence on each other. Symmetric connections enable a global energy formulation. During inference the network updates each state using the standard activation step function. Symmetric weights and the right energy functions guarantees convergence to a stable activation pattern. Asymmetric weights are difficult to analyze. Hopfield nets are used as Content Addressable Memories (CAM).

- Boltzmann Machine

- These are stochastic Hopfield nets. Their state value is sampled from this pdf as follows: suppose a binary neuron fires with the Bernoulli probability p(1) = 1/3 and rests with p(0) = 2/3. One samples from it by taking a UNIFORMLY distributed random number y, and plugging it into the inverted cumulative distribution function, which in this case is the step function thresholded at 2/3. The inverse function = { 0 if x <= 2/3, 1 if x > 2/3 }

- Sigmoid Belief Net

- Introduced by Radford Neal in 1992, this network applies ideas from probabilistic graphical models to neural networks. A key difference is that nodes in graphical models have pre-assigned meanings, whereas Belief Net neurons' features are determined after training. The network is a sparsely connected directed acyclic graph composed of binary stochastic neurons. The learning rule comes from Maximum Likelihood on p(X): Δwij sj * (si - pi), where pi = 1 / ( 1 + eweighted inputs into neuron i ). sj's are activations from an unbiased sample of the posterior distribution and this is problematic due to the Explaining Away problem raised by Judea Perl. Variational Bayesian methods uses a surrogate posterior and blatantly disregard this complexity.

- Deep Belief Network

- Introduced by Hinton, this network is a hybrid of RBM and Sigmoid Belief Network. The top 2 layers is an RBM and the second layer downwards form a sigmoid belief network. One trains it by the stacked RBM method and then throw away the recognition weights below the top RBM. As of 2009, 3-4 layers seems to be the optimal depth.[2]

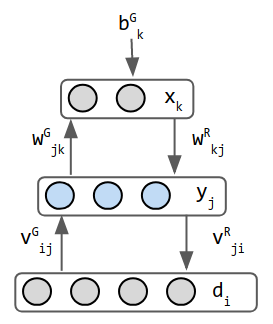

- Helmholtz machine

- These are early inspirations for the Variational Auto Encoders. It's 2 networks combined into one—forward weights operates recognition and backward weights implements imagination. It is perhaps the first network to do both. Helmholtz did not work in machine learning but he inspired the view of "statistical inference engine whose function is to infer probable causes of sensory input" (3). the stochastic binary neuron outputs a probability that its state is 0 or 1. The data input is normally not considered a layer, but in the Helmholtz machine generation mode, the data layer receives input from the middle layer has separate weights for this purpose, so it is considered a layer. Hence this network has 3 layers.

- Variational autoencoder

- These are inspired by Helmholtz machines and combines probability network with neural networks. An Autoencoder is a 3-layer CAM network, where the middle layer is supposed to be some internal representation of input patterns. The encoder neural network is a probability distribution qφ(z given x) and the decoder network is pθ(x given z). The weights are named phi & theta rather than W and V as in Helmholtz—a cosmetic difference. These 2 networks here can be fully connected, or use another NN scheme.

नेटवर्क की तुलना

| Hopfield | Boltzmann | RBM | Stacked RBM | Helmholtz | Autoencoder | VAE | |

|---|---|---|---|---|---|---|---|

| Usage & notables | CAM, traveling salesman problem | CAM. The freedom of connections makes this network difficult to analyze. | pattern recognition. used in MNIST digits and speech. | recognition & imagination. trained with unsupervised pre-training and/or supervised fine tuning. | imagination, mimicry | language: creative writing, translation. vision: enhancing blurry images | generate realistic data |

| Neuron | deterministic binary state. Activation = { 0 (or -1) if x is negative, 1 otherwise } | stochastic binary Hopfield neuron | ← same. (extended to real-valued in mid 2000s) | ← same | ← same | language: LSTM. vision: local receptive fields. usually real valued relu activation. | middle layer neurons encode means & variances for Gaussians. In run mode (inference), the output of the middle layer are sampled values from the Gaussians. |

| Connections | 1-layer with symmetric weights. No self-connections. | 2-layers. 1-hidden & 1-visible. symmetric weights. | ← same. no lateral connections within a layer. |

top layer is undirected, symmetric. other layers are 2-way, asymmetric. | 3-layers: asymmetric weights. 2 networks combined into 1. | 3-layers. The input is considered a layer even though it has no inbound weights. recurrent layers for NLP. feedforward convolutions for vision. input & output have the same neuron counts. | 3-layers: input, encoder, distribution sampler decoder. the sampler is not considered a layer (e) |

| Inference & energy | Energy is given by Gibbs probability measure : | ← same | ← same | minimize KL divergence | inference is only feed-forward. previous UL networks ran forwards AND backwards | minimize error = reconstruction error - KLD | |

| Training | Δwij = si*sj, for +1/-1 neuron | Δwij = e*(pij - p'ij). This is derived from minimizing KLD. e = learning rate, p' = predicted and p = actual distribution. | Δwij = e*( < vi hj >data - < vi hj >equilibrium ). This is a form of contrastive divergence w/ Gibbs Sampling. "<>" are expectations. | ← similar. train 1-layer at a time. approximate equilibrium state with a 3-segment pass. no back propagation. | wake-sleep 2 phase training | back propagate the reconstruction error | reparameterize hidden state for backprop |

| Strength | resembles physical systems so it inherits their equations | ← same. hidden neurons act as internal representatation of the external world | faster more practical training scheme than Boltzmann machines | trains quickly. gives hierarchical layer of features | mildly anatomical. analyzable w/ information theory & statistical mechanics | ||

| Weakness | hard to train due to lateral connections | equilibrium requires too many iterations | integer & real-valued neurons are more complicated. |

हेब्बियन लर्निंग, एआरटी, एसओएम

तंत्रिका नेटवर्क के अध्ययन में अपर्यवेक्षित शिक्षण का शास्त्रीय उदाहरण डोनाल्ड हेब्ब का सिद्धांत है, यानी, न्यूरॉन्स जो एक साथ तार से आग लगाते हैं।[3]हेब्बियन सीखने में, किसी त्रुटि के बावजूद कनेक्शन को मजबूत किया जाता है, लेकिन यह विशेष रूप से दो न्यूरॉन्स के बीच कार्रवाई क्षमता के बीच संयोग का एक कार्य है।[4]एक समान संस्करण जो सिनैप्टिक भार को संशोधित करता है वह एक्शन पोटेंशिअल (स्पाइक-टाइमिंग-निर्भर प्लास्टिसिटी या एसटीडीपी) के बीच के समय को ध्यान में रखता है। हेब्बियन लर्निंग को पैटर्न पहचान और अनुभवात्मक शिक्षा जैसे संज्ञानात्मक कार्यों की एक श्रृंखला को रेखांकित करने के लिए परिकल्पित किया गया है।

कृत्रिम तंत्रिका नेटवर्क मॉडल के बीच, स्व-संगठित मानचित्र (एसओएम) और अनुकूली अनुनाद सिद्धांत (एआरटी) का उपयोग आमतौर पर बिना पर्यवेक्षित शिक्षण एल्गोरिदम में किया जाता है। एसओएम एक स्थलाकृतिक संगठन है जिसमें मानचित्र में आस-पास के स्थान समान गुणों वाले इनपुट का प्रतिनिधित्व करते हैं। एआरटी मॉडल समस्या के आकार के साथ समूहों की संख्या को अलग-अलग करने की अनुमति देता है और उपयोगकर्ता को सतर्कता पैरामीटर नामक उपयोगकर्ता-परिभाषित स्थिरांक के माध्यम से समान क्लस्टर के सदस्यों के बीच समानता की डिग्री को नियंत्रित करने देता है। एआरटी नेटवर्क का उपयोग कई पैटर्न पहचान कार्यों के लिए किया जाता है, जैसे स्वचालित लक्ष्य पहचान और भूकंपीय सिग्नल प्रोसेसिंग।[5]

संभाव्य विधियाँ

बिना पर्यवेक्षित शिक्षण में उपयोग की जाने वाली दो मुख्य विधियाँ प्रधान घटक विश्लेषण और क्लस्टर विश्लेषण हैं। क्लस्टर विश्लेषण का उपयोग बिना पर्यवेक्षित शिक्षण में एल्गोरिदम संबंधों को एक्सट्रपलेशन करने के लिए साझा विशेषताओं वाले डेटासेट को समूह या खंड में करने के लिए किया जाता है।[6]क्लस्टर विश्लेषण यंत्र अधिगम की एक शाखा है जो उस डेटा को समूहित करती है जिसे लेबल, वर्गीकृत या वर्गीकृत नहीं किया गया है। फीडबैक पर प्रतिक्रिया देने के बजाय, क्लस्टर विश्लेषण डेटा में समानताओं की पहचान करता है और डेटा के प्रत्येक नए टुकड़े में ऐसी समानताओं की उपस्थिति या अनुपस्थिति के आधार पर प्रतिक्रिया करता है। यह दृष्टिकोण उन असंगत डेटा बिंदुओं का पता लगाने में मदद करता है जो किसी भी समूह में फिट नहीं होते हैं।

अपर्यवेक्षित शिक्षण का एक केंद्रीय अनुप्रयोग सांख्यिकी में घनत्व अनुमान के क्षेत्र में है,[7]हालाँकि बिना पर्यवेक्षित शिक्षण में डेटा सुविधाओं का सारांश और व्याख्या करने वाले कई अन्य डोमेन शामिल हैं। इसकी तुलना पर्यवेक्षित शिक्षण से यह कहकर की जा सकती है कि जबकि पर्यवेक्षित शिक्षण का उद्देश्य इनपुट डेटा के लेबल पर सशर्त संभाव्यता वितरण का अनुमान लगाना है; अप्रशिक्षित शिक्षण का उद्देश्य एक प्राथमिक संभाव्यता वितरण का अनुमान लगाना है।

दृष्टिकोण

बिना पर्यवेक्षित शिक्षण में उपयोग किए जाने वाले कुछ सबसे आम एल्गोरिदम में शामिल हैं: (1) क्लस्टरिंग, (2) विसंगति का पता लगाना, (3) अव्यक्त चर मॉडल सीखने के लिए दृष्टिकोण। प्रत्येक दृष्टिकोण निम्नानुसार कई विधियों का उपयोग करता है:

- डेटा क्लस्टरिंग विधियों में शामिल हैं: पदानुक्रमित क्लस्टरिंग,[8]k-मतलब,[9]मिश्रण मॉडल, डीबीएससीएएन, और प्रकाशिकी एल्गोरिथ्म

- विसंगति का पता लगाने के तरीकों में शामिल हैं: स्थानीय बाहरी कारक, और अलगाव वन

- अव्यक्त चर मॉडल सीखने के लिए दृष्टिकोण जैसे कि अपेक्षा-अधिकतमकरण एल्गोरिथ्म (ईएम), क्षणों की विधि (सांख्यिकी), और ब्लाइंड सिग्नल पृथक्करण तकनीक (प्रमुख घटक विश्लेषण, स्वतंत्र घटक विश्लेषणगैर-नकारात्मक मैट्रिक्स गुणनखंडन फैक्टराइजेशन, एकवचन मूल्य अपघटन)

क्षणों की विधि

बिना पर्यवेक्षित शिक्षण के लिए सांख्यिकीय दृष्टिकोणों में से एक क्षणों की विधि (सांख्यिकी) है। क्षणों की विधि में, मॉडल में अज्ञात पैरामीटर (रुचि के) एक या अधिक यादृच्छिक चर के क्षणों से संबंधित होते हैं, और इस प्रकार, इन अज्ञात मापदंडों का अनुमान क्षणों को देखते हुए लगाया जा सकता है। क्षणों का अनुमान आमतौर पर अनुभवजन्य रूप से नमूनों से लगाया जाता है। मूल क्षण प्रथम और द्वितीय क्रम के क्षण हैं। एक यादृच्छिक वेक्टर के लिए, पहले क्रम का क्षण माध्य वेक्टर है, और दूसरे क्रम का क्षण सहप्रसरण मैट्रिक्स है (जब माध्य शून्य है)। उच्च क्रम के क्षणों को आमतौर पर टेंसर का उपयोग करके दर्शाया जाता है जो कि बहु-आयामी सरणियों के रूप में उच्च क्रम सहप्रसरण आव्यूह का सामान्यीकरण है।

विशेष रूप से, अव्यक्त चर मॉडल के मापदंडों को सीखने में क्षणों की विधि को प्रभावी दिखाया गया है। अव्यक्त चर मॉडल सांख्यिकीय मॉडल हैं जहां देखे गए चर के अलावा, अव्यक्त चर का एक सेट भी मौजूद होता है जो नहीं देखा जाता है। अर्थ लर्निंग में अव्यक्त चर मॉडल का एक अत्यधिक व्यावहारिक उदाहरण विषय मॉडलिंग है जो दस्तावेज़ के विषय (अव्यक्त चर) के आधार पर दस्तावेज़ में शब्द (अवलोकित चर) उत्पन्न करने के लिए एक सांख्यिकीय मॉडल है। विषय मॉडलिंग में, दस्तावेज़ का विषय बदलने पर दस्तावेज़ में शब्द विभिन्न सांख्यिकीय मापदंडों के अनुसार उत्पन्न होते हैं। यह दिखाया गया है कि क्षणों की विधि (टेंसर अपघटन तकनीक) कुछ मान्यताओं के तहत अव्यक्त चर मॉडल के एक बड़े वर्ग के मापदंडों को लगातार पुनर्प्राप्त करती है।[10]

एक्सपेक्टेशन-मैक्सिमाइजेशन एल्गोरिदम (ईएम) भी अव्यक्त चर मॉडल सीखने के लिए सबसे व्यावहारिक तरीकों में से एक है। हालाँकि, यह स्थानीय ऑप्टिमा में फंस सकता है, और यह गारंटी नहीं है कि एल्गोरिदम मॉडल के वास्तविक अज्ञात मापदंडों में परिवर्तित हो जाएगा। इसके विपरीत, क्षणों की विधि के लिए, कुछ शर्तों के तहत वैश्विक अभिसरण की गारंटी दी जाती है।

यह भी देखें

- स्वचालित मशीन लर्निंग

- क्लस्टर विश्लेषण

- असंगति का पता लगाये

- अपेक्षा-अधिकतमीकरण एल्गोरिथ्म

- जनरेटिव स्थलाकृतिक मानचित्र

- मेटा-लर्निंग (कंप्यूटर विज्ञान)

- बहुभिन्नरूपी विश्लेषण

- रेडियल आधार फ़ंक्शन नेटवर्क

- कमजोर पर्यवेक्षण

संदर्भ

- ↑ Hinton, G. (2012). "A Practical Guide to Training Restricted Boltzmann Machines" (PDF). Neural Networks: Tricks of the Trade. Lecture Notes in Computer Science. Vol. 7700. Springer. pp. 599–619. doi:10.1007/978-3-642-35289-8_32. ISBN 978-3-642-35289-8.

- ↑ Hinton, Geoffrey (September 2009). "Deep Belief Nets" (video).

- ↑ Buhmann, J.; Kuhnel, H. (1992). "Unsupervised and supervised data clustering with competitive neural networks". [Proceedings 1992] IJCNN International Joint Conference on Neural Networks. Vol. 4. IEEE. pp. 796–801. doi:10.1109/ijcnn.1992.227220. ISBN 0780305590. S2CID 62651220.

- ↑ Comesaña-Campos, Alberto; Bouza-Rodríguez, José Benito (June 2016). "An application of Hebbian learning in the design process decision-making". Journal of Intelligent Manufacturing. 27 (3): 487–506. doi:10.1007/s10845-014-0881-z. ISSN 0956-5515. S2CID 207171436.

- ↑ Carpenter, G.A. & Grossberg, S. (1988). "The ART of adaptive pattern recognition by a self-organizing neural network" (PDF). Computer. 21 (3): 77–88. doi:10.1109/2.33. S2CID 14625094.

- ↑ Roman, Victor (2019-04-21). "Unsupervised Machine Learning: Clustering Analysis". Medium. Retrieved 2019-10-01.

- ↑ Jordan, Michael I.; Bishop, Christopher M. (2004). "7. Intelligent Systems §Neural Networks". In Tucker, Allen B. (ed.). Computer Science Handbook (2nd ed.). Chapman & Hall/CRC Press. doi:10.1201/9780203494455. ISBN 1-58488-360-X.

- ↑ Hastie, Tibshirani & Friedman 2009, pp. 485–586

- ↑ Garbade, Dr Michael J. (2018-09-12). "Understanding K-means Clustering in Machine Learning". Medium (in English). Retrieved 2019-10-31.

- ↑ Anandkumar, Animashree; Ge, Rong; Hsu, Daniel; Kakade, Sham; Telgarsky, Matus (2014). "Tensor Decompositions for Learning Latent Variable Models" (PDF). Journal of Machine Learning Research. 15: 2773–2832. arXiv:1210.7559. Bibcode:2012arXiv1210.7559A.

<ref> tag with name "Hinton99a" defined in <references> is not used in prior text.

अग्रिम पठन

- Bousquet, O.; von Luxburg, U.; Raetsch, G., eds. (2004). Advanced Lectures on Machine Learning. Springer. ISBN 978-3540231226.

- Duda, Richard O.; Hart, Peter E.; Stork, David G. (2001). "Unsupervised Learning and Clustering". Pattern classification (2nd ed.). Wiley. ISBN 0-471-05669-3.

- Hastie, Trevor; Tibshirani, Robert; Friedman, Jerome (2009). "Unsupervised Learning". The Elements of Statistical Learning: Data mining, Inference, and Prediction. Springer. pp. 485–586. doi:10.1007/978-0-387-84858-7_14. ISBN 978-0-387-84857-0.

- Hinton, Geoffrey; Sejnowski, Terrence J., eds. (1999). Unsupervised Learning: Foundations of Neural Computation. MIT Press. ISBN 0-262-58168-X.