इवेंट कैमरा: Difference between revisions

(Created page with "{{short description|Type of imaging sensor}} {{Redirect|Silicon retina|visual prosthesis|Artificial silicon retina}} {{Redirect|Dynamic vision sensor|information processing ca...") |

No edit summary |

||

| Line 1: | Line 1: | ||

{{short description|Type of imaging sensor}} | {{short description|Type of imaging sensor}} | ||

{{Redirect| | {{Redirect|सिलिकॉन रेटिना|दृश्य कृत्रिम अंग|कृत्रिम सिलिकॉन रेटिना}} | ||

{{Redirect| | {{Redirect|गतिशील दृष्टि संवेदक|सूचना प्रसंस्करण कैमरे|स्मार्ट विजन सेंसर||दृष्टि संवेदक (बहुविकल्पी){{!}}दृष्टि संवेदक}} | ||

एक इवेंट कैमरा, जिसे | |||

एक इवेंट कैमरा, जिसे तंत्रिकाप्रभावी कैमरा के रूप में भी जाना जाता है,<ref>{{cite journal |last1=Li |first1=Hongmin |last2=Liu |first2=Hanchao |last3=Ji |first3=Xiangyang |last4=Li |first4=Guoqi |last5=Shi |first5=Luping |title=CIFAR10-DVS: An Event-Stream Dataset for Object Classification |journal=Frontiers in Neuroscience |date=2017 |volume=11 |page=309 |doi=10.3389/fnins.2017.00309 |pmid=28611582 |language=English |issn=1662-453X|pmc=5447775 |doi-access=free }}</ref> सिलिकॉन रेटिना<ref>{{cite journal |last1=Sarmadi |first1=Hamid |last2=Muñoz-Salinas |first2=Rafael |last3=Olivares-Mendez |first3=Miguel A. |last4=Medina-Carnicer |first4=Rafael |title=एक इवेंट कैमरा का उपयोग करके बाइनरी स्क्वायर फिडुशियल मार्कर का पता लगाना|journal=IEEE Access |date=2021 |volume=9 |pages=27813–27826 |doi=10.1109/ACCESS.2021.3058423 |url=https://ieeexplore.ieee.org/document/9351958 |issn=2169-3536|arxiv=2012.06516 |s2cid=228375825 }}</ref> या गतिशील दृष्टि संवेदक,<ref>{{cite book |last1=Liu |first1=Min |last2=Delbruck |first2=Tobi |title=2017 IEEE International Symposium on Circuits and Systems (ISCAS) |chapter=Block-matching optical flow for dynamic vision sensors: Algorithm and FPGA implementation |date=May 2017 |pages=1–4 |doi=10.1109/ISCAS.2017.8050295 |arxiv=1706.05415 |isbn=978-1-4673-6853-7 |s2cid=2283149 |url=https://ieeexplore.ieee.org/document/8050295 |access-date=27 June 2021}}</ref> एक [[छवि संवेदक]] है जो चमक में स्थानीय परिवर्तनों पर प्रतिक्रिया करता है। ईवेंट कैमरे कैमरा कपाट (फ़ोटोग्राफ़ी) का उपयोग करके छवियों को अधिकृत नहीं करते हैं जैसा कि [[पारंपरिक (फ़्रेम) कैमरे]] करते हैं। इसके अतिरिक्त , एक घटना कैमरे के अंदर प्रत्येक चित्रांश स्वतंत्र रूप से और अतुल्यकालिक रूप से संचालित होता है, चमक में होने वाले परिवर्तनों की प्रतिवेदन करता है, और अन्यथा निष्क्रिय रहता है। | |||

== कार्यात्मक विवरण == | == कार्यात्मक विवरण == | ||

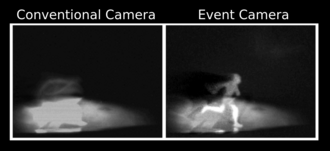

घटना कैमरा | घटना कैमरा चित्रांश स्वतंत्र रूप से चमक में होने वाले परिवर्तनों का प्रतिक्रिया दिखाते हैं।<ref name=":2" />प्रत्येक चित्रांश एक संदर्भ चमक स्तर संग्रहीत करता है, और लगातार इसकी तुलना वर्तमान चमक स्तर से करता है। यदि चमक में अंतर एक सीमा से अधिक है, तो वह चित्रांश अपने संदर्भ स्तर को पुनः स्थापित करता है और एक घटना उत्पन्न करता है: एक असतत पैकेट जिसमें चित्रांश पता और टाइमस्टैम्प होता है। घटनाओं में चमक परिवर्तन की ध्रुवीयता (वृद्धि या कमी), या रोशनी के स्तर का तात्कालिक माप भी हो सकता है।<ref name=":3" /> इस प्रकार, घटना कैमरे दृश्य रोशनी में परिवर्तन से प्रवर्तित होने वाली घटनाओं की एक अतुल्यकालिक वर्ग का उत्पादन करते हैं।[[File:Event camera comparison.jpg|thumb|इवेंट कैमरा और पारंपरिक कैमरा द्वारा तैयार किए गए डेटा की तुलना।]]इवेंट कैमरों में माइक्रोसेकंड समतुल्यकालिक विभेदन ,फ्रेम कैमरों की तुलना में 120 dB गतिक परिसर और कम अतिप्रभावाधीन (फ़ोटोग्राफ़ी) कम/ अतिप्रभावाधीन और [[ धीमी गति |धीमी गति]] होता है<ref name=":2" /><ref>{{Cite web|last=Longinotti|first=Luca|title=उत्पाद की विशेषताएं|url=https://inivation.com/support/product-specifications/|access-date=2019-04-21|website=iniVation}}</ref> । यह उन्हें उद्देश्य और कैमरा गतिविधि([[ ऑप्टिकल प्रवाह |ऑप्टिकल प्रवाह]]) को अधिक सटीक रूप से पथानुसरण करने की अनुमति देता है। वे ग्रे-स्केल जानकारी देते हैं। प्रारंभ में (2014), विभेदन 100 चित्रांश तक सीमित था। बाद की प्रविष्टि 2019 में 640x480 विभेदन तक पहुंच गई। क्योंकि व्यक्तिगत चित्रांश स्वतंत्र रूप से आग लगाते हैं, इवेंट कैमरे अतुल्यकालिक कंप्यूटिंग संरचना जैसे [[न्यूरोमॉर्फिक इंजीनियरिंग|तंत्रिकाप्रभावी इंजीनियरिंग]] के साथ एकीकरण के लिए उपयुक्त दिखाई देते हैं। चित्रांश स्वतंत्रता इन कैमरों को उन दृश्यों के साथ तालमेल बिठाने की अनुमति देती है, जिनमें उज्ज्वल और मंद रोशनी वाले क्षेत्र बिना औसत के होते हैं।<ref name=":7">{{Cite news|date=2022-01-29|title=एक नए प्रकार का कैमरा|newspaper=The Economist|url=https://www.economist.com/science-and-technology/a-new-type-of-camera/21807384|access-date=2022-02-02|issn=0013-0613}}</ref> | ||

{| class="wikitable" | {| class="wikitable" | ||

|+Typical image sensor characteristics | |+Typical image sensor characteristics | ||

| Line 45: | Line 46: | ||

== प्रकार == | == प्रकार == | ||

समतुल्यकालिक विभेदन संवेदक (जैसे डीवीएस<ref name=":2" /> (डायनामिक विजन संवेदक) या एसडीवीएस<ref name=":20" /> (संवेदनशील-डीवीएस)) ऐसी घटनाओं का उत्पादन करते हैं जो ध्रुवीयता (चमक में वृद्धि या कमी) का संकेत देते हैं, जबकि अस्थायी छवि संवेदक <ref name=":3" />प्रत्येक घटना के साथ तात्कालिक [[विकिरण]] का संकेत दें। डेविस<ref name=":0">{{Cite journal|last1=Brandli|first1=C.|last2=Berner|first2=R.|last3=Yang|first3=M.|last4=Liu|first4=S.|last5=Delbruck|first5=T.|date=October 2014|title=A 240 × 180 130 dB 3 µs Latency Global Shutter Spatiotemporal Vision Sensor|journal=IEEE Journal of Solid-State Circuits|volume=49|issue=10|pages=2333–2341|doi=10.1109/JSSC.2014.2342715|issn=0018-9200|bibcode=2014IJSSC..49.2333B|doi-access=free}}</ref> (डायनामिक और एक्टिव-चित्रांश विजन संवेदक ) में डायनेमिक विजन संवेदक (DVS) के अतिरिक्त एक ग्लोबल कैमरा कपाट [[सक्रिय पिक्सेल सेंसर|सक्रिय चित्रांश]] संवेदक (APS) होता है जो समान फोटोसेंसर ऐरे को साझा करता है। इस प्रकार, यह घटनाओं के साथ-साथ छवि फ़्रेम बनाने की क्षमता रखता है। कई इवेंट कैमरों में एक जड़त्वीय माप इकाई (IMU) भी होती है। | |||

{| class="wikitable" | {| class="wikitable" | ||

|+Event cameras | |+Event cameras | ||

| Line 203: | Line 204: | ||

== रेटिनोमॉर्फिक | == रेटिनोमॉर्फिक संवेदक == | ||

{{Main| | {{Main|रेटिनोमॉर्फिक सेंसर}} | ||

[[File:Retinomorphic Sensor.jpg|thumb|Left: फोटोसेंसिटिव कैपेसिटर का योजनाबद्ध क्रॉस-सेक्शनल आरेख। केंद्र: [[रेटिनोमॉर्फिक सेंसर]] का सर्किट आरेख, शीर्ष पर प्रकाशसंवेदी संधारित्र के साथ। दाएं: निरंतर रोशनी के अनुप्रयोग के लिए रेटिनोमॉर्फिक | [[File:Retinomorphic Sensor.jpg|thumb|Left: फोटोसेंसिटिव कैपेसिटर का योजनाबद्ध क्रॉस-सेक्शनल आरेख। केंद्र: [[रेटिनोमॉर्फिक सेंसर|रेटिनोमॉर्फिक]] संवेदक का सर्किट आरेख, शीर्ष पर प्रकाशसंवेदी संधारित्र के साथ। दाएं: निरंतर रोशनी के अनुप्रयोग के लिए रेटिनोमॉर्फिक संवेदक की अपेक्षित क्षणिक प्रतिक्रिया।]]इवेंट संवेदक का एक अन्य वर्ग तथाकथित रेटिनोमॉर्फिक संवेदक है। जबकि रेटिनोमॉर्फिक शब्द का प्रयोग सामान्यतः घटना संवेदकों का वर्णन करने के लिए किया गया है,<ref>{{Cite journal|last=Boahen|first=K.|date=1996|title=रेटिनोमॉर्फिक दृष्टि प्रणाली|url=https://ieeexplore.ieee.org/document/493766|journal=Proceedings of Fifth International Conference on Microelectronics for Neural Networks|pages=2–14|doi=10.1109/MNNFS.1996.493766|isbn=0-8186-7373-7|s2cid=62609792}}</ref><ref>{{Cite journal|last1=Posch|first1=Christoph|last2=Serrano-Gotarredona|first2=Teresa|last3=Linares-Barranco|first3=Bernabe|last4=Delbruck|first4=Tobi|date=2014|title=Retinomorphic Event-Based Vision Sensors: Bioinspired Cameras With Spiking Output|url=https://ieeexplore.ieee.org/document/6887319|journal=Proceedings of the IEEE|volume=102|issue=10|pages=1470–1484|doi=10.1109/JPROC.2014.2346153|hdl=11441/102353|s2cid=11513955|issn=1558-2256}}</ref> 2020 में इसे श्रृंखला में एक प्रतिरोधी और सहज [[संधारित्र]] के आधार पर एक विशिष्ट संवेदक डिज़ाइन के नाम के रूप में अपनाया गया था।<ref>{{Cite journal|last1=Trujillo Herrera|first1=Cinthya|last2=Labram|first2=John G.|date=2020-12-07|title=एक पेरोसाइट रेटिनोमॉर्फिक सेंसर|url=https://aip.scitation.org/doi/abs/10.1063/5.0030097|journal=Applied Physics Letters|volume=117|issue=23|pages=233501|doi=10.1063/5.0030097|bibcode=2020ApPhL.117w3501T|s2cid=230546095|issn=0003-6951}}</ref> ये कैपेसिटर फोटोकैपेसिटर से भिन्न होते हैं, जिनका उपयोग [[सौर ऊर्जा]] को स्टोर करने के लिए किया जाता है,<ref>{{Cite journal|last1=Miyasaka|first1=Tsutomu|last2=Murakami|first2=Takurou N.|date=2004-10-25|title=The photocapacitor: An efficient self-charging capacitor for direct storage of solar energy|url=https://aip.scitation.org/doi/10.1063/1.1810630|journal=Applied Physics Letters|volume=85|issue=17|pages=3932–3934|doi=10.1063/1.1810630|bibcode=2004ApPhL..85.3932M|issn=0003-6951}}</ref> और इसके अतिरिक्त रोशनी के तहत धारिता को बदलने के लिए डिज़ाइन किया गया है। समाई बदलने पर वे थोड़ा चार्ज/डिस्चार्ज होते हैं, लेकिन अन्यथा संतुलन में रहते हैं। जब एक सहज संधारित्र को एक [[अवरोध]]क के साथ श्रृंखला में रखा जाता है, और सर्किट में एक इनपुट वोल्टेज लगाया जाता है, तो परिणाम एक संवेदक होता है जो प्रकाश की तीव्रता में परिवर्तन होने पर वोल्टेज को आउटपुट करता है, लेकिन अन्यथा नहीं। | ||

अन्य इवेंट | अन्य इवेंट संवेदक (सामान्यतः एक फोटोडायोड और कुछ अन्य सर्किट तत्व) के विपरीत, ये संवेदक स्वाभाविक रूप से सिग्नल उत्पन्न करते हैं। इसलिए उन्हें एक एकल उपकरण माना जा सकता है जो अन्य घटना कैमरों में एक छोटे सर्किट के समान परिणाम उत्पन्न करता है। रेटिनोमॉर्फिक संवेदक का आज तक केवल एक शोध वातावरण में अध्ययन किया गया है।<ref>{{Cite web|date=2021-01-18|title=Perovskite सेंसर मानव आँख की तरह अधिक देखता है|url=https://physicsworld.com/perovskite-sensor-sees-more-like-the-human-eye/|access-date=2021-10-28|website=Physics World|language=en-GB}}</ref><ref>{{Cite web|title=साधारण आंखों की तरह सेंसर एआई सिस्टम को और अधिक कुशल बना सकते हैं|url=https://insidescience.org/news/simple-eyelike-sensors-could-make-ai-systems-more-efficient|access-date=2021-10-28|website=Inside Science|language=en}}</ref><ref name=":6">{{Cite web|last=Hambling|first=David|title=एआई विजन को सेंसर से बेहतर बनाया जा सकता है जो मानव आंखों की नकल करता है|url=https://www.newscientist.com/article/2259491-ai-vision-could-be-improved-with-sensors-that-mimic-human-eyes/|access-date=2021-10-28|website=New Scientist|language=en-US}}</ref><ref>{{Cite web|title=An eye for an AI: Optic device mimics human retina|url=https://www.sciencefocus.com/news/an-eye-for-an-ai-optic-device-mimics-human-retina/|access-date=2021-10-28|website=BBC Science Focus Magazine|language=en}}</ref> | ||

| Line 214: | Line 215: | ||

=== छवि पुनर्निर्माण === | === छवि पुनर्निर्माण === | ||

घटनाओं से छवि पुनर्निर्माण में उच्च गतिशील | घटनाओं से छवि पुनर्निर्माण में उच्च गतिशील सीमा , उच्च अस्थायी विभेदन और कम मोशन ब्लर के साथ चित्र और वीडियो बनाने की क्षमता है। समतुल्यकालिक स्मूथिंग का उपयोग करके छवि पुनर्निर्माण प्राप्त किया जा सकता है, उदा। [[ उच्च पास फिल्टर |उच्च पास फिल्टर]] ,हाई-पास या पूरक फिल्टर और ढाल अनुमान<ref>{{Cite journal|last1=Scheerlinck|first1=Cedric|last2=Barnes|first2=Nick|last3=Mahony|first3=Robert|date=April 2019|title=इवेंट कैमरों के लिए अतुल्यकालिक स्थानिक छवि संकल्प|journal=IEEE Robotics and Automation Letters|volume=4|issue=2|pages=816–822|arxiv=1812.00438|doi=10.1109/LRA.2019.2893427|s2cid=59619729|issn=2377-3766}}</ref> इसके बाद [[ग्रेडिएंट-डोमेन इमेज प्रोसेसिंग]]<ref name=":1" />वैकल्पिक तरीकों में [[गणितीय अनुकूलन]] सम्मिलित है<ref>{{Cite book|last1=Pan|first1=Liyuan|last2=Scheerlinck|first2=Cedric|last3=Yu|first3=Xin|last4=Hartley|first4=Richard|last5=Liu|first5=Miaomiao|last6=Dai|first6=Yuchao|title=2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)|date=June 2019|chapter=Bringing a Blurry Frame Alive at High Frame-Rate With an Event Camera|url=https://ieeexplore.ieee.org/document/8953329|location=Long Beach, CA, USA|publisher=IEEE|pages=6813–6822|doi=10.1109/CVPR.2019.00698|isbn=978-1-7281-3293-8|arxiv=1811.10180|s2cid=53749928}}</ref>। | ||

=== स्थानिक दृढ़ संकल्प === | === स्थानिक दृढ़ संकल्प === | ||

स्थानिक घटना-संचालित कनवल्शन की अवधारणा को 1999 में पोस्ट किया गया था<ref name=":21">{{Cite journal|last1=Serrano-Gotarredona|first1=T.|last2=Andreou|first2=A.|last3=Linares-Barranco|first3=B.|date=Sep 1999|title=विजन प्रोसेसिंग सिस्टम के लिए एईआर इमेज फिल्टरिंग आर्किटेक्चर|journal= IEEE Transactions on Circuits and Systems I: Fundamental Theory and Applications|volume=46|issue=9|pages=1064–1071|doi=10.1109/81.788808|hdl=11441/76405|issn=1057-7122|hdl-access=free}}</ref> (डीवीएस से पहले), लेकिन बाद में ईयू प्रोजेक्ट कैवियार के | स्थानिक घटना-संचालित कनवल्शन की अवधारणा को 1999 में पोस्ट किया गया था<ref name=":21">{{Cite journal|last1=Serrano-Gotarredona|first1=T.|last2=Andreou|first2=A.|last3=Linares-Barranco|first3=B.|date=Sep 1999|title=विजन प्रोसेसिंग सिस्टम के लिए एईआर इमेज फिल्टरिंग आर्किटेक्चर|journal= IEEE Transactions on Circuits and Systems I: Fundamental Theory and Applications|volume=46|issue=9|pages=1064–1071|doi=10.1109/81.788808|hdl=11441/76405|issn=1057-7122|hdl-access=free}}</ref> (डीवीएस से पहले), लेकिन बाद में ईयू प्रोजेक्ट कैवियार के समय सामान्यीकृत किया गया<ref name=":22">{{Cite journal|last1=Serrano-Gotarredona|first1=R.|last2=et|first2=al|date=Sep 2009|title=CAVIAR: A 45k-Neuron, 5M-Synapse, 12G-connects/sec AER Hardware Sensory-Processing-Learning-Actuating System for High Speed Visual Object Recognition and Tracking|journal= IEEE Transactions on Neural Networks|volume=20|issue=9|pages=1417–1438|doi=10.1109/TNN.2009.2023653|pmid=19635693|issn=1045-9227|hdl=10261/86527|s2cid=6537174|hdl-access=free}}</ref> (जिसके समय DVS का आविष्कार किया गया था) घटना-दर-घटना को प्रोजेक्ट करके घटना के चारों ओर एक मनमाना [[कनवल्शन]] इंटीग्रेटेड-एंड-फायर पिक्सल की एक सरणी में समन्वयित करता है।<ref name=":23">{{Cite journal|last1=Serrano-Gotarredona|first1=R.|last2=Serrano-Gotarredona|first2=T.|last3=Acosta-Jimenez|first3=A.|last4=Linares-Barranco|first4=B.|date=Dec 2006|title=स्पाइक-आधारित इवेंट प्रोसेसिंग विजन सिस्टम के लिए एक न्यूरोमॉर्फिक कॉर्टिकल-लेयर माइक्रोचिप|journal= IEEE Transactions on Circuits and Systems I: Regular Papers|volume=53|issue=12|pages=2548–2566|doi=10.1109/TCSI.2006.883843|issn=1549-8328|hdl=10261/7823|s2cid=8287877|hdl-access=free}}</ref> मल्टी-कर्नेल इवेंट-संचालित कनवल्शन का विस्तार<ref name=":24">{{Cite journal|last1=Camuñas-Mesa|first1=L.|last2=et|first2=al|date=Feb 2012|title=इवेंट-ड्रिवेन विजन सेंसर के लिए एक इवेंट-ड्रिवेन मल्टी-कर्नेल कनवॉल्यूशन प्रोसेसर मॉड्यूल|journal=IEEE Journal of Solid-State Circuits|volume=47|issue=2|pages=504–517|doi=10.1109/JSSC.2011.2167409|bibcode=2012IJSSC..47..504C|hdl=11441/93004|s2cid=23238741|issn=0018-9200|hdl-access=free}}</ref> घटना-संचालित गहरे [[दृढ़ तंत्रिका नेटवर्क]] के लिए अनुमति देता है।<ref name=":25">{{Cite journal|last1=Pérez-Carrasco|first1=J.A.|last2=Zhao|first2=B.|last3=Serrano|first3=C.|last4=Acha|first4=B.|last5=Serrano-Gotarredona|first5=T.|last6=Chen|first6=S.|last7=Linares-Barranco|first7=B.|date=November 2013|title=लो-रेट रेट-कोडिंग और कॉन्सीडेंस प्रोसेसिंग द्वारा फ्रेम-ड्रिवेन से फ्रेम-फ्री इवेंट-ड्रिवेन विजन सिस्टम में मैपिंग। फीड-फॉरवर्ड कन्वनेट के लिए आवेदन|journal= IEEE Transactions on Pattern Analysis and Machine Intelligence|volume=35|issue=11|pages=2706–2719|doi=10.1109/TPAMI.2013.71|pmid=24051730|hdl=11441/79657|s2cid=170040|issn=0162-8828|url=http://www.imse-cnm.csic.es/~bernabe/tpami2013_AdditionalMaterialVideo.wmv}}</ref> | ||

=== मोशन डिटेक्शन और ट्रैकिंग === | === मोशन डिटेक्शन और ट्रैकिंग === | ||

एक इवेंट कैमरा द्वारा देखी गई [[ छवि विभाजन ]] और [[ चलती वस्तु का पता लगाना ]] एक तुच्छ कार्य लग सकता है, क्योंकि यह | एक इवेंट कैमरा द्वारा देखी गई [[ छवि विभाजन |छवि विभाजन]] और [[ चलती वस्तु का पता लगाना |चलती वस्तु का पता लगाना]] एक तुच्छ कार्य लग सकता है, क्योंकि यह संवेदक ऑन-चिप द्वारा किया जाता है। हालाँकि, ये कार्य कठिन हैं, क्योंकि घटनाओं में बहुत कम जानकारी होती है<ref name=":4">{{Cite journal|last1=Gallego|first1=Guillermo|last2=Delbruck|first2=Tobi|last3=Orchard|first3=Garrick Michael|last4=Bartolozzi|first4=Chiara|last5=Taba|first5=Brian|last6=Censi|first6=Andrea|last7=Leutenegger|first7=Stefan|last8=Davison|first8=Andrew|last9=Conradt|first9=Jorg|last10=Daniilidis|first10=Kostas|last11=Scaramuzza|first11=Davide|date=2020|title=Event-based Vision: A Survey|url=https://ieeexplore.ieee.org/document/9138762|journal=IEEE Transactions on Pattern Analysis and Machine Intelligence|volume=PP|issue=1 |pages=154–180|doi=10.1109/TPAMI.2020.3008413| arxiv=1904.08405 |pmid=32750812|s2cid=234740723|issn=1939-3539}}</ref> और इसमें बनावट और रंग जैसी उपयोगी दृश्य विशेषताएं सम्मिलित नहीं हैं।<ref name=":5">{{Cite journal|last1=Mondal|first1=Anindya|last2=R|first2=Shashant|last3=Giraldo|first3=Jhony H.|last4=Bouwmans|first4=Thierry|last5=Chowdhury|first5=Ananda S.|date=2021|title=ग्राफ़ स्पेक्ट्रल क्लस्टरिंग का उपयोग करके इवेंट-आधारित विज़न के लिए मूविंग ऑब्जेक्ट डिटेक्शन|url=https://openaccess.thecvf.com/content/ICCV2021W/GSP-CV/html/Mondal_Moving_Object_Detection_for_Event-Based_Vision_Using_Graph_Spectral_Clustering_ICCVW_2021_paper.html|journal=International Conference on Computer Vision (ICCV) Workshops|language=en|pages=876–884|doi=10.1109/ICCVW54120.2021.00103|arxiv=2109.14979|isbn=978-1-6654-0191-3|s2cid=238227007|via=IEEE Xplore}}</ref> चलते कैमरे को देखते हुए ये कार्य और चुनौतीपूर्ण हो जाते हैं,<ref name=":4" />क्योंकि घटनाओं को छवि तल पर हर जगह प्रवर्तित किया जाता है, जो चलती वस्तुओं और स्थिर दृश्य (जिसकी स्पष्ट गति कैमरे की अहं-गति से प्रेरित होती है) द्वारा निर्मित होती है। इस समस्या को हल करने के लिए हाल के कुछ दृष्टिकोणों में गति-मुआवजा मॉडल का समावेश सम्मिलित है<ref>{{Cite journal|last1=Mitrokhin|first1=Anton|last2=Fermuller|first2=Cornelia|last3=Parameshwara|first3=Chethan|last4=Aloimonos|first4=Yiannis|date=October 2018|title=इवेंट-आधारित मूविंग ऑब्जेक्ट डिटेक्शन एंड ट्रैकिंग|url=https://ieeexplore.ieee.org/document/8593805|journal=2018 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS)|location=Madrid|publisher=IEEE|pages=1–9|doi=10.1109/IROS.2018.8593805|arxiv=1803.04523|isbn=978-1-5386-8094-0|s2cid=3845250}}</ref><ref>{{Cite book|last1=Stoffregen|first1=Timo|last2=Gallego|first2=Guillermo|last3=Drummond|first3=Tom|last4=Kleeman|first4=Lindsay|last5=Scaramuzza|first5=Davide|date=2019|title=2019 IEEE/CVF International Conference on Computer Vision (ICCV)|chapter=Event-Based Motion Segmentation by Motion Compensation |chapter-url=https://openaccess.thecvf.com/content_ICCV_2019/html/Stoffregen_Event-Based_Motion_Segmentation_by_Motion_Compensation_ICCV_2019_paper.html|pages=7244–7253|doi=10.1109/ICCV.2019.00734 |arxiv=1904.01293|isbn=978-1-7281-4803-8 |s2cid=91183976 }}</ref> और पारंपरिक [[क्लस्टर विश्लेषण]]।<ref>{{Cite journal|last1=Piątkowska|first1=Ewa|last2=Belbachir|first2=Ahmed Nabil|last3=Schraml|first3=Stephan|last4=Gelautz|first4=Margrit|date=June 2012|title=डायनेमिक विजन सेंसर का उपयोग करके स्पोटियोटेम्पोरल मल्टीपल पर्सन ट्रैकिंग|url=https://ieeexplore.ieee.org/document/6238892|journal=2012 IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops|pages=35–40|doi=10.1109/CVPRW.2012.6238892|isbn=978-1-4673-1612-5|s2cid=310741}}</ref><ref>{{Cite journal|last1=Chen|first1=Guang|last2=Cao|first2=Hu|last3=Aafaque|first3=Muhammad|last4=Chen|first4=Jieneng|last5=Ye|first5=Canbo|last6=Röhrbein|first6=Florian|last7=Conradt|first7=Jörg|last8=Chen|first8=Kai|last9=Bing|first9=Zhenshan|last10=Liu|first10=Xingbo|last11=Hinz|first11=Gereon|date=2018-12-02|title=इंटेलिजेंट ट्रांसपोर्टेशन सिस्टम के लिए न्यूरोमॉर्फिक विजन आधारित मल्टीव्हीकल डिटेक्शन एंड ट्रैकिंग|journal=Journal of Advanced Transportation|language=en|volume=2018|pages=e4815383|doi=10.1155/2018/4815383|issn=0197-6729|doi-access=free}}</ref><ref name=":5" /><ref>{{cite book|last1=Mondal|first1=Anindya|last2=Das|first2=Mayukhmali|date=2021-11-08|title=2021 IEEE 8th Uttar Pradesh Section International Conference on Electrical, Electronics and Computer Engineering (UPCON)|chapter=Moving Object Detection for Event-based Vision using k-means Clustering|pages=1–6|doi=10.1109/UPCON52273.2021.9667636|arxiv=2109.01879|isbn=978-1-6654-0962-9|s2cid=237420620}}</ref> | ||

== संभावित अनुप्रयोग == | == संभावित अनुप्रयोग == | ||

संभावित अनुप्रयोगों में वस्तु पहचान, स्वायत्त वाहन और रोबोटिक्स | संभावित अनुप्रयोगों में वस्तु पहचान, स्वायत्त वाहन और रोबोटिक्स सम्मिलित हैं।<ref name=":6" />अमेरिकी सेना इन्फ्रारेड और अन्य इवेंट कैमरों पर विचार कर रही है क्योंकि उनकी कम बिजली की खपत और कम गर्मी उत्पादन होता है।<ref name=":7"/> | ||

== यह भी देखें == | == यह भी देखें == | ||

* | * तंत्रिकाप्रभावी इंजीनियरिंग | ||

* रेटिनोमॉर्फिक | * रेटिनोमॉर्फिक संवेदक | ||

* [[रोलिंग शटर]] | * [[रोलिंग शटर]] | ||

Revision as of 09:29, 22 May 2023

एक इवेंट कैमरा, जिसे तंत्रिकाप्रभावी कैमरा के रूप में भी जाना जाता है,[1] सिलिकॉन रेटिना[2] या गतिशील दृष्टि संवेदक,[3] एक छवि संवेदक है जो चमक में स्थानीय परिवर्तनों पर प्रतिक्रिया करता है। ईवेंट कैमरे कैमरा कपाट (फ़ोटोग्राफ़ी) का उपयोग करके छवियों को अधिकृत नहीं करते हैं जैसा कि पारंपरिक (फ़्रेम) कैमरे करते हैं। इसके अतिरिक्त , एक घटना कैमरे के अंदर प्रत्येक चित्रांश स्वतंत्र रूप से और अतुल्यकालिक रूप से संचालित होता है, चमक में होने वाले परिवर्तनों की प्रतिवेदन करता है, और अन्यथा निष्क्रिय रहता है।

कार्यात्मक विवरण

घटना कैमरा चित्रांश स्वतंत्र रूप से चमक में होने वाले परिवर्तनों का प्रतिक्रिया दिखाते हैं।[4]प्रत्येक चित्रांश एक संदर्भ चमक स्तर संग्रहीत करता है, और लगातार इसकी तुलना वर्तमान चमक स्तर से करता है। यदि चमक में अंतर एक सीमा से अधिक है, तो वह चित्रांश अपने संदर्भ स्तर को पुनः स्थापित करता है और एक घटना उत्पन्न करता है: एक असतत पैकेट जिसमें चित्रांश पता और टाइमस्टैम्प होता है। घटनाओं में चमक परिवर्तन की ध्रुवीयता (वृद्धि या कमी), या रोशनी के स्तर का तात्कालिक माप भी हो सकता है।[5] इस प्रकार, घटना कैमरे दृश्य रोशनी में परिवर्तन से प्रवर्तित होने वाली घटनाओं की एक अतुल्यकालिक वर्ग का उत्पादन करते हैं।

इवेंट कैमरों में माइक्रोसेकंड समतुल्यकालिक विभेदन ,फ्रेम कैमरों की तुलना में 120 dB गतिक परिसर और कम अतिप्रभावाधीन (फ़ोटोग्राफ़ी) कम/ अतिप्रभावाधीन और धीमी गति होता है[4][6] । यह उन्हें उद्देश्य और कैमरा गतिविधि(ऑप्टिकल प्रवाह) को अधिक सटीक रूप से पथानुसरण करने की अनुमति देता है। वे ग्रे-स्केल जानकारी देते हैं। प्रारंभ में (2014), विभेदन 100 चित्रांश तक सीमित था। बाद की प्रविष्टि 2019 में 640x480 विभेदन तक पहुंच गई। क्योंकि व्यक्तिगत चित्रांश स्वतंत्र रूप से आग लगाते हैं, इवेंट कैमरे अतुल्यकालिक कंप्यूटिंग संरचना जैसे तंत्रिकाप्रभावी इंजीनियरिंग के साथ एकीकरण के लिए उपयुक्त दिखाई देते हैं। चित्रांश स्वतंत्रता इन कैमरों को उन दृश्यों के साथ तालमेल बिठाने की अनुमति देती है, जिनमें उज्ज्वल और मंद रोशनी वाले क्षेत्र बिना औसत के होते हैं।[7]

| Sensor | Dynamic

range (dB) |

Equivalent

framerate* (fps) |

Spatial

resolution (MP) |

Power

consumption (mW) |

|---|---|---|---|---|

| Human eye | 30–40 | 200-300 | - | 10[8] |

| High-end DSLR camera (Nikon D850) | 44.6[9] | 120 | 2–8 | - |

| Ultrahigh-speed camera (Phantom v2640)[10] | 64 | 12,500 | 0.3–4 | - |

| Event camera[11] | 120 | 1,000,000 | 0.1–0.2 | 30 |

*अस्थायी समाधान का संकेत देता है क्योंकि मानव आंखें और इवेंट कैमरे फ्रेम को आउटपुट नहीं करते हैं।

प्रकार

समतुल्यकालिक विभेदन संवेदक (जैसे डीवीएस[4] (डायनामिक विजन संवेदक) या एसडीवीएस[12] (संवेदनशील-डीवीएस)) ऐसी घटनाओं का उत्पादन करते हैं जो ध्रुवीयता (चमक में वृद्धि या कमी) का संकेत देते हैं, जबकि अस्थायी छवि संवेदक [5]प्रत्येक घटना के साथ तात्कालिक विकिरण का संकेत दें। डेविस[13] (डायनामिक और एक्टिव-चित्रांश विजन संवेदक ) में डायनेमिक विजन संवेदक (DVS) के अतिरिक्त एक ग्लोबल कैमरा कपाट सक्रिय चित्रांश संवेदक (APS) होता है जो समान फोटोसेंसर ऐरे को साझा करता है। इस प्रकार, यह घटनाओं के साथ-साथ छवि फ़्रेम बनाने की क्षमता रखता है। कई इवेंट कैमरों में एक जड़त्वीय माप इकाई (IMU) भी होती है।

| Name | Event output | Image frames | Color | IMU | Manufacturer | Commercially available | Resolution |

|---|---|---|---|---|---|---|---|

| DVS128[4] | Polarity | No | No | No | Inivation | No | 128x128 |

| sDVS128[12] | Polarity | No | No | No | CSIC | No | 128x128 |

| DAVIS240[13] | Polarity | Yes | No | Yes | Inivation | No | 240x180 |

| DAVIS346[14] | Polarity | Yes | No | Yes | Inivation | Yes | 346 x 260 |

| DVXplorer[15] | Polarity | No | No | Yes | Inivation | Yes | 640 x 480 |

| SEES[16] | Polarity | Yes | No | Yes | Insightness | Yes | |

| Metavision Packaged Generation 3 Sensor[17] | Polarity | No | No | No | Prophesee | Yes | 640x480 |

| SilkyEvCam camera (Prophesee Gen 3)[18] | Polarity | No | No | No | Century Arks / Prophesee | Yes | 640×480 |

| VisionCamEB camera (Prophesee Gen 3) [19] | Polarity | No | No | No | Imago Technologies / Prophesee | Yes | 640×480 |

| Samsung DVS[20] | Polarity | No | No | Yes | Samsung | Yes | 640×480 |

| Onboard[5] | Polarity | No | No | Yes | Prophesee | No | 640×480 |

| Celex[21] | Intensity | Yes | No | Yes | CelePixel | Yes | 64x64 |

| IMX636[22] sensor | Polarity | Yes | No | No | Sony / Prophesee | Yes | 1280x720 |

| EVK3[23] camera (IMX636 ES/ Prophesee Gen 3.1) | Polarity | No | No | No | Prophesee | Yes | 1280x720 / 640×480 |

| EVK4[24] camera (IMX636 ES) | Polarity | No | No | No | Prophesee | Yes | 1280x720 |

| IMX637[25] sensor | Polarity | Yes | No | No | Sony / Prophesee | No | 640x512 |

रेटिनोमॉर्फिक संवेदक

इवेंट संवेदक का एक अन्य वर्ग तथाकथित रेटिनोमॉर्फिक संवेदक है। जबकि रेटिनोमॉर्फिक शब्द का प्रयोग सामान्यतः घटना संवेदकों का वर्णन करने के लिए किया गया है,[26][27] 2020 में इसे श्रृंखला में एक प्रतिरोधी और सहज संधारित्र के आधार पर एक विशिष्ट संवेदक डिज़ाइन के नाम के रूप में अपनाया गया था।[28] ये कैपेसिटर फोटोकैपेसिटर से भिन्न होते हैं, जिनका उपयोग सौर ऊर्जा को स्टोर करने के लिए किया जाता है,[29] और इसके अतिरिक्त रोशनी के तहत धारिता को बदलने के लिए डिज़ाइन किया गया है। समाई बदलने पर वे थोड़ा चार्ज/डिस्चार्ज होते हैं, लेकिन अन्यथा संतुलन में रहते हैं। जब एक सहज संधारित्र को एक अवरोधक के साथ श्रृंखला में रखा जाता है, और सर्किट में एक इनपुट वोल्टेज लगाया जाता है, तो परिणाम एक संवेदक होता है जो प्रकाश की तीव्रता में परिवर्तन होने पर वोल्टेज को आउटपुट करता है, लेकिन अन्यथा नहीं।

अन्य इवेंट संवेदक (सामान्यतः एक फोटोडायोड और कुछ अन्य सर्किट तत्व) के विपरीत, ये संवेदक स्वाभाविक रूप से सिग्नल उत्पन्न करते हैं। इसलिए उन्हें एक एकल उपकरण माना जा सकता है जो अन्य घटना कैमरों में एक छोटे सर्किट के समान परिणाम उत्पन्न करता है। रेटिनोमॉर्फिक संवेदक का आज तक केवल एक शोध वातावरण में अध्ययन किया गया है।[30][31][32][33]

एल्गोरिदम

छवि पुनर्निर्माण

घटनाओं से छवि पुनर्निर्माण में उच्च गतिशील सीमा , उच्च अस्थायी विभेदन और कम मोशन ब्लर के साथ चित्र और वीडियो बनाने की क्षमता है। समतुल्यकालिक स्मूथिंग का उपयोग करके छवि पुनर्निर्माण प्राप्त किया जा सकता है, उदा। उच्च पास फिल्टर ,हाई-पास या पूरक फिल्टर और ढाल अनुमान[35] इसके बाद ग्रेडिएंट-डोमेन इमेज प्रोसेसिंग[34]वैकल्पिक तरीकों में गणितीय अनुकूलन सम्मिलित है[36]।

स्थानिक दृढ़ संकल्प

स्थानिक घटना-संचालित कनवल्शन की अवधारणा को 1999 में पोस्ट किया गया था[37] (डीवीएस से पहले), लेकिन बाद में ईयू प्रोजेक्ट कैवियार के समय सामान्यीकृत किया गया[38] (जिसके समय DVS का आविष्कार किया गया था) घटना-दर-घटना को प्रोजेक्ट करके घटना के चारों ओर एक मनमाना कनवल्शन इंटीग्रेटेड-एंड-फायर पिक्सल की एक सरणी में समन्वयित करता है।[39] मल्टी-कर्नेल इवेंट-संचालित कनवल्शन का विस्तार[40] घटना-संचालित गहरे दृढ़ तंत्रिका नेटवर्क के लिए अनुमति देता है।[41]

मोशन डिटेक्शन और ट्रैकिंग

एक इवेंट कैमरा द्वारा देखी गई छवि विभाजन और चलती वस्तु का पता लगाना एक तुच्छ कार्य लग सकता है, क्योंकि यह संवेदक ऑन-चिप द्वारा किया जाता है। हालाँकि, ये कार्य कठिन हैं, क्योंकि घटनाओं में बहुत कम जानकारी होती है[42] और इसमें बनावट और रंग जैसी उपयोगी दृश्य विशेषताएं सम्मिलित नहीं हैं।[43] चलते कैमरे को देखते हुए ये कार्य और चुनौतीपूर्ण हो जाते हैं,[42]क्योंकि घटनाओं को छवि तल पर हर जगह प्रवर्तित किया जाता है, जो चलती वस्तुओं और स्थिर दृश्य (जिसकी स्पष्ट गति कैमरे की अहं-गति से प्रेरित होती है) द्वारा निर्मित होती है। इस समस्या को हल करने के लिए हाल के कुछ दृष्टिकोणों में गति-मुआवजा मॉडल का समावेश सम्मिलित है[44][45] और पारंपरिक क्लस्टर विश्लेषण।[46][47][43][48]

संभावित अनुप्रयोग

संभावित अनुप्रयोगों में वस्तु पहचान, स्वायत्त वाहन और रोबोटिक्स सम्मिलित हैं।[32]अमेरिकी सेना इन्फ्रारेड और अन्य इवेंट कैमरों पर विचार कर रही है क्योंकि उनकी कम बिजली की खपत और कम गर्मी उत्पादन होता है।[7]

यह भी देखें

- तंत्रिकाप्रभावी इंजीनियरिंग

- रेटिनोमॉर्फिक संवेदक

- रोलिंग शटर

संदर्भ

- ↑ Li, Hongmin; Liu, Hanchao; Ji, Xiangyang; Li, Guoqi; Shi, Luping (2017). "CIFAR10-DVS: An Event-Stream Dataset for Object Classification". Frontiers in Neuroscience (in English). 11: 309. doi:10.3389/fnins.2017.00309. ISSN 1662-453X. PMC 5447775. PMID 28611582.

- ↑ Sarmadi, Hamid; Muñoz-Salinas, Rafael; Olivares-Mendez, Miguel A.; Medina-Carnicer, Rafael (2021). "एक इवेंट कैमरा का उपयोग करके बाइनरी स्क्वायर फिडुशियल मार्कर का पता लगाना". IEEE Access. 9: 27813–27826. arXiv:2012.06516. doi:10.1109/ACCESS.2021.3058423. ISSN 2169-3536. S2CID 228375825.

- ↑ Liu, Min; Delbruck, Tobi (May 2017). "Block-matching optical flow for dynamic vision sensors: Algorithm and FPGA implementation". 2017 IEEE International Symposium on Circuits and Systems (ISCAS). pp. 1–4. arXiv:1706.05415. doi:10.1109/ISCAS.2017.8050295. ISBN 978-1-4673-6853-7. S2CID 2283149. Retrieved 27 June 2021.

- ↑ 4.0 4.1 4.2 4.3 Lichtsteiner, P.; Posch, C.; Delbruck, T. (February 2008). "A 128×128 120 dB 15μs Latency Asynchronous Temporal Contrast Vision Sensor" (PDF). IEEE Journal of Solid-State Circuits. 43 (2): 566–576. Bibcode:2008IJSSC..43..566L. doi:10.1109/JSSC.2007.914337. ISSN 0018-9200. S2CID 6119048.

- ↑ 5.0 5.1 5.2 Posch, C.; Matolin, D.; Wohlgenannt, R. (January 2011). "A QVGA 143 dB Dynamic Range Frame-Free PWM Image Sensor With Lossless Pixel-Level Video Compression and Time-Domain CDS". IEEE Journal of Solid-State Circuits. 46 (1): 259–275. Bibcode:2011IJSSC..46..259P. doi:10.1109/JSSC.2010.2085952. ISSN 0018-9200. S2CID 21317717.

- ↑ Longinotti, Luca. "उत्पाद की विशेषताएं". iniVation. Retrieved 2019-04-21.

- ↑ 7.0 7.1 "एक नए प्रकार का कैमरा". The Economist. 2022-01-29. ISSN 0013-0613. Retrieved 2022-02-02.

- ↑ Skorka, Orit (2011-07-01). "Toward a digital camera to rival the human eye". Journal of Electronic Imaging. 20 (3): 033009–033009–18. Bibcode:2011JEI....20c3009S. doi:10.1117/1.3611015. ISSN 1017-9909.

- ↑ DxO. "Nikon D850 : Tests and Reviews | DxOMark". www.dxomark.com. Retrieved 2019-04-22.

- ↑ "Phantom v2640". www.phantomhighspeed.com. Retrieved 2019-04-22.

- ↑ Longinotti, Luca. "Product Specifications". iniVation. Retrieved 2019-04-22.

- ↑ 12.0 12.1 Serrano-Gotarredona, T.; Linares-Barranco, B. (March 2013). "A 128x128 1.5% Contrast Sensitivity 0.9% FPN 3μs Latency 4mW Asynchronous Frame-Free Dynamic Vision Sensor Using Transimpedance Amplifiers" (PDF). IEEE Journal of Solid-State Circuits. 48 (3): 827–838. Bibcode:2013IJSSC..48..827S. doi:10.1109/JSSC.2012.2230553. ISSN 0018-9200. S2CID 6686013.

- ↑ 13.0 13.1 Brandli, C.; Berner, R.; Yang, M.; Liu, S.; Delbruck, T. (October 2014). "A 240 × 180 130 dB 3 µs Latency Global Shutter Spatiotemporal Vision Sensor". IEEE Journal of Solid-State Circuits. 49 (10): 2333–2341. Bibcode:2014IJSSC..49.2333B. doi:10.1109/JSSC.2014.2342715. ISSN 0018-9200.

- ↑ Taverni, Gemma; Paul Moeys, Diederik; Li, Chenghan; Cavaco, Celso; Motsnyi, Vasyl; San Segundo Bello, David; Delbruck, Tobi (May 2018). "Front and Back Illuminated Dynamic and Active Pixel Vision Sensors Comparison" (PDF). IEEE Transactions on Circuits and Systems II: Express Briefs. 65 (5): 677–681. doi:10.1109/TCSII.2018.2824899. ISSN 1549-7747. S2CID 19091270.

- ↑ "Inivation Specifications - Current models" (PDF).

- ↑ "Insightness – Sight for your device". Retrieved 2019-04-22.

- ↑ "Metavision® Packaged Sensor". PROPHESEE (in English). Retrieved 2022-04-14.

- ↑ "Event Based Vision Camera - Century Arks". Retrieved 2021-08-30.

- ↑ "IMAGO I PROPHESEE first industrial grade event-based vision system". PROPHESEE (in English). 2019-02-14. Retrieved 2022-04-14.

- ↑ Son, Bongki; Suh, Yunjae; Kim, Sungho; Jung, Heejae; Kim, Jun-Seok; Shin, Changwoo; Park, Keunju; Lee, Kyoobin; Park, Jinman (February 2017). "4.1 A 640×480 dynamic vision sensor with a 9µm pixel and 300Meps address-event representation". 2017 IEEE International Solid-State Circuits Conference (ISSCC). San Francisco, CA, USA: IEEE. pp. 66–67. doi:10.1109/ISSCC.2017.7870263. ISBN 9781509037582. S2CID 19371922.

- ↑ Chen, Shoushun; Tang, Wei; Zhang, Xiangyu; Culurciello, Eugenio (December 2012). "A 64 $\times$ 64 Pixels UWB Wireless Temporal-Difference Digital Image Sensor". IEEE Transactions on Very Large Scale Integration (VLSI) Systems. 20 (12): 2232–2240. doi:10.1109/TVLSI.2011.2172470. ISSN 1063-8210. S2CID 5909607.

- ↑ "Sony to Release Two Types of Stacked Event-Based Vision Sensors with the Industry's Smallest 4.86μm Pixel Size for Detecting Subject Changes Only Delivering High-Speed, High-Precision Data Acquisition to Improve Industrial Equipment Productivity|News Releases|Sony Semiconductor Solutions Group". Sony Semiconductor Solutions Group (in 日本語). Retrieved 2021-10-28.

- ↑ "Event-Based Evaluation Kit 3 - VGA / HD". PROPHESEE (in English). Retrieved 2022-04-14.

- ↑ Staff, Embedded (2022-04-13). "Eval kit for Sony sensor featuring Prophesee event-based vision tech". Embedded.com (in English). Retrieved 2022-04-14.

- ↑ "Sony® Launches the new IMX636 and IMX637 Event-Based Vision Sensors". FRAMOS (in English). Retrieved 2022-05-17.

- ↑ Boahen, K. (1996). "रेटिनोमॉर्फिक दृष्टि प्रणाली". Proceedings of Fifth International Conference on Microelectronics for Neural Networks: 2–14. doi:10.1109/MNNFS.1996.493766. ISBN 0-8186-7373-7. S2CID 62609792.

- ↑ Posch, Christoph; Serrano-Gotarredona, Teresa; Linares-Barranco, Bernabe; Delbruck, Tobi (2014). "Retinomorphic Event-Based Vision Sensors: Bioinspired Cameras With Spiking Output". Proceedings of the IEEE. 102 (10): 1470–1484. doi:10.1109/JPROC.2014.2346153. hdl:11441/102353. ISSN 1558-2256. S2CID 11513955.

- ↑ Trujillo Herrera, Cinthya; Labram, John G. (2020-12-07). "एक पेरोसाइट रेटिनोमॉर्फिक सेंसर". Applied Physics Letters. 117 (23): 233501. Bibcode:2020ApPhL.117w3501T. doi:10.1063/5.0030097. ISSN 0003-6951. S2CID 230546095.

- ↑ Miyasaka, Tsutomu; Murakami, Takurou N. (2004-10-25). "The photocapacitor: An efficient self-charging capacitor for direct storage of solar energy". Applied Physics Letters. 85 (17): 3932–3934. Bibcode:2004ApPhL..85.3932M. doi:10.1063/1.1810630. ISSN 0003-6951.

- ↑ "Perovskite सेंसर मानव आँख की तरह अधिक देखता है". Physics World (in British English). 2021-01-18. Retrieved 2021-10-28.

- ↑ "साधारण आंखों की तरह सेंसर एआई सिस्टम को और अधिक कुशल बना सकते हैं". Inside Science (in English). Retrieved 2021-10-28.

- ↑ 32.0 32.1 Hambling, David. "एआई विजन को सेंसर से बेहतर बनाया जा सकता है जो मानव आंखों की नकल करता है". New Scientist (in English). Retrieved 2021-10-28.

- ↑ "An eye for an AI: Optic device mimics human retina". BBC Science Focus Magazine (in English). Retrieved 2021-10-28.

- ↑ 34.0 34.1 Scheerlinck, Cedric; Barnes, Nick; Mahony, Robert (2019). "इवेंट कैमरों का उपयोग करके निरंतर-समय की तीव्रता का अनुमान". Computer Vision – ACCV 2018. Lecture Notes in Computer Science (in English). Springer International Publishing. 11365: 308–324. arXiv:1811.00386. doi:10.1007/978-3-030-20873-8_20. ISBN 9783030208738. S2CID 53182986.

- ↑ Scheerlinck, Cedric; Barnes, Nick; Mahony, Robert (April 2019). "इवेंट कैमरों के लिए अतुल्यकालिक स्थानिक छवि संकल्प". IEEE Robotics and Automation Letters. 4 (2): 816–822. arXiv:1812.00438. doi:10.1109/LRA.2019.2893427. ISSN 2377-3766. S2CID 59619729.

- ↑ Pan, Liyuan; Scheerlinck, Cedric; Yu, Xin; Hartley, Richard; Liu, Miaomiao; Dai, Yuchao (June 2019). "Bringing a Blurry Frame Alive at High Frame-Rate With an Event Camera". 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). Long Beach, CA, USA: IEEE. pp. 6813–6822. arXiv:1811.10180. doi:10.1109/CVPR.2019.00698. ISBN 978-1-7281-3293-8. S2CID 53749928.

- ↑ Serrano-Gotarredona, T.; Andreou, A.; Linares-Barranco, B. (Sep 1999). "विजन प्रोसेसिंग सिस्टम के लिए एईआर इमेज फिल्टरिंग आर्किटेक्चर". IEEE Transactions on Circuits and Systems I: Fundamental Theory and Applications. 46 (9): 1064–1071. doi:10.1109/81.788808. hdl:11441/76405. ISSN 1057-7122.

- ↑ Serrano-Gotarredona, R.; et, al (Sep 2009). "CAVIAR: A 45k-Neuron, 5M-Synapse, 12G-connects/sec AER Hardware Sensory-Processing-Learning-Actuating System for High Speed Visual Object Recognition and Tracking". IEEE Transactions on Neural Networks. 20 (9): 1417–1438. doi:10.1109/TNN.2009.2023653. hdl:10261/86527. ISSN 1045-9227. PMID 19635693. S2CID 6537174.

- ↑ Serrano-Gotarredona, R.; Serrano-Gotarredona, T.; Acosta-Jimenez, A.; Linares-Barranco, B. (Dec 2006). "स्पाइक-आधारित इवेंट प्रोसेसिंग विजन सिस्टम के लिए एक न्यूरोमॉर्फिक कॉर्टिकल-लेयर माइक्रोचिप". IEEE Transactions on Circuits and Systems I: Regular Papers. 53 (12): 2548–2566. doi:10.1109/TCSI.2006.883843. hdl:10261/7823. ISSN 1549-8328. S2CID 8287877.

- ↑ Camuñas-Mesa, L.; et, al (Feb 2012). "इवेंट-ड्रिवेन विजन सेंसर के लिए एक इवेंट-ड्रिवेन मल्टी-कर्नेल कनवॉल्यूशन प्रोसेसर मॉड्यूल". IEEE Journal of Solid-State Circuits. 47 (2): 504–517. Bibcode:2012IJSSC..47..504C. doi:10.1109/JSSC.2011.2167409. hdl:11441/93004. ISSN 0018-9200. S2CID 23238741.

- ↑ Pérez-Carrasco, J.A.; Zhao, B.; Serrano, C.; Acha, B.; Serrano-Gotarredona, T.; Chen, S.; Linares-Barranco, B. (November 2013). "लो-रेट रेट-कोडिंग और कॉन्सीडेंस प्रोसेसिंग द्वारा फ्रेम-ड्रिवेन से फ्रेम-फ्री इवेंट-ड्रिवेन विजन सिस्टम में मैपिंग। फीड-फॉरवर्ड कन्वनेट के लिए आवेदन". IEEE Transactions on Pattern Analysis and Machine Intelligence. 35 (11): 2706–2719. doi:10.1109/TPAMI.2013.71. hdl:11441/79657. ISSN 0162-8828. PMID 24051730. S2CID 170040.

- ↑ 42.0 42.1 Gallego, Guillermo; Delbruck, Tobi; Orchard, Garrick Michael; Bartolozzi, Chiara; Taba, Brian; Censi, Andrea; Leutenegger, Stefan; Davison, Andrew; Conradt, Jorg; Daniilidis, Kostas; Scaramuzza, Davide (2020). "Event-based Vision: A Survey". IEEE Transactions on Pattern Analysis and Machine Intelligence. PP (1): 154–180. arXiv:1904.08405. doi:10.1109/TPAMI.2020.3008413. ISSN 1939-3539. PMID 32750812. S2CID 234740723.

- ↑ 43.0 43.1 Mondal, Anindya; R, Shashant; Giraldo, Jhony H.; Bouwmans, Thierry; Chowdhury, Ananda S. (2021). "ग्राफ़ स्पेक्ट्रल क्लस्टरिंग का उपयोग करके इवेंट-आधारित विज़न के लिए मूविंग ऑब्जेक्ट डिटेक्शन". International Conference on Computer Vision (ICCV) Workshops (in English): 876–884. arXiv:2109.14979. doi:10.1109/ICCVW54120.2021.00103. ISBN 978-1-6654-0191-3. S2CID 238227007 – via IEEE Xplore.

- ↑ Mitrokhin, Anton; Fermuller, Cornelia; Parameshwara, Chethan; Aloimonos, Yiannis (October 2018). "इवेंट-आधारित मूविंग ऑब्जेक्ट डिटेक्शन एंड ट्रैकिंग". 2018 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS). Madrid: IEEE: 1–9. arXiv:1803.04523. doi:10.1109/IROS.2018.8593805. ISBN 978-1-5386-8094-0. S2CID 3845250.

- ↑ Stoffregen, Timo; Gallego, Guillermo; Drummond, Tom; Kleeman, Lindsay; Scaramuzza, Davide (2019). "Event-Based Motion Segmentation by Motion Compensation". 2019 IEEE/CVF International Conference on Computer Vision (ICCV). pp. 7244–7253. arXiv:1904.01293. doi:10.1109/ICCV.2019.00734. ISBN 978-1-7281-4803-8. S2CID 91183976.

- ↑ Piątkowska, Ewa; Belbachir, Ahmed Nabil; Schraml, Stephan; Gelautz, Margrit (June 2012). "डायनेमिक विजन सेंसर का उपयोग करके स्पोटियोटेम्पोरल मल्टीपल पर्सन ट्रैकिंग". 2012 IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops: 35–40. doi:10.1109/CVPRW.2012.6238892. ISBN 978-1-4673-1612-5. S2CID 310741.

- ↑ Chen, Guang; Cao, Hu; Aafaque, Muhammad; Chen, Jieneng; Ye, Canbo; Röhrbein, Florian; Conradt, Jörg; Chen, Kai; Bing, Zhenshan; Liu, Xingbo; Hinz, Gereon (2018-12-02). "इंटेलिजेंट ट्रांसपोर्टेशन सिस्टम के लिए न्यूरोमॉर्फिक विजन आधारित मल्टीव्हीकल डिटेक्शन एंड ट्रैकिंग". Journal of Advanced Transportation (in English). 2018: e4815383. doi:10.1155/2018/4815383. ISSN 0197-6729.

- ↑ Mondal, Anindya; Das, Mayukhmali (2021-11-08). "Moving Object Detection for Event-based Vision using k-means Clustering". 2021 IEEE 8th Uttar Pradesh Section International Conference on Electrical, Electronics and Computer Engineering (UPCON). pp. 1–6. arXiv:2109.01879. doi:10.1109/UPCON52273.2021.9667636. ISBN 978-1-6654-0962-9. S2CID 237420620.