बहुभिन्नरूपी अनुकूली प्रतिगमन तख़्ता: Difference between revisions

(Created page with "{{Short description|Non-parametric regression technique}} आंकड़ों में, बहुभिन्नरूपी अनुकूली प्रतिगमन...") |

No edit summary |

||

| Line 1: | Line 1: | ||

{{Short description|Non-parametric regression technique}} | {{Short description|Non-parametric regression technique}} | ||

आंकड़ों में, बहुभिन्नरूपी अनुकूली प्रतिगमन स्प्लिन (MARS) 1991 में जेरोम एच. फ्रीडमैन द्वारा शुरू किए गए [[प्रतिगमन विश्लेषण]] का | आंकड़ों में, बहुभिन्नरूपी अनुकूली प्रतिगमन स्प्लिन (MARS) 1991 में जेरोम एच. फ्रीडमैन द्वारा शुरू किए गए [[प्रतिगमन विश्लेषण]] का रूप है।<ref>{{Cite journal | last1 = Friedman | first1 = J. H. | doi = 10.1214/aos/1176347963 | title = बहुभिन्नरूपी अनुकूली प्रतिगमन स्प्लिंस| journal = The Annals of Statistics | volume = 19 | issue = 1 | pages = 1–67 | year = 1991 |mr=1091842 | zbl = 0765.62064 | jstor = 2241837| citeseerx = 10.1.1.382.970 }}</ref> यह [[गैर-पैरामीट्रिक प्रतिगमन]] तकनीक है और इसे [[रैखिक मॉडल]] के विस्तार के रूप में देखा जा सकता है जो स्वचालित रूप से चर के बीच गैर-रैखिकता और इंटरैक्शन को मॉडल करता है। | ||

MARS शब्द को सैलफोर्ड सिस्टम्स द्वारा ट्रेडमार्क और लाइसेंस प्राप्त है। ट्रेडमार्क उल्लंघनों से बचने के लिए, MARS के कई ओपन-सोर्स कार्यान्वयनों को Earth कहा जाता है।<ref>[https://cran.r-project.org/web/packages/earth/index.html CRAN Package earth]</ref><ref>[http://orange.biolab.si/blog/2011/12/20/earth-multivariate-adaptive-regression-splines/ Earth – Multivariate adaptive regression splines in Orange (Python machine learning library)]</ref> | MARS शब्द को सैलफोर्ड सिस्टम्स द्वारा ट्रेडमार्क और लाइसेंस प्राप्त है। ट्रेडमार्क उल्लंघनों से बचने के लिए, MARS के कई ओपन-सोर्स कार्यान्वयनों को Earth कहा जाता है।<ref>[https://cran.r-project.org/web/packages/earth/index.html CRAN Package earth]</ref><ref>[http://orange.biolab.si/blog/2011/12/20/earth-multivariate-adaptive-regression-splines/ Earth – Multivariate adaptive regression splines in Orange (Python machine learning library)]</ref> | ||

== मूल बातें == | == मूल बातें == | ||

यह खंड कुछ उदाहरणों का उपयोग करके मंगल ग्रह का परिचय देता है। हम डेटा के सेट से शुरू करते हैं: इनपुट चर x का मैट्रिक्स, और देखी गई प्रतिक्रियाओं y का वेक्टर, x में प्रत्येक पंक्ति के लिए प्रतिक्रिया के साथ। उदाहरण के लिए, डेटा हो सकता है: | |||

यह खंड कुछ उदाहरणों का उपयोग करके मंगल ग्रह का परिचय देता है। हम डेटा के | |||

{| | {| | ||

| Line 22: | Line 20: | ||

| 20.6 || 77.0 | | 20.6 || 77.0 | ||

|} | |} | ||

यहां केवल | यहां केवल [[आश्रित और स्वतंत्र चर]] है, इसलिए x मैट्रिक्स केवल कॉलम है। इन मापों को देखते हुए, हम मॉडल बनाना चाहेंगे जो किसी दिए गए x के लिए अपेक्षित y की भविष्यवाणी करता है। | ||

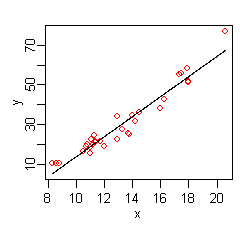

[[File:Friedmans mars linear model.png|frame|right| | [[File:Friedmans mars linear model.png|frame|right|रेखीय मॉडल]]उपरोक्त डेटा के लिए रैखिक मॉडल है | ||

: <math> | : <math> | ||

\widehat{y} = -37 + 5.1 x | \widehat{y} = -37 + 5.1 x | ||

</math> | </math> | ||

पर टोपी <math>\widehat{y}</math> दर्शाता है कि <math>\widehat{y}</math> डेटा से अनुमान लगाया गया है. दाईं ओर का चित्र इस फ़ंक्शन का | पर टोपी <math>\widehat{y}</math> दर्शाता है कि <math>\widehat{y}</math> डेटा से अनुमान लगाया गया है. दाईं ओर का चित्र इस फ़ंक्शन का प्लॉट दिखाता है: | ||

भविष्यवाणी बताने वाली | भविष्यवाणी बताने वाली पंक्ति <math>\widehat{y}</math> बनाम x, y के मूल मान को लाल बिंदुओं के रूप में दिखाया गया है। | ||

x के चरम पर डेटा इंगित करता है कि y और x के बीच संबंध गैर-रैखिक हो सकता है (x के निम्न और उच्च मूल्यों पर प्रतिगमन रेखा के सापेक्ष लाल बिंदुओं को देखें)। इस प्रकार हम गैर-रैखिकताओं को ध्यान में रखते हुए स्वचालित रूप से | x के चरम पर डेटा इंगित करता है कि y और x के बीच संबंध गैर-रैखिक हो सकता है (x के निम्न और उच्च मूल्यों पर प्रतिगमन रेखा के सापेक्ष लाल बिंदुओं को देखें)। इस प्रकार हम गैर-रैखिकताओं को ध्यान में रखते हुए स्वचालित रूप से मॉडल बनाने के लिए MARS की ओर रुख करते हैं। MARS सॉफ़्टवेयर दिए गए x और y से निम्नानुसार मॉडल बनाता है | ||

: <math> | : <math> | ||

| Line 42: | Line 40: | ||

</math> | </math> | ||

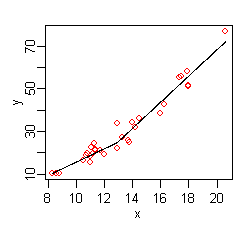

[[File:Friedmans mars simple model.png|frame|right|समान डेटा का | [[File:Friedmans mars simple model.png|frame|right|समान डेटा का सरल MARS मॉडल]]दाईं ओर का चित्र इस फ़ंक्शन का प्लॉट दिखाता है: पूर्वानुमानित <math>\widehat{y}</math> बनाम x, y के मूल मानों को बार फिर लाल बिंदुओं के रूप में दिखाया गया है। पूर्वानुमानित प्रतिक्रिया अब मूल y मानों के लिए बेहतर अनुकूल है। | ||

गैर-रैखिकता को ध्यान में रखने के लिए MARS ने स्वचालित रूप से अनुमानित y में | गैर-रैखिकता को ध्यान में रखने के लिए MARS ने स्वचालित रूप से अनुमानित y में मोड़ उत्पन्न किया है। किंक का निर्माण हिंज कार्यों द्वारा होता है। हिंज फ़ंक्शंस से शुरू होने वाले भाव हैं <math>\max</math> (कहाँ <math>\max(a,b)</math> है <math>a</math> अगर <math>a > b</math>, अन्य <math>b</math>). हिंज फ़ंक्शंस का नीचे अधिक विस्तार से वर्णन किया गया है। | ||

इस सरल उदाहरण में, हम प्लॉट से आसानी से देख सकते हैं कि y का x के साथ | इस सरल उदाहरण में, हम प्लॉट से आसानी से देख सकते हैं कि y का x के साथ गैर-रैखिक संबंध है (और शायद अनुमान लगा सकते हैं कि y, x के वर्ग के साथ बदलता रहता है)। हालाँकि, सामान्य तौर पर कई आश्रित और स्वतंत्र चर होंगे, और y और इन चर के बीच संबंध अस्पष्ट होगा और प्लॉटिंग द्वारा आसानी से दिखाई नहीं देगा। हम उस गैर-रैखिक संबंध की खोज के लिए MARS का उपयोग कर सकते हैं। | ||

अनेक चरों के साथ MARS अभिव्यक्ति का | अनेक चरों के साथ MARS अभिव्यक्ति का उदाहरण है | ||

: <math> | : <math> | ||

| Line 70: | Line 68: | ||

: <math>\widehat{f}(x) = \sum_{i=1}^k c_i B_i(x). </math> | : <math>\widehat{f}(x) = \sum_{i=1}^k c_i B_i(x). </math> | ||

मॉडल आधार कार्यों का | मॉडल आधार कार्यों का भारित योग है | ||

<math>B_i(x)</math>. | <math>B_i(x)</math>. | ||

प्रत्येक <math>c_i</math> | प्रत्येक <math>c_i</math> स्थिर गुणांक है. | ||

उदाहरण के लिए, उपरोक्त ओजोन के सूत्र में प्रत्येक पंक्ति | उदाहरण के लिए, उपरोक्त ओजोन के सूत्र में प्रत्येक पंक्ति [[आधार कार्य]] है | ||

इसके गुणांक से गुणा किया गया। | इसके गुणांक से गुणा किया गया। | ||

प्रत्येक आधार कार्य <math>B_i(x)</math> निम्नलिखित तीन रूपों में से | प्रत्येक आधार कार्य <math>B_i(x)</math> निम्नलिखित तीन रूपों में से लेता है: | ||

1) | 1) अचर 1. ऐसा केवल ही पद है, अंतःखंड। | ||

उपरोक्त ओजोन सूत्र में, अवरोधन पद 5.2 है। | उपरोक्त ओजोन सूत्र में, अवरोधन पद 5.2 है। | ||

2) | 2) काज समारोह. काज फ़ंक्शन का रूप होता है <math> \max(0, x - \text{constant}) </math> या <math> \max(0, \text{constant} - x) </math>. MARS हिंज फ़ंक्शंस की गांठों के लिए स्वचालित रूप से उन चरों के चर और मानों का चयन करता है। ऐसे आधार कार्यों के उदाहरण ओजोन सूत्र की मध्य तीन पंक्तियों में देखे जा सकते हैं। | ||

3) दो या दो से अधिक काज कार्यों का उत्पाद। | 3) दो या दो से अधिक काज कार्यों का उत्पाद। | ||

ये आधार कार्य दो या दो से अधिक चरों के बीच अंतःक्रिया को मॉडल कर सकते हैं। | ये आधार कार्य दो या दो से अधिक चरों के बीच अंतःक्रिया को मॉडल कर सकते हैं। | ||

उदाहरण ओजोन सूत्र की अंतिम पंक्ति है। | |||

== काज कार्य == | == काज कार्य == | ||

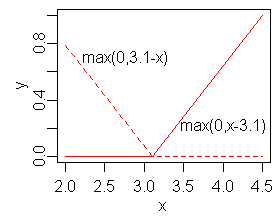

[[File:Friedmans mars hinge functions.png|frame|right|काज की | [[File:Friedmans mars hinge functions.png|frame|right|काज की प्रतिबिंबित जोड़ी x=3.1 पर गाँठ के साथ कार्य करती है]] | ||

{{further|Hinge function}} | {{further|Hinge function}} | ||

MARS मॉडल का | MARS मॉडल का प्रमुख हिस्सा रूप धारण करने वाले हिंज फ़ंक्शन हैं | ||

: <math>\max(0,x-c)</math> | : <math>\max(0,x-c)</math> | ||

या | या | ||

: <math>\max(0,c-x)</math> | : <math>\max(0,c-x)</math> | ||

कहाँ <math>c</math> | कहाँ <math>c</math> स्थिरांक है, जिसे गाँठ कहा जाता है। | ||

दाईं ओर का चित्र 3.1 पर | दाईं ओर का चित्र 3.1 पर गाँठ के साथ काज कार्यों की प्रतिबिंबित जोड़ी को दर्शाता है। | ||

हिंज फ़ंक्शन इसकी सीमा के हिस्से के लिए शून्य है, इसलिए इसका उपयोग डेटा को असंयुक्त क्षेत्रों में विभाजित करने के लिए किया जा सकता है, जिनमें से प्रत्येक को स्वतंत्र रूप से व्यवहार किया जा सकता है। इस प्रकार, उदाहरण के लिए अभिव्यक्ति में काज की प्रतिबिंबित जोड़ी कार्य करती है | |||

: <math> | : <math> | ||

6.1 \max(0, x - 13) | 6.1 \max(0, x - 13) | ||

| Line 105: | Line 103: | ||

पिछले अनुभाग में सरल MARS मॉडल के लिए दिखाया गया टुकड़ावार रैखिक ग्राफ़ बनाता है। | पिछले अनुभाग में सरल MARS मॉडल के लिए दिखाया गया टुकड़ावार रैखिक ग्राफ़ बनाता है। | ||

कोई यह मान सकता है कि हिंज फ़ंक्शंस से केवल टुकड़े-टुकड़े रैखिक फ़ंक्शंस बनाए जा सकते हैं, लेकिन नॉन-लीनियर फ़ंक्शंस बनाने के लिए हिंज फ़ंक्शंस को | कोई यह मान सकता है कि हिंज फ़ंक्शंस से केवल टुकड़े-टुकड़े रैखिक फ़ंक्शंस बनाए जा सकते हैं, लेकिन नॉन-लीनियर फ़ंक्शंस बनाने के लिए हिंज फ़ंक्शंस को साथ गुणा किया जा सकता है। | ||

हिंज फ़ंक्शंस को [[रैंप समारोह]], [[आइस हॉकी स्टिक]], या रेक्टिफायर (तंत्रिका नेटवर्क) फ़ंक्शंस भी कहा जाता है। बदले में <math>\max</math> इस आलेख में उपयोग किए गए नोटेशन में, हिंज फ़ंक्शंस को अक्सर दर्शाया जाता है <math>[\pm(x_i - c)]_+</math> कहाँ <math>[\cdot]_+</math> मतलब सकारात्मक हिस्सा लें. | हिंज फ़ंक्शंस को [[रैंप समारोह]], [[आइस हॉकी स्टिक]], या रेक्टिफायर (तंत्रिका नेटवर्क) फ़ंक्शंस भी कहा जाता है। बदले में <math>\max</math> इस आलेख में उपयोग किए गए नोटेशन में, हिंज फ़ंक्शंस को अक्सर दर्शाया जाता है <math>[\pm(x_i - c)]_+</math> कहाँ <math>[\cdot]_+</math> मतलब सकारात्मक हिस्सा लें. | ||

| Line 112: | Line 110: | ||

{{see also|Stepwise regression}} | {{see also|Stepwise regression}} | ||

MARS दो चरणों में | MARS दो चरणों में मॉडल बनाता है: | ||

आगे और पीछे का मार्ग। | आगे और पीछे का मार्ग। | ||

यह दो-चरणीय दृष्टिकोण वैसा ही है जैसा कि द्वारा उपयोग किया जाता है | यह दो-चरणीय दृष्टिकोण वैसा ही है जैसा कि द्वारा उपयोग किया जाता है | ||

| Line 119: | Line 117: | ||

=== फॉरवर्ड पास === | === फॉरवर्ड पास === | ||

MARS | MARS मॉडल से शुरू होता है जिसमें केवल इंटरसेप्ट टर्म होता है | ||

(जो प्रतिक्रिया मूल्यों का माध्य है)। | (जो प्रतिक्रिया मूल्यों का माध्य है)। | ||

MARS फिर मॉडल में जोड़े में आधार फ़ंक्शन को बार-बार जोड़ता है। प्रत्येक चरण में यह आधार कार्यों की जोड़ी ढूंढता है जो वर्ग त्रुटियों के योग और सांख्यिकी त्रुटि में अवशेषों में अधिकतम कमी देता है (यह | MARS फिर मॉडल में जोड़े में आधार फ़ंक्शन को बार-बार जोड़ता है। प्रत्येक चरण में यह आधार कार्यों की जोड़ी ढूंढता है जो वर्ग त्रुटियों के योग और सांख्यिकी त्रुटि में अवशेषों में अधिकतम कमी देता है (यह [[लालची एल्गोरिदम]] है)। जोड़ी में दो आधार फ़ंक्शन समान हैं, सिवाय इसके कि प्रत्येक फ़ंक्शन के लिए मिरर किए गए हिंज फ़ंक्शन का अलग पक्ष उपयोग किया जाता है। प्रत्येक नए आधार फ़ंक्शन में मॉडल में पहले से ही शब्द शामिल होता है (जो शायद इंटरसेप्ट शब्द हो सकता है) नए हिंज फ़ंक्शन द्वारा गुणा किया जाता है। हिंज फ़ंक्शन को वेरिएबल और गाँठ द्वारा परिभाषित किया जाता है, इसलिए नया आधार फ़ंक्शन जोड़ने के लिए, MARS को निम्नलिखित के सभी संयोजनों को खोजना होगा: | ||

1) मौजूदा शब्द (इस संदर्भ में मूल शब्द कहे जाते हैं) | 1) मौजूदा शब्द (इस संदर्भ में मूल शब्द कहे जाते हैं) | ||

2) सभी चर (नए आधार फ़ंक्शन के लिए | 2) सभी चर (नए आधार फ़ंक्शन के लिए का चयन करने के लिए) | ||

3) प्रत्येक चर के सभी मान (नए काज फ़ंक्शन की गाँठ के लिए)। | 3) प्रत्येक चर के सभी मान (नए काज फ़ंक्शन की गाँठ के लिए)। | ||

प्रत्येक पद के गुणांक की गणना करने के लिए MARS पदों पर | प्रत्येक पद के गुणांक की गणना करने के लिए MARS पदों पर रेखीय प्रतिगमन लागू करता है। | ||

शब्दों को जोड़ने की यह प्रक्रिया तब तक जारी रहती है जब तक कि शेष त्रुटि में परिवर्तन जारी रखने के लिए बहुत छोटा न हो या जब तक शब्दों की अधिकतम संख्या न हो जाए। मॉडल निर्माण शुरू होने से पहले उपयोगकर्ता द्वारा शर्तों की अधिकतम संख्या निर्दिष्ट की जाती है। | शब्दों को जोड़ने की यह प्रक्रिया तब तक जारी रहती है जब तक कि शेष त्रुटि में परिवर्तन जारी रखने के लिए बहुत छोटा न हो या जब तक शब्दों की अधिकतम संख्या न हो जाए। मॉडल निर्माण शुरू होने से पहले उपयोगकर्ता द्वारा शर्तों की अधिकतम संख्या निर्दिष्ट की जाती है। | ||

प्रत्येक चरण पर खोज [[ पाशविक बल खोज ]]|ब्रूट-फोर्स फैशन में की जाती है, लेकिन MARS का | प्रत्येक चरण पर खोज [[ पाशविक बल खोज ]]|ब्रूट-फोर्स फैशन में की जाती है, लेकिन MARS का प्रमुख पहलू यह है कि हिंज कार्यों की प्रकृति के कारण तेजी से न्यूनतम-वर्ग अद्यतन तकनीक का उपयोग करके खोज अपेक्षाकृत तेज़ी से की जा सकती है। दरअसल, खोज बिल्कुल क्रूर बल नहीं है. खोज को [[ heuristics ]] के साथ तेज किया जा सकता है जो प्रत्येक चरण पर विचार करने के लिए मूल शब्दों की संख्या को कम कर देता है (फास्ट मार्स)<ref>[[Friedman, J. H.]] (1993) ''Fast MARS'', Stanford University Department of Statistics, Technical Report 110</ref>). | ||

=== पिछड़ा पास === | === पिछड़ा पास === | ||

फॉरवर्ड पास आमतौर पर | फॉरवर्ड पास आमतौर पर [[ ओवरफ़िट ]] मॉडल बनाता है। ( ओवरफिट मॉडल मॉडल बनाने के लिए उपयोग किए गए डेटा के लिए अच्छी तरह से फिट होता है लेकिन नए डेटा के लिए अच्छी तरह से सामान्यीकृत नहीं होगा।) बेहतर सामान्यीकरण क्षमता के साथ मॉडल बनाने के लिए, बैकवर्ड पास मॉडल को काटता है। यह - करके शब्दों को हटाता है, प्रत्येक चरण में सबसे कम प्रभावी शब्द को हटाता है जब तक कि उसे सबसे अच्छा सबमॉडल नहीं मिल जाता। मॉडल उपसमुच्चय की तुलना नीचे वर्णित सामान्यीकृत क्रॉस सत्यापन (जीसीवी) मानदंड का उपयोग करके की जाती है। | ||

फॉरवर्ड पास की तुलना में बैकवर्ड पास का | फॉरवर्ड पास की तुलना में बैकवर्ड पास का फायदा है: किसी भी चरण पर यह हटाने के लिए कोई भी शब्द चुन सकता है, जबकि प्रत्येक चरण पर फॉरवर्ड पास केवल शब्दों की अगली जोड़ी देख सकता है। | ||

फॉरवर्ड पास जोड़े में शब्द जोड़ता है, लेकिन बैकवर्ड पास आम तौर पर जोड़े के | फॉरवर्ड पास जोड़े में शब्द जोड़ता है, लेकिन बैकवर्ड पास आम तौर पर जोड़े के तरफ को हटा देता है और इसलिए अंतिम मॉडल में शब्द अक्सर जोड़े में नहीं देखे जाते हैं। के समीकरण में युग्मित काज देखा जा सकता है <math>\widehat{y}</math> उपरोक्त पहले मंगल उदाहरण में; ओजोन उदाहरण में कोई पूर्ण युग्म नहीं रखा गया है। | ||

==== सामान्यीकृत क्रॉस सत्यापन ==== | ==== सामान्यीकृत क्रॉस सत्यापन ==== | ||

{{further|Cross-validation (statistics)|Model selection}} | {{further|Cross-validation (statistics)|Model selection}} | ||

सबसे अच्छा सबसेट चुनने के लिए मॉडल सबसेट के प्रदर्शन की तुलना करने के लिए बैकवर्ड पास सामान्यीकृत क्रॉस वैलिडेशन (जीसीवी) का उपयोग करता है: जीसीवी के निचले मान बेहतर होते हैं। जीसीवी [[नियमितीकरण (मशीन लर्निंग)]] का | सबसे अच्छा सबसेट चुनने के लिए मॉडल सबसेट के प्रदर्शन की तुलना करने के लिए बैकवर्ड पास सामान्यीकृत क्रॉस वैलिडेशन (जीसीवी) का उपयोग करता है: जीसीवी के निचले मान बेहतर होते हैं। जीसीवी [[नियमितीकरण (मशीन लर्निंग)]] का रूप है: यह मॉडल जटिलता के मुकाबले फिट की अच्छाई का व्यापार करता है। | ||

(हम यह अनुमान लगाना चाहते हैं कि कोई मॉडल नए डेटा पर कितना अच्छा प्रदर्शन करता है, प्रशिक्षण डेटा पर नहीं। ऐसा नया डेटा आमतौर पर मॉडल निर्माण के समय उपलब्ध नहीं होता है, इसलिए इसके बजाय हम नए डेटा पर प्रदर्शन क्या होगा इसका अनुमान लगाने के लिए जीसीवी का उपयोग करते हैं। प्रशिक्षण डेटा पर वर्गों का कच्चा अवशिष्ट योग | [[वर्गों का अवशिष्ट योग]] (RSS) मॉडल की तुलना करने के लिए अपर्याप्त है, क्योंकि MARS शब्द हटा दिए जाने पर RSS हमेशा बढ़ता है। दूसरे शब्दों में, यदि RSS का उपयोग मॉडलों की तुलना करने के लिए किया जाता था, तो बैकवर्ड पास हमेशा सबसे बड़े मॉडल को चुनेगा - लेकिन सबसे बड़े मॉडल में आमतौर पर सबसे अच्छा सामान्यीकरण प्रदर्शन नहीं होता है।) | (हम यह अनुमान लगाना चाहते हैं कि कोई मॉडल नए डेटा पर कितना अच्छा प्रदर्शन करता है, प्रशिक्षण डेटा पर नहीं। ऐसा नया डेटा आमतौर पर मॉडल निर्माण के समय उपलब्ध नहीं होता है, इसलिए इसके बजाय हम नए डेटा पर प्रदर्शन क्या होगा इसका अनुमान लगाने के लिए जीसीवी का उपयोग करते हैं। प्रशिक्षण डेटा पर वर्गों का कच्चा अवशिष्ट योग | [[वर्गों का अवशिष्ट योग]] (RSS) मॉडल की तुलना करने के लिए अपर्याप्त है, क्योंकि MARS शब्द हटा दिए जाने पर RSS हमेशा बढ़ता है। दूसरे शब्दों में, यदि RSS का उपयोग मॉडलों की तुलना करने के लिए किया जाता था, तो बैकवर्ड पास हमेशा सबसे बड़े मॉडल को चुनेगा - लेकिन सबसे बड़े मॉडल में आमतौर पर सबसे अच्छा सामान्यीकरण प्रदर्शन नहीं होता है।) | ||

| Line 170: | Line 168: | ||

हिंज-फ़ंक्शन गांठों की संख्या है, इसलिए सूत्र गांठों को जोड़ने पर जुर्माना लगाता है। इस प्रकार जीसीवी फॉर्मूला मॉडल के लचीलेपन को ध्यान में रखते हुए प्रशिक्षण आरएसएस को समायोजित (यानी बढ़ाता है) करता है। हम लचीलेपन को दंडित करते हैं क्योंकि जो मॉडल बहुत लचीले हैं वे डेटा की व्यवस्थित संरचना के बजाय डेटा में शोर के विशिष्ट अहसास को मॉडल करेंगे। | हिंज-फ़ंक्शन गांठों की संख्या है, इसलिए सूत्र गांठों को जोड़ने पर जुर्माना लगाता है। इस प्रकार जीसीवी फॉर्मूला मॉडल के लचीलेपन को ध्यान में रखते हुए प्रशिक्षण आरएसएस को समायोजित (यानी बढ़ाता है) करता है। हम लचीलेपन को दंडित करते हैं क्योंकि जो मॉडल बहुत लचीले हैं वे डेटा की व्यवस्थित संरचना के बजाय डेटा में शोर के विशिष्ट अहसास को मॉडल करेंगे। | ||

सामान्यीकृत क्रॉस-सत्यापन को यह नाम दिया गया है क्योंकि यह त्रुटि का अनुमान लगाने के लिए | सामान्यीकृत क्रॉस-सत्यापन को यह नाम दिया गया है क्योंकि यह त्रुटि का अनुमान लगाने के लिए सूत्र का उपयोग करता है जिसे लीव-वन-आउट सत्यापन द्वारा निर्धारित किया जाएगा। यह सिर्फ अनुमान है लेकिन व्यवहार में अच्छा काम करता है। जीसीवी को क्रेवेन और [[ग्रेस वाहबा]] द्वारा पेश किया गया था और फ्रीडमैन द्वारा MARS के लिए विस्तारित किया गया था। | ||

===बाधाएँ === | ===बाधाएँ === | ||

बाधा का पहले ही उल्लेख किया जा चुका है: उपयोगकर्ता | |||

फॉरवर्ड पास में शब्दों की अधिकतम संख्या निर्दिष्ट कर सकता है। | फॉरवर्ड पास में शब्दों की अधिकतम संख्या निर्दिष्ट कर सकता है। | ||

फॉरवर्ड पास पर | फॉरवर्ड पास पर और बाधा लगाई जा सकती है | ||

बातचीत की अधिकतम स्वीकार्य डिग्री निर्दिष्ट करके। | बातचीत की अधिकतम स्वीकार्य डिग्री निर्दिष्ट करके। | ||

आम तौर पर केवल | आम तौर पर केवल या दो डिग्री की बातचीत की अनुमति होती है, | ||

लेकिन उच्च डिग्री का उपयोग तब किया जा सकता है जब डेटा इसकी गारंटी देता है। | लेकिन उच्च डिग्री का उपयोग तब किया जा सकता है जब डेटा इसकी गारंटी देता है। | ||

पहले MARS उदाहरण में अंतःक्रिया की अधिकतम डिग्री | पहले MARS उदाहरण में अंतःक्रिया की अधिकतम डिग्री | ||

उपरोक्त | उपरोक्त है (अर्थात् कोई इंटरैक्शन या कोई योगात्मक मॉडल नहीं); | ||

ओजोन उदाहरण में यह दो है। | ओजोन उदाहरण में यह दो है। | ||

| Line 192: | Line 190: | ||

== पक्ष और विपक्ष == | == पक्ष और विपक्ष == | ||

कोई भी प्रतिगमन मॉडलिंग तकनीक सभी स्थितियों के लिए सर्वोत्तम नहीं है। | कोई भी प्रतिगमन मॉडलिंग तकनीक सभी स्थितियों के लिए सर्वोत्तम नहीं है। | ||

नीचे दिए गए दिशानिर्देशों का उद्देश्य मंगल ग्रह के फायदे और नुकसान का | नीचे दिए गए दिशानिर्देशों का उद्देश्य मंगल ग्रह के फायदे और नुकसान का विचार देना है। | ||

लेकिन दिशानिर्देशों के अपवाद होंगे। | लेकिन दिशानिर्देशों के अपवाद होंगे। | ||

मंगल की तुलना पुनरावर्ती विभाजन से करना उपयोगी है और यह नीचे किया गया है। | मंगल की तुलना पुनरावर्ती विभाजन से करना उपयोगी है और यह नीचे किया गया है। | ||

| Line 203: | Line 199: | ||

*MARS मॉडल रैखिक प्रतिगमन मॉडल की तुलना में अधिक लचीले होते हैं। | *MARS मॉडल रैखिक प्रतिगमन मॉडल की तुलना में अधिक लचीले होते हैं। | ||

*MARS मॉडल समझने और व्याख्या करने में सरल हैं।<ref name=":0">{{Cite book|title=एप्लाइड प्रेडिक्टिव मॉडलिंग|last1=Kuhn|first1=Max|last2=Johnson|first2=Kjell|date=2013|publisher=Springer New York|isbn=9781461468486|location=New York, NY|language=en|doi=10.1007/978-1-4614-6849-3}}</ref> उपरोक्त ओजोन सांद्रता के समीकरण की तुलना, मान लीजिए, | *MARS मॉडल समझने और व्याख्या करने में सरल हैं।<ref name=":0">{{Cite book|title=एप्लाइड प्रेडिक्टिव मॉडलिंग|last1=Kuhn|first1=Max|last2=Johnson|first2=Kjell|date=2013|publisher=Springer New York|isbn=9781461468486|location=New York, NY|language=en|doi=10.1007/978-1-4614-6849-3}}</ref> उपरोक्त ओजोन सांद्रता के समीकरण की तुलना, मान लीजिए, प्रशिक्षित [[कृत्रिम तंत्रिका नेटवर्क]] या यादृच्छिक जंगल के अंदरूनी हिस्सों से करें। | ||

*MARS निरंतर और श्रेणीबद्ध डेटा दोनों को संभाल सकता है।<ref>{{cite book | last=Friedman | first=Jerome H. | chapter=Estimating Functions of Mixed Ordinal and Categorical Variables Using Adaptive Splines | author-link=Friedman, J. H.|year=1993|title=सांख्यिकीय डेटा विश्लेषण और मजबूती में नई दिशाएँ|editor=Stephan Morgenthaler |editor2=Elvezio Ronchetti |editor3=Werner Stahel|publisher=Birkhauser}}</ref><ref name="Friedman 1991">{{cite journal | last=Friedman | first=Jerome H. | title=अनुकूली स्प्लाइन का उपयोग करके मिश्रित क्रमसूचक और श्रेणीबद्ध चर के कार्यों का अनुमान लगाना| website=DTIC | date=1991-06-01 | url=https://apps.dtic.mil/sti/citations/ADA590939 | archive-url=https://web.archive.org/web/20220411085148/https://apps.dtic.mil/sti/citations/ADA590939 | url-status=live | archive-date=April 11, 2022 | access-date=2022-04-11}}</ref> MARS संख्यात्मक डेटा के लिए पुनरावर्ती विभाजन से बेहतर होता है क्योंकि पुनरावर्ती विभाजन द्वारा उपयोग किए जाने वाले टुकड़े-टुकड़े निरंतर विभाजन की तुलना में संख्यात्मक चर के लिए टिका अधिक उपयुक्त होती है। | *MARS निरंतर और श्रेणीबद्ध डेटा दोनों को संभाल सकता है।<ref>{{cite book | last=Friedman | first=Jerome H. | chapter=Estimating Functions of Mixed Ordinal and Categorical Variables Using Adaptive Splines | author-link=Friedman, J. H.|year=1993|title=सांख्यिकीय डेटा विश्लेषण और मजबूती में नई दिशाएँ|editor=Stephan Morgenthaler |editor2=Elvezio Ronchetti |editor3=Werner Stahel|publisher=Birkhauser}}</ref><ref name="Friedman 1991">{{cite journal | last=Friedman | first=Jerome H. | title=अनुकूली स्प्लाइन का उपयोग करके मिश्रित क्रमसूचक और श्रेणीबद्ध चर के कार्यों का अनुमान लगाना| website=DTIC | date=1991-06-01 | url=https://apps.dtic.mil/sti/citations/ADA590939 | archive-url=https://web.archive.org/web/20220411085148/https://apps.dtic.mil/sti/citations/ADA590939 | url-status=live | archive-date=April 11, 2022 | access-date=2022-04-11}}</ref> MARS संख्यात्मक डेटा के लिए पुनरावर्ती विभाजन से बेहतर होता है क्योंकि पुनरावर्ती विभाजन द्वारा उपयोग किए जाने वाले टुकड़े-टुकड़े निरंतर विभाजन की तुलना में संख्यात्मक चर के लिए टिका अधिक उपयुक्त होती है। | ||

*MARS मॉडल के निर्माण के लिए अक्सर बहुत कम या कोई डेटा तैयारी की आवश्यकता नहीं होती है।<ref name=":0" />हिंज फ़ंक्शन स्वचालित रूप से इनपुट डेटा को विभाजित करता है, इसलिए आउटलेर्स का प्रभाव निहित होता है। इस संबंध में MARS पुनरावर्ती विभाजन के समान है जो डेटा को असंयुक्त क्षेत्रों में भी विभाजित करता है, हालांकि | *MARS मॉडल के निर्माण के लिए अक्सर बहुत कम या कोई डेटा तैयारी की आवश्यकता नहीं होती है।<ref name=":0" />हिंज फ़ंक्शन स्वचालित रूप से इनपुट डेटा को विभाजित करता है, इसलिए आउटलेर्स का प्रभाव निहित होता है। इस संबंध में MARS पुनरावर्ती विभाजन के समान है जो डेटा को असंयुक्त क्षेत्रों में भी विभाजित करता है, हालांकि अलग विधि का उपयोग करता है। (फिर भी, अधिकांश सांख्यिकीय मॉडलिंग तकनीकों की तरह, MARS मॉडल को प्रशिक्षित करने से पहले ज्ञात आउटलेर्स को हटाने पर विचार किया जाना चाहिए।{{Citation needed|date=March 2019}}) | ||

*MARS (पुनरावर्ती विभाजन की तरह) स्वचालित फ़ीचर चयन करता है (जिसका अर्थ है कि यह मॉडल में महत्वपूर्ण चर शामिल करता है और महत्वहीन को बाहर कर देता है)। हालाँकि, चयन में कुछ मनमानी हो सकती है, खासकर जब सहसंबद्ध भविष्यवक्ता हों, और यह व्याख्या को प्रभावित कर सकता है<ref name=":0" />*MARS मॉडल में पूर्वाग्रह-विचरण का अच्छा समझौता होता है। मॉडल गैर-रैखिकता और परिवर्तनीय इंटरैक्शन को मॉडल करने के लिए पर्याप्त लचीले हैं (इस प्रकार MARS मॉडल में काफी कम पूर्वाग्रह है), फिर भी MARS आधार कार्यों का बाधित रूप बहुत अधिक लचीलेपन को रोकता है (इस प्रकार MARS मॉडल में काफी कम भिन्नता होती है)। | *MARS (पुनरावर्ती विभाजन की तरह) स्वचालित फ़ीचर चयन करता है (जिसका अर्थ है कि यह मॉडल में महत्वपूर्ण चर शामिल करता है और महत्वहीन को बाहर कर देता है)। हालाँकि, चयन में कुछ मनमानी हो सकती है, खासकर जब सहसंबद्ध भविष्यवक्ता हों, और यह व्याख्या को प्रभावित कर सकता है<ref name=":0" />*MARS मॉडल में पूर्वाग्रह-विचरण का अच्छा समझौता होता है। मॉडल गैर-रैखिकता और परिवर्तनीय इंटरैक्शन को मॉडल करने के लिए पर्याप्त लचीले हैं (इस प्रकार MARS मॉडल में काफी कम पूर्वाग्रह है), फिर भी MARS आधार कार्यों का बाधित रूप बहुत अधिक लचीलेपन को रोकता है (इस प्रकार MARS मॉडल में काफी कम भिन्नता होती है)। | ||

*MARS काफी बड़े डेटासेट को संभालने के लिए उपयुक्त है। 100 भविष्यवक्ताओं और 10 के साथ | *MARS काफी बड़े डेटासेट को संभालने के लिए उपयुक्त है। 100 भविष्यवक्ताओं और 10 के साथ इनपुट मैट्रिक्स से MARS मॉडल बनाना नियमित मामला है<sup>5</sup>अवलोकन. ऐसा मॉडल 1 गीगाहर्ट्ज मशीन पर लगभग मिनट में बनाया जा सकता है, यह मानते हुए कि MARS शब्दों की परस्पर क्रिया की अधिकतम डिग्री तक सीमित है (यानी केवल योगात्मक शब्द)। समान 1 गीगाहर्ट्ज़ मशीन पर समान डेटा वाले डिग्री दो मॉडल को अधिक समय लगता है - लगभग 12 मिनट। ध्यान रखें कि यह समय अत्यधिक डेटा पर निर्भर है। पुनरावर्ती विभाजन MARS की तुलना में बहुत तेज़ है।{{Citation needed|date=March 2019}} | ||

*MARS मॉडल के साथ, किसी भी गैर-पैरामीट्रिक प्रतिगमन की तरह, पैरामीटर आत्मविश्वास अंतराल और मॉडल पर अन्य जांचों की गणना सीधे नहीं की जा सकती (रैखिक प्रतिगमन मॉडल के विपरीत)। क्रॉस-वैलिडेशन (सांख्यिकी)|इसके बजाय मॉडल को मान्य करने के लिए क्रॉस-वैलिडेशन और संबंधित तकनीकों का उपयोग किया जाना चाहिए। | *MARS मॉडल के साथ, किसी भी गैर-पैरामीट्रिक प्रतिगमन की तरह, पैरामीटर आत्मविश्वास अंतराल और मॉडल पर अन्य जांचों की गणना सीधे नहीं की जा सकती (रैखिक प्रतिगमन मॉडल के विपरीत)। क्रॉस-वैलिडेशन (सांख्यिकी)|इसके बजाय मॉडल को मान्य करने के लिए क्रॉस-वैलिडेशन और संबंधित तकनीकों का उपयोग किया जाना चाहिए। | ||

*MARS मॉडल [[बूस्टिंग (मेटा-एल्गोरिदम)]] पेड़ों के समान अच्छे फिट नहीं देते हैं, लेकिन इन्हें अधिक तेज़ी से बनाया जा सकता है और ये अधिक व्याख्या योग्य हैं। ( | *MARS मॉडल [[बूस्टिंग (मेटा-एल्गोरिदम)]] पेड़ों के समान अच्छे फिट नहीं देते हैं, लेकिन इन्हें अधिक तेज़ी से बनाया जा सकता है और ये अधिक व्याख्या योग्य हैं। ( 'व्याख्यात्मक' मॉडल ऐसे रूप में है जो यह स्पष्ट करता है कि प्रत्येक भविष्यवक्ता का प्रभाव क्या है।) | ||

* <code>earth</code>का>, <code>mda</code>, और <code>polspline</code> कार्यान्वयन भविष्यवक्ताओं में लापता मूल्यों की अनुमति नहीं देता है, लेकिन प्रतिगमन पेड़ों (जैसे) के मुफ्त कार्यान्वयन की अनुमति देता है <code>rpart</code> और <code>party</code>) सरोगेट स्प्लिट्स नामक तकनीक का उपयोग करके लापता मानों की अनुमति दें। | * <code>earth</code>का>, <code>mda</code>, और <code>polspline</code> कार्यान्वयन भविष्यवक्ताओं में लापता मूल्यों की अनुमति नहीं देता है, लेकिन प्रतिगमन पेड़ों (जैसे) के मुफ्त कार्यान्वयन की अनुमति देता है <code>rpart</code> और <code>party</code>) सरोगेट स्प्लिट्स नामक तकनीक का उपयोग करके लापता मानों की अनुमति दें। | ||

*MARS मॉडल शीघ्रता से भविष्यवाणियां कर सकते हैं। भविष्यवाणी फ़ंक्शन को बस MARS मॉडल सूत्र का मूल्यांकन करना है। इसकी तुलना | *MARS मॉडल शीघ्रता से भविष्यवाणियां कर सकते हैं। भविष्यवाणी फ़ंक्शन को बस MARS मॉडल सूत्र का मूल्यांकन करना है। इसकी तुलना [[ समर्थन वेक्टर यंत्र ]] के साथ भविष्यवाणी करने से करें, जहां प्रत्येक वेरिएबल को प्रत्येक सपोर्ट वेक्टर के संबंधित तत्व से गुणा करना होता है। यदि कई चर और कई समर्थन वैक्टर हैं तो यह धीमी प्रक्रिया हो सकती है। | ||

*परिणामस्वरूप फिट किया गया फ़ंक्शन सुचारू नहीं है (टिका के साथ अलग-अलग नहीं)। | *परिणामस्वरूप फिट किया गया फ़ंक्शन सुचारू नहीं है (टिका के साथ अलग-अलग नहीं)। | ||

== विस्तार और संबंधित अवधारणाएँ == | == विस्तार और संबंधित अवधारणाएँ == | ||

* [[सामान्यीकृत रैखिक मॉडल]] (जीएलएम) को MARS मॉडल के निर्माण के बाद | * [[सामान्यीकृत रैखिक मॉडल]] (जीएलएम) को MARS मॉडल के निर्माण के बाद लिंक फ़ंक्शन लागू करके MARS मॉडल में शामिल किया जा सकता है। इस प्रकार, उदाहरण के लिए, MARS मॉडल संभावनाओं की भविष्यवाणी करने के लिए [[ संभार तन्त्र परावर्तन ]] को शामिल कर सकते हैं। | ||

* [[अरेखीय प्रतिगमन]]|नॉन-लीनियर रिग्रेशन का उपयोग तब किया जाता है जब फ़ंक्शन का अंतर्निहित रूप ज्ञात होता है और रिग्रेशन का उपयोग केवल उस फ़ंक्शन के मापदंडों का अनुमान लगाने के लिए किया जाता है। दूसरी ओर, मंगल स्वयं कार्यों का अनुमान लगाता है, यद्यपि कार्यों की प्रकृति पर गंभीर बाधाएं होती हैं। (ये बाधाएँ आवश्यक हैं क्योंकि डेटा से | * [[अरेखीय प्रतिगमन]]|नॉन-लीनियर रिग्रेशन का उपयोग तब किया जाता है जब फ़ंक्शन का अंतर्निहित रूप ज्ञात होता है और रिग्रेशन का उपयोग केवल उस फ़ंक्शन के मापदंडों का अनुमान लगाने के लिए किया जाता है। दूसरी ओर, मंगल स्वयं कार्यों का अनुमान लगाता है, यद्यपि कार्यों की प्रकृति पर गंभीर बाधाएं होती हैं। (ये बाधाएँ आवश्यक हैं क्योंकि डेटा से मॉडल की खोज करना विपरीत समस्या है जो मॉडल पर बाधाओं के बिना [[अच्छी तरह से प्रस्तुत समस्या]] नहीं है।) | ||

* पुनरावर्ती विभाजन (आमतौर पर कार्ट कहा जाता है)। MARS को पुनरावर्ती विभाजन के सामान्यीकरण के रूप में देखा जा सकता है जो मॉडल को संख्यात्मक (यानी गैर-श्रेणीबद्ध) डेटा को बेहतर ढंग से संभालने की अनुमति देता है। | * पुनरावर्ती विभाजन (आमतौर पर कार्ट कहा जाता है)। MARS को पुनरावर्ती विभाजन के सामान्यीकरण के रूप में देखा जा सकता है जो मॉडल को संख्यात्मक (यानी गैर-श्रेणीबद्ध) डेटा को बेहतर ढंग से संभालने की अनुमति देता है। | ||

* [[सामान्यीकृत योगात्मक मॉडल]]। उपयोगकर्ता के नजरिए से GAM, MARS के समान हैं, लेकिन (ए) MARS आधार कार्यों के बजाय सुचारू [[स्थानीय प्रतिगमन]] या बहुपद स्पलाइन (गणित) में फिट होते हैं, और (बी) स्वचालित रूप से परिवर्तनीय इंटरैक्शन को मॉडल नहीं करते हैं। GAMs द्वारा आंतरिक रूप से उपयोग की जाने वाली फिटिंग विधि MARS से बहुत अलग है। ऐसे मॉडलों के लिए जिन्हें परिवर्तनीय इंटरैक्शन की स्वचालित खोज की आवश्यकता नहीं होती है, GAMs अक्सर MARS के साथ अनुकूल प्रतिस्पर्धा करते हैं। | * [[सामान्यीकृत योगात्मक मॉडल]]। उपयोगकर्ता के नजरिए से GAM, MARS के समान हैं, लेकिन (ए) MARS आधार कार्यों के बजाय सुचारू [[स्थानीय प्रतिगमन]] या बहुपद स्पलाइन (गणित) में फिट होते हैं, और (बी) स्वचालित रूप से परिवर्तनीय इंटरैक्शन को मॉडल नहीं करते हैं। GAMs द्वारा आंतरिक रूप से उपयोग की जाने वाली फिटिंग विधि MARS से बहुत अलग है। ऐसे मॉडलों के लिए जिन्हें परिवर्तनीय इंटरैक्शन की स्वचालित खोज की आवश्यकता नहीं होती है, GAMs अक्सर MARS के साथ अनुकूल प्रतिस्पर्धा करते हैं। | ||

* [[टीएसएमएआरएस]]। टाइम सीरीज़ मार्स वह शब्द है जिसका उपयोग तब किया जाता है जब MARS मॉडल को टाइम सीरीज़ संदर्भ में लागू किया जाता है। आमतौर पर इस सेट अप में भविष्यवक्ता विलंबित समय श्रृंखला मान होते हैं जिसके परिणामस्वरूप ऑटोरेग्रेसिव स्पलाइन मॉडल होते हैं। मूविंग एवरेज स्पलाइन मॉडल को शामिल करने के लिए इन मॉडलों और | * [[टीएसएमएआरएस]]। टाइम सीरीज़ मार्स वह शब्द है जिसका उपयोग तब किया जाता है जब MARS मॉडल को टाइम सीरीज़ संदर्भ में लागू किया जाता है। आमतौर पर इस सेट अप में भविष्यवक्ता विलंबित समय श्रृंखला मान होते हैं जिसके परिणामस्वरूप ऑटोरेग्रेसिव स्पलाइन मॉडल होते हैं। मूविंग एवरेज स्पलाइन मॉडल को शामिल करने के लिए इन मॉडलों और ्सटेंशनों को टीएसएमएआरएस का उपयोग करके यूनीवेरिएट टाइम सीरीज़ मॉडलिंग और पूर्वानुमान में वर्णित किया गया है: टीएसएमएआरएस का उपयोग करके थ्रेशोल्ड टाइम सीरीज़ ऑटोरेग्रेसिव, मौसमी और मूविंग औसत मॉडल का अध्ययन। | ||

* [[ बायेसियन मंगल ]] (बीएमएआरएस) | * [[ बायेसियन मंगल ]] (बीएमएआरएस) ही मॉडल फॉर्म का उपयोग करता है, लेकिन बायेसियन दृष्टिकोण का उपयोग करके मॉडल बनाता है। यह विभिन्न इष्टतम MARS मॉडल पर पहुंच सकता है क्योंकि मॉडल निर्माण का दृष्टिकोण अलग है। BMARS का परिणाम आम तौर पर MARS मॉडल के पिछले नमूनों का समूह होता है, जो संभाव्य भविष्यवाणी की अनुमति देता है।<ref>{{cite journal |last1=Denison |first1=D. G. T. |last2=Mallick |first2=B. K. |last3=Smith |first3=A. F. M. |title=बायेसियन मंगल|journal=Statistics and Computing |date=1 December 1998 |volume=8 |issue=4 |pages=337–346 |doi=10.1023/A:1008824606259 |s2cid=12570055 |url=https://link.springer.com/content/pdf/10.1023/A:1008824606259.pdf |language=en |issn=1573-1375}}</ref> | ||

== यह भी देखें == | == यह भी देखें == | ||

| Line 244: | Line 239: | ||

== बाहरी संबंध == | == बाहरी संबंध == | ||

Several free and commercial software packages are available for fitting MARS-type models. | Several free and commercial software packages are available for fitting MARS-type models. | ||

Revision as of 18:49, 11 July 2023

आंकड़ों में, बहुभिन्नरूपी अनुकूली प्रतिगमन स्प्लिन (MARS) 1991 में जेरोम एच. फ्रीडमैन द्वारा शुरू किए गए प्रतिगमन विश्लेषण का रूप है।[1] यह गैर-पैरामीट्रिक प्रतिगमन तकनीक है और इसे रैखिक मॉडल के विस्तार के रूप में देखा जा सकता है जो स्वचालित रूप से चर के बीच गैर-रैखिकता और इंटरैक्शन को मॉडल करता है।

MARS शब्द को सैलफोर्ड सिस्टम्स द्वारा ट्रेडमार्क और लाइसेंस प्राप्त है। ट्रेडमार्क उल्लंघनों से बचने के लिए, MARS के कई ओपन-सोर्स कार्यान्वयनों को Earth कहा जाता है।[2][3]

मूल बातें

यह खंड कुछ उदाहरणों का उपयोग करके मंगल ग्रह का परिचय देता है। हम डेटा के सेट से शुरू करते हैं: इनपुट चर x का मैट्रिक्स, और देखी गई प्रतिक्रियाओं y का वेक्टर, x में प्रत्येक पंक्ति के लिए प्रतिक्रिया के साथ। उदाहरण के लिए, डेटा हो सकता है:

| x | y |

|---|---|

| 10.5 | 16.4 |

| 10.7 | 18.8 |

| 10.8 | 19.7 |

| ... | ... |

| 20.6 | 77.0 |

यहां केवल आश्रित और स्वतंत्र चर है, इसलिए x मैट्रिक्स केवल कॉलम है। इन मापों को देखते हुए, हम मॉडल बनाना चाहेंगे जो किसी दिए गए x के लिए अपेक्षित y की भविष्यवाणी करता है।

उपरोक्त डेटा के लिए रैखिक मॉडल है

पर टोपी दर्शाता है कि डेटा से अनुमान लगाया गया है. दाईं ओर का चित्र इस फ़ंक्शन का प्लॉट दिखाता है: भविष्यवाणी बताने वाली पंक्ति बनाम x, y के मूल मान को लाल बिंदुओं के रूप में दिखाया गया है।

x के चरम पर डेटा इंगित करता है कि y और x के बीच संबंध गैर-रैखिक हो सकता है (x के निम्न और उच्च मूल्यों पर प्रतिगमन रेखा के सापेक्ष लाल बिंदुओं को देखें)। इस प्रकार हम गैर-रैखिकताओं को ध्यान में रखते हुए स्वचालित रूप से मॉडल बनाने के लिए MARS की ओर रुख करते हैं। MARS सॉफ़्टवेयर दिए गए x और y से निम्नानुसार मॉडल बनाता है

दाईं ओर का चित्र इस फ़ंक्शन का प्लॉट दिखाता है: पूर्वानुमानित बनाम x, y के मूल मानों को बार फिर लाल बिंदुओं के रूप में दिखाया गया है। पूर्वानुमानित प्रतिक्रिया अब मूल y मानों के लिए बेहतर अनुकूल है।

गैर-रैखिकता को ध्यान में रखने के लिए MARS ने स्वचालित रूप से अनुमानित y में मोड़ उत्पन्न किया है। किंक का निर्माण हिंज कार्यों द्वारा होता है। हिंज फ़ंक्शंस से शुरू होने वाले भाव हैं (कहाँ है अगर , अन्य ). हिंज फ़ंक्शंस का नीचे अधिक विस्तार से वर्णन किया गया है।

इस सरल उदाहरण में, हम प्लॉट से आसानी से देख सकते हैं कि y का x के साथ गैर-रैखिक संबंध है (और शायद अनुमान लगा सकते हैं कि y, x के वर्ग के साथ बदलता रहता है)। हालाँकि, सामान्य तौर पर कई आश्रित और स्वतंत्र चर होंगे, और y और इन चर के बीच संबंध अस्पष्ट होगा और प्लॉटिंग द्वारा आसानी से दिखाई नहीं देगा। हम उस गैर-रैखिक संबंध की खोज के लिए MARS का उपयोग कर सकते हैं।

अनेक चरों के साथ MARS अभिव्यक्ति का उदाहरण है

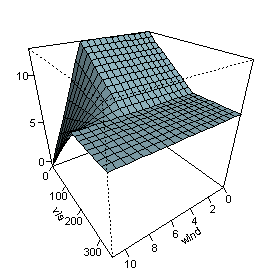

यह अभिव्यक्ति वायु प्रदूषण (ओजोन स्तर) को तापमान और कुछ अन्य चर के आधार पर दर्शाती है। ध्यान दें कि सूत्र में अंतिम पद (अंतिम पंक्ति पर) के बीच परस्पर क्रिया शामिल है और .

सही प्लॉट पर दिए गए आंकड़े की भविष्यवाणी की गई है जैसा और भिन्न-भिन्न होते हैं, अन्य चर उनके मध्य मानों पर निश्चित होते हैं। यह आंकड़ा दर्शाता है कि हवा ओजोन स्तर को तब तक प्रभावित नहीं करती जब तक दृश्यता कम न हो। हम देखते हैं कि MARS काज कार्यों के संयोजन से काफी लचीली प्रतिगमन सतहों का निर्माण कर सकता है।

उपरोक्त अभिव्यक्ति प्राप्त करने के लिए, MARS मॉडल निर्माण प्रक्रिया स्वचालित रूप से चयन करती है कि कौन से चर का उपयोग करना है (कुछ चर महत्वपूर्ण हैं, अन्य नहीं), काज कार्यों में किंक की स्थिति, और काज कार्यों को कैसे संयोजित किया जाता है।

मंगल मॉडल

MARS फॉर्म के मॉडल बनाता है

मॉडल आधार कार्यों का भारित योग है . प्रत्येक स्थिर गुणांक है. उदाहरण के लिए, उपरोक्त ओजोन के सूत्र में प्रत्येक पंक्ति आधार कार्य है इसके गुणांक से गुणा किया गया।

प्रत्येक आधार कार्य निम्नलिखित तीन रूपों में से लेता है:

1) अचर 1. ऐसा केवल ही पद है, अंतःखंड। उपरोक्त ओजोन सूत्र में, अवरोधन पद 5.2 है।

2) काज समारोह. काज फ़ंक्शन का रूप होता है या . MARS हिंज फ़ंक्शंस की गांठों के लिए स्वचालित रूप से उन चरों के चर और मानों का चयन करता है। ऐसे आधार कार्यों के उदाहरण ओजोन सूत्र की मध्य तीन पंक्तियों में देखे जा सकते हैं।

3) दो या दो से अधिक काज कार्यों का उत्पाद। ये आधार कार्य दो या दो से अधिक चरों के बीच अंतःक्रिया को मॉडल कर सकते हैं। उदाहरण ओजोन सूत्र की अंतिम पंक्ति है।

काज कार्य

MARS मॉडल का प्रमुख हिस्सा रूप धारण करने वाले हिंज फ़ंक्शन हैं

या

कहाँ स्थिरांक है, जिसे गाँठ कहा जाता है। दाईं ओर का चित्र 3.1 पर गाँठ के साथ काज कार्यों की प्रतिबिंबित जोड़ी को दर्शाता है।

हिंज फ़ंक्शन इसकी सीमा के हिस्से के लिए शून्य है, इसलिए इसका उपयोग डेटा को असंयुक्त क्षेत्रों में विभाजित करने के लिए किया जा सकता है, जिनमें से प्रत्येक को स्वतंत्र रूप से व्यवहार किया जा सकता है। इस प्रकार, उदाहरण के लिए अभिव्यक्ति में काज की प्रतिबिंबित जोड़ी कार्य करती है

पिछले अनुभाग में सरल MARS मॉडल के लिए दिखाया गया टुकड़ावार रैखिक ग्राफ़ बनाता है।

कोई यह मान सकता है कि हिंज फ़ंक्शंस से केवल टुकड़े-टुकड़े रैखिक फ़ंक्शंस बनाए जा सकते हैं, लेकिन नॉन-लीनियर फ़ंक्शंस बनाने के लिए हिंज फ़ंक्शंस को साथ गुणा किया जा सकता है।

हिंज फ़ंक्शंस को रैंप समारोह, आइस हॉकी स्टिक, या रेक्टिफायर (तंत्रिका नेटवर्क) फ़ंक्शंस भी कहा जाता है। बदले में इस आलेख में उपयोग किए गए नोटेशन में, हिंज फ़ंक्शंस को अक्सर दर्शाया जाता है कहाँ मतलब सकारात्मक हिस्सा लें.

मॉडल निर्माण प्रक्रिया

MARS दो चरणों में मॉडल बनाता है: आगे और पीछे का मार्ग। यह दो-चरणीय दृष्टिकोण वैसा ही है जैसा कि द्वारा उपयोग किया जाता है पुनरावर्ती विभाजन वृक्ष.

फॉरवर्ड पास

MARS मॉडल से शुरू होता है जिसमें केवल इंटरसेप्ट टर्म होता है (जो प्रतिक्रिया मूल्यों का माध्य है)।

MARS फिर मॉडल में जोड़े में आधार फ़ंक्शन को बार-बार जोड़ता है। प्रत्येक चरण में यह आधार कार्यों की जोड़ी ढूंढता है जो वर्ग त्रुटियों के योग और सांख्यिकी त्रुटि में अवशेषों में अधिकतम कमी देता है (यह लालची एल्गोरिदम है)। जोड़ी में दो आधार फ़ंक्शन समान हैं, सिवाय इसके कि प्रत्येक फ़ंक्शन के लिए मिरर किए गए हिंज फ़ंक्शन का अलग पक्ष उपयोग किया जाता है। प्रत्येक नए आधार फ़ंक्शन में मॉडल में पहले से ही शब्द शामिल होता है (जो शायद इंटरसेप्ट शब्द हो सकता है) नए हिंज फ़ंक्शन द्वारा गुणा किया जाता है। हिंज फ़ंक्शन को वेरिएबल और गाँठ द्वारा परिभाषित किया जाता है, इसलिए नया आधार फ़ंक्शन जोड़ने के लिए, MARS को निम्नलिखित के सभी संयोजनों को खोजना होगा:

1) मौजूदा शब्द (इस संदर्भ में मूल शब्द कहे जाते हैं)

2) सभी चर (नए आधार फ़ंक्शन के लिए का चयन करने के लिए)

3) प्रत्येक चर के सभी मान (नए काज फ़ंक्शन की गाँठ के लिए)।

प्रत्येक पद के गुणांक की गणना करने के लिए MARS पदों पर रेखीय प्रतिगमन लागू करता है।

शब्दों को जोड़ने की यह प्रक्रिया तब तक जारी रहती है जब तक कि शेष त्रुटि में परिवर्तन जारी रखने के लिए बहुत छोटा न हो या जब तक शब्दों की अधिकतम संख्या न हो जाए। मॉडल निर्माण शुरू होने से पहले उपयोगकर्ता द्वारा शर्तों की अधिकतम संख्या निर्दिष्ट की जाती है।

प्रत्येक चरण पर खोज पाशविक बल खोज |ब्रूट-फोर्स फैशन में की जाती है, लेकिन MARS का प्रमुख पहलू यह है कि हिंज कार्यों की प्रकृति के कारण तेजी से न्यूनतम-वर्ग अद्यतन तकनीक का उपयोग करके खोज अपेक्षाकृत तेज़ी से की जा सकती है। दरअसल, खोज बिल्कुल क्रूर बल नहीं है. खोज को heuristics के साथ तेज किया जा सकता है जो प्रत्येक चरण पर विचार करने के लिए मूल शब्दों की संख्या को कम कर देता है (फास्ट मार्स)[4]).

पिछड़ा पास

फॉरवर्ड पास आमतौर पर ओवरफ़िट मॉडल बनाता है। ( ओवरफिट मॉडल मॉडल बनाने के लिए उपयोग किए गए डेटा के लिए अच्छी तरह से फिट होता है लेकिन नए डेटा के लिए अच्छी तरह से सामान्यीकृत नहीं होगा।) बेहतर सामान्यीकरण क्षमता के साथ मॉडल बनाने के लिए, बैकवर्ड पास मॉडल को काटता है। यह - करके शब्दों को हटाता है, प्रत्येक चरण में सबसे कम प्रभावी शब्द को हटाता है जब तक कि उसे सबसे अच्छा सबमॉडल नहीं मिल जाता। मॉडल उपसमुच्चय की तुलना नीचे वर्णित सामान्यीकृत क्रॉस सत्यापन (जीसीवी) मानदंड का उपयोग करके की जाती है।

फॉरवर्ड पास की तुलना में बैकवर्ड पास का फायदा है: किसी भी चरण पर यह हटाने के लिए कोई भी शब्द चुन सकता है, जबकि प्रत्येक चरण पर फॉरवर्ड पास केवल शब्दों की अगली जोड़ी देख सकता है।

फॉरवर्ड पास जोड़े में शब्द जोड़ता है, लेकिन बैकवर्ड पास आम तौर पर जोड़े के तरफ को हटा देता है और इसलिए अंतिम मॉडल में शब्द अक्सर जोड़े में नहीं देखे जाते हैं। के समीकरण में युग्मित काज देखा जा सकता है उपरोक्त पहले मंगल उदाहरण में; ओजोन उदाहरण में कोई पूर्ण युग्म नहीं रखा गया है।

सामान्यीकृत क्रॉस सत्यापन

सबसे अच्छा सबसेट चुनने के लिए मॉडल सबसेट के प्रदर्शन की तुलना करने के लिए बैकवर्ड पास सामान्यीकृत क्रॉस वैलिडेशन (जीसीवी) का उपयोग करता है: जीसीवी के निचले मान बेहतर होते हैं। जीसीवी नियमितीकरण (मशीन लर्निंग) का रूप है: यह मॉडल जटिलता के मुकाबले फिट की अच्छाई का व्यापार करता है।

(हम यह अनुमान लगाना चाहते हैं कि कोई मॉडल नए डेटा पर कितना अच्छा प्रदर्शन करता है, प्रशिक्षण डेटा पर नहीं। ऐसा नया डेटा आमतौर पर मॉडल निर्माण के समय उपलब्ध नहीं होता है, इसलिए इसके बजाय हम नए डेटा पर प्रदर्शन क्या होगा इसका अनुमान लगाने के लिए जीसीवी का उपयोग करते हैं। प्रशिक्षण डेटा पर वर्गों का कच्चा अवशिष्ट योग | वर्गों का अवशिष्ट योग (RSS) मॉडल की तुलना करने के लिए अपर्याप्त है, क्योंकि MARS शब्द हटा दिए जाने पर RSS हमेशा बढ़ता है। दूसरे शब्दों में, यदि RSS का उपयोग मॉडलों की तुलना करने के लिए किया जाता था, तो बैकवर्ड पास हमेशा सबसे बड़े मॉडल को चुनेगा - लेकिन सबसे बड़े मॉडल में आमतौर पर सबसे अच्छा सामान्यीकरण प्रदर्शन नहीं होता है।)

जीसीवी का सूत्र है

- जीसीवी = आरएसएस / (एन · (1 - (पैरामीटर की प्रभावी संख्या) / एन)2)

जहां RSS प्रशिक्षण डेटा पर मापा गया वर्गों का अवशिष्ट योग है और N अवलोकनों की संख्या ('x' मैट्रिक्स में पंक्तियों की संख्या) है।

EffectiveNumberOfParameters को परिभाषित किया गया है मंगल ग्रह संदर्भ के रूप में

- (मापदंडों की प्रभावी संख्या) = (मंगल के पदों की संख्या) + (दंड) · ((मंगल के पदों की संख्या) − 1 ) / 2

जहां 'जुर्माना' लगभग 2 या 3 है (एमएआरएस सॉफ्टवेयर उपयोगकर्ता को जुर्माना पूर्व निर्धारित करने की अनुमति देता है)।

ध्यान दें कि

- (मंगल पदों की संख्या − 1 ) / 2

हिंज-फ़ंक्शन गांठों की संख्या है, इसलिए सूत्र गांठों को जोड़ने पर जुर्माना लगाता है। इस प्रकार जीसीवी फॉर्मूला मॉडल के लचीलेपन को ध्यान में रखते हुए प्रशिक्षण आरएसएस को समायोजित (यानी बढ़ाता है) करता है। हम लचीलेपन को दंडित करते हैं क्योंकि जो मॉडल बहुत लचीले हैं वे डेटा की व्यवस्थित संरचना के बजाय डेटा में शोर के विशिष्ट अहसास को मॉडल करेंगे।

सामान्यीकृत क्रॉस-सत्यापन को यह नाम दिया गया है क्योंकि यह त्रुटि का अनुमान लगाने के लिए सूत्र का उपयोग करता है जिसे लीव-वन-आउट सत्यापन द्वारा निर्धारित किया जाएगा। यह सिर्फ अनुमान है लेकिन व्यवहार में अच्छा काम करता है। जीसीवी को क्रेवेन और ग्रेस वाहबा द्वारा पेश किया गया था और फ्रीडमैन द्वारा MARS के लिए विस्तारित किया गया था।

बाधाएँ

बाधा का पहले ही उल्लेख किया जा चुका है: उपयोगकर्ता फॉरवर्ड पास में शब्दों की अधिकतम संख्या निर्दिष्ट कर सकता है।

फॉरवर्ड पास पर और बाधा लगाई जा सकती है बातचीत की अधिकतम स्वीकार्य डिग्री निर्दिष्ट करके। आम तौर पर केवल या दो डिग्री की बातचीत की अनुमति होती है, लेकिन उच्च डिग्री का उपयोग तब किया जा सकता है जब डेटा इसकी गारंटी देता है। पहले MARS उदाहरण में अंतःक्रिया की अधिकतम डिग्री उपरोक्त है (अर्थात् कोई इंटरैक्शन या कोई योगात्मक मॉडल नहीं); ओजोन उदाहरण में यह दो है।

फॉरवर्ड पास पर अन्य बाधाएँ संभव हैं। उदाहरण के लिए, उपयोगकर्ता निर्दिष्ट कर सकता है कि इंटरैक्शन की अनुमति है केवल कुछ इनपुट वेरिएबल के लिए। ज्ञान के कारण ऐसी बाधाएँ समझ में आ सकती हैं उस प्रक्रिया का जिसने डेटा उत्पन्न किया।

पक्ष और विपक्ष

कोई भी प्रतिगमन मॉडलिंग तकनीक सभी स्थितियों के लिए सर्वोत्तम नहीं है। नीचे दिए गए दिशानिर्देशों का उद्देश्य मंगल ग्रह के फायदे और नुकसान का विचार देना है। लेकिन दिशानिर्देशों के अपवाद होंगे। मंगल की तुलना पुनरावर्ती विभाजन से करना उपयोगी है और यह नीचे किया गया है। (पुनरावर्ती विभाजन को सामान्यतः प्रतिगमन वृक्ष भी कहा जाता है, निर्णय वृक्ष, या पूर्वानुमानित विश्लेषण#वर्गीकरण और प्रतिगमन वृक्ष; विवरण के लिए निर्णय वृक्ष सीखना लेख देखें)।

- MARS मॉडल रैखिक प्रतिगमन मॉडल की तुलना में अधिक लचीले होते हैं।

- MARS मॉडल समझने और व्याख्या करने में सरल हैं।[5] उपरोक्त ओजोन सांद्रता के समीकरण की तुलना, मान लीजिए, प्रशिक्षित कृत्रिम तंत्रिका नेटवर्क या यादृच्छिक जंगल के अंदरूनी हिस्सों से करें।

- MARS निरंतर और श्रेणीबद्ध डेटा दोनों को संभाल सकता है।[6][7] MARS संख्यात्मक डेटा के लिए पुनरावर्ती विभाजन से बेहतर होता है क्योंकि पुनरावर्ती विभाजन द्वारा उपयोग किए जाने वाले टुकड़े-टुकड़े निरंतर विभाजन की तुलना में संख्यात्मक चर के लिए टिका अधिक उपयुक्त होती है।

- MARS मॉडल के निर्माण के लिए अक्सर बहुत कम या कोई डेटा तैयारी की आवश्यकता नहीं होती है।[5]हिंज फ़ंक्शन स्वचालित रूप से इनपुट डेटा को विभाजित करता है, इसलिए आउटलेर्स का प्रभाव निहित होता है। इस संबंध में MARS पुनरावर्ती विभाजन के समान है जो डेटा को असंयुक्त क्षेत्रों में भी विभाजित करता है, हालांकि अलग विधि का उपयोग करता है। (फिर भी, अधिकांश सांख्यिकीय मॉडलिंग तकनीकों की तरह, MARS मॉडल को प्रशिक्षित करने से पहले ज्ञात आउटलेर्स को हटाने पर विचार किया जाना चाहिए।[citation needed])

- MARS (पुनरावर्ती विभाजन की तरह) स्वचालित फ़ीचर चयन करता है (जिसका अर्थ है कि यह मॉडल में महत्वपूर्ण चर शामिल करता है और महत्वहीन को बाहर कर देता है)। हालाँकि, चयन में कुछ मनमानी हो सकती है, खासकर जब सहसंबद्ध भविष्यवक्ता हों, और यह व्याख्या को प्रभावित कर सकता है[5]*MARS मॉडल में पूर्वाग्रह-विचरण का अच्छा समझौता होता है। मॉडल गैर-रैखिकता और परिवर्तनीय इंटरैक्शन को मॉडल करने के लिए पर्याप्त लचीले हैं (इस प्रकार MARS मॉडल में काफी कम पूर्वाग्रह है), फिर भी MARS आधार कार्यों का बाधित रूप बहुत अधिक लचीलेपन को रोकता है (इस प्रकार MARS मॉडल में काफी कम भिन्नता होती है)।

- MARS काफी बड़े डेटासेट को संभालने के लिए उपयुक्त है। 100 भविष्यवक्ताओं और 10 के साथ इनपुट मैट्रिक्स से MARS मॉडल बनाना नियमित मामला है5अवलोकन. ऐसा मॉडल 1 गीगाहर्ट्ज मशीन पर लगभग मिनट में बनाया जा सकता है, यह मानते हुए कि MARS शब्दों की परस्पर क्रिया की अधिकतम डिग्री तक सीमित है (यानी केवल योगात्मक शब्द)। समान 1 गीगाहर्ट्ज़ मशीन पर समान डेटा वाले डिग्री दो मॉडल को अधिक समय लगता है - लगभग 12 मिनट। ध्यान रखें कि यह समय अत्यधिक डेटा पर निर्भर है। पुनरावर्ती विभाजन MARS की तुलना में बहुत तेज़ है।[citation needed]

- MARS मॉडल के साथ, किसी भी गैर-पैरामीट्रिक प्रतिगमन की तरह, पैरामीटर आत्मविश्वास अंतराल और मॉडल पर अन्य जांचों की गणना सीधे नहीं की जा सकती (रैखिक प्रतिगमन मॉडल के विपरीत)। क्रॉस-वैलिडेशन (सांख्यिकी)|इसके बजाय मॉडल को मान्य करने के लिए क्रॉस-वैलिडेशन और संबंधित तकनीकों का उपयोग किया जाना चाहिए।

- MARS मॉडल बूस्टिंग (मेटा-एल्गोरिदम) पेड़ों के समान अच्छे फिट नहीं देते हैं, लेकिन इन्हें अधिक तेज़ी से बनाया जा सकता है और ये अधिक व्याख्या योग्य हैं। ( 'व्याख्यात्मक' मॉडल ऐसे रूप में है जो यह स्पष्ट करता है कि प्रत्येक भविष्यवक्ता का प्रभाव क्या है।)

earthका>,mda, औरpolsplineकार्यान्वयन भविष्यवक्ताओं में लापता मूल्यों की अनुमति नहीं देता है, लेकिन प्रतिगमन पेड़ों (जैसे) के मुफ्त कार्यान्वयन की अनुमति देता हैrpartऔरparty) सरोगेट स्प्लिट्स नामक तकनीक का उपयोग करके लापता मानों की अनुमति दें।- MARS मॉडल शीघ्रता से भविष्यवाणियां कर सकते हैं। भविष्यवाणी फ़ंक्शन को बस MARS मॉडल सूत्र का मूल्यांकन करना है। इसकी तुलना समर्थन वेक्टर यंत्र के साथ भविष्यवाणी करने से करें, जहां प्रत्येक वेरिएबल को प्रत्येक सपोर्ट वेक्टर के संबंधित तत्व से गुणा करना होता है। यदि कई चर और कई समर्थन वैक्टर हैं तो यह धीमी प्रक्रिया हो सकती है।

- परिणामस्वरूप फिट किया गया फ़ंक्शन सुचारू नहीं है (टिका के साथ अलग-अलग नहीं)।

विस्तार और संबंधित अवधारणाएँ

- सामान्यीकृत रैखिक मॉडल (जीएलएम) को MARS मॉडल के निर्माण के बाद लिंक फ़ंक्शन लागू करके MARS मॉडल में शामिल किया जा सकता है। इस प्रकार, उदाहरण के लिए, MARS मॉडल संभावनाओं की भविष्यवाणी करने के लिए संभार तन्त्र परावर्तन को शामिल कर सकते हैं।

- अरेखीय प्रतिगमन|नॉन-लीनियर रिग्रेशन का उपयोग तब किया जाता है जब फ़ंक्शन का अंतर्निहित रूप ज्ञात होता है और रिग्रेशन का उपयोग केवल उस फ़ंक्शन के मापदंडों का अनुमान लगाने के लिए किया जाता है। दूसरी ओर, मंगल स्वयं कार्यों का अनुमान लगाता है, यद्यपि कार्यों की प्रकृति पर गंभीर बाधाएं होती हैं। (ये बाधाएँ आवश्यक हैं क्योंकि डेटा से मॉडल की खोज करना विपरीत समस्या है जो मॉडल पर बाधाओं के बिना अच्छी तरह से प्रस्तुत समस्या नहीं है।)

- पुनरावर्ती विभाजन (आमतौर पर कार्ट कहा जाता है)। MARS को पुनरावर्ती विभाजन के सामान्यीकरण के रूप में देखा जा सकता है जो मॉडल को संख्यात्मक (यानी गैर-श्रेणीबद्ध) डेटा को बेहतर ढंग से संभालने की अनुमति देता है।

- सामान्यीकृत योगात्मक मॉडल। उपयोगकर्ता के नजरिए से GAM, MARS के समान हैं, लेकिन (ए) MARS आधार कार्यों के बजाय सुचारू स्थानीय प्रतिगमन या बहुपद स्पलाइन (गणित) में फिट होते हैं, और (बी) स्वचालित रूप से परिवर्तनीय इंटरैक्शन को मॉडल नहीं करते हैं। GAMs द्वारा आंतरिक रूप से उपयोग की जाने वाली फिटिंग विधि MARS से बहुत अलग है। ऐसे मॉडलों के लिए जिन्हें परिवर्तनीय इंटरैक्शन की स्वचालित खोज की आवश्यकता नहीं होती है, GAMs अक्सर MARS के साथ अनुकूल प्रतिस्पर्धा करते हैं।

- टीएसएमएआरएस। टाइम सीरीज़ मार्स वह शब्द है जिसका उपयोग तब किया जाता है जब MARS मॉडल को टाइम सीरीज़ संदर्भ में लागू किया जाता है। आमतौर पर इस सेट अप में भविष्यवक्ता विलंबित समय श्रृंखला मान होते हैं जिसके परिणामस्वरूप ऑटोरेग्रेसिव स्पलाइन मॉडल होते हैं। मूविंग एवरेज स्पलाइन मॉडल को शामिल करने के लिए इन मॉडलों और ्सटेंशनों को टीएसएमएआरएस का उपयोग करके यूनीवेरिएट टाइम सीरीज़ मॉडलिंग और पूर्वानुमान में वर्णित किया गया है: टीएसएमएआरएस का उपयोग करके थ्रेशोल्ड टाइम सीरीज़ ऑटोरेग्रेसिव, मौसमी और मूविंग औसत मॉडल का अध्ययन।

- बायेसियन मंगल (बीएमएआरएस) ही मॉडल फॉर्म का उपयोग करता है, लेकिन बायेसियन दृष्टिकोण का उपयोग करके मॉडल बनाता है। यह विभिन्न इष्टतम MARS मॉडल पर पहुंच सकता है क्योंकि मॉडल निर्माण का दृष्टिकोण अलग है। BMARS का परिणाम आम तौर पर MARS मॉडल के पिछले नमूनों का समूह होता है, जो संभाव्य भविष्यवाणी की अनुमति देता है।[8]

यह भी देखें

- रेखीय प्रतिगमन

- स्थानीय प्रतिगमन

- तर्कसंगत कार्य मॉडलिंग

- खंडित प्रतिगमन

- तख़्ता प्रक्षेप

- तख़्ता प्रतिगमन

संदर्भ

- ↑ Friedman, J. H. (1991). "बहुभिन्नरूपी अनुकूली प्रतिगमन स्प्लिंस". The Annals of Statistics. 19 (1): 1–67. CiteSeerX 10.1.1.382.970. doi:10.1214/aos/1176347963. JSTOR 2241837. MR 1091842. Zbl 0765.62064.

- ↑ CRAN Package earth

- ↑ Earth – Multivariate adaptive regression splines in Orange (Python machine learning library)

- ↑ Friedman, J. H. (1993) Fast MARS, Stanford University Department of Statistics, Technical Report 110

- ↑ 5.0 5.1 5.2 Kuhn, Max; Johnson, Kjell (2013). एप्लाइड प्रेडिक्टिव मॉडलिंग (in English). New York, NY: Springer New York. doi:10.1007/978-1-4614-6849-3. ISBN 9781461468486.

- ↑ Friedman, Jerome H. (1993). "Estimating Functions of Mixed Ordinal and Categorical Variables Using Adaptive Splines". In Stephan Morgenthaler; Elvezio Ronchetti; Werner Stahel (eds.). सांख्यिकीय डेटा विश्लेषण और मजबूती में नई दिशाएँ. Birkhauser.

- ↑ Friedman, Jerome H. (1991-06-01). "अनुकूली स्प्लाइन का उपयोग करके मिश्रित क्रमसूचक और श्रेणीबद्ध चर के कार्यों का अनुमान लगाना". DTIC. Archived from the original on April 11, 2022. Retrieved 2022-04-11.

- ↑ Denison, D. G. T.; Mallick, B. K.; Smith, A. F. M. (1 December 1998). "बायेसियन मंगल" (PDF). Statistics and Computing (in English). 8 (4): 337–346. doi:10.1023/A:1008824606259. ISSN 1573-1375. S2CID 12570055.

अग्रिम पठन

- Hastie T., Tibshirani R., and Friedman J.H. (2009) The Elements of Statistical Learning, 2nd edition. Springer, ISBN 978-0-387-84857-0 (has a section on MARS)

- Faraway J. (2005) Extending the Linear Model with R, CRC, ISBN 978-1-58488-424-8 (has an example using MARS with R)

- Heping Zhang and Burton H. Singer (2010) Recursive Partitioning and Applications, 2nd edition. Springer, ISBN 978-1-4419-6823-4 (has a chapter on MARS and discusses some tweaks to the algorithm)

- Denison D.G.T., Holmes C.C., Mallick B.K., and Smith A.F.M. (2004) Bayesian Methods for Nonlinear Classification and Regression, Wiley, ISBN 978-0-471-49036-4

- Berk R.A. (2008) Statistical learning from a regression perspective, Springer, ISBN 978-0-387-77500-5

बाहरी संबंध

Several free and commercial software packages are available for fitting MARS-type models.

- Free software

- R packages:

- Matlab code:

- ARESLab: Adaptive Regression Splines toolbox for Matlab

- Code from the book Bayesian Methods for Nonlinear Classification and Regression[1] for Bayesian MARS.

- Python

- Earth – Multivariate adaptive regression splines

- py-earth

- pyBASS for Bayesian MARS.

- Commercial software

- MARS from Salford Systems. Based on Friedman's implementation.

- STATISTICA Data Miner from StatSoft

- ADAPTIVEREG from SAS.

- ↑ Denison, D. G. T.; Holmes, C. C.; Mallick, B. K.; Smith, A. F. M. (2002). Bayesian methods for nonlinear classification and regression. Chichester, England: Wiley. ISBN 978-0-471-49036-4.