मिश्रण मॉडल: Difference between revisions

No edit summary |

No edit summary |

||

| (3 intermediate revisions by 3 users not shown) | |||

| Line 3: | Line 3: | ||

{{See also|मिश्रण वितरण}} | {{See also|मिश्रण वितरण}} | ||

आँकड़ों में, '''मिश्रण मॉडल''' | आँकड़ों में, '''मिश्रण मॉडल''' समस्त जनसंख्या मे [[उप-जनसंख्या]] की उपस्थिति का प्रतिनिधित्व करने के लिए [[संभाव्य मॉडल|प्रायिकतात्मक मॉडल]] है किसी देखे गए आंकड़ा मे उप-जनसंख्या की पहचान करने की अवश्यकता होती है जिसमें एक व्यक्तिगत अवलोकन होता है। औपचारिक रूप से एक मिश्रण मॉडल [[मिश्रण वितरण]] के अनुरूप होता है जो समग्र जनसंख्या में टिप्पणियों के प्रायिकतात्मक वितरण का प्रतिनिधित्व करता है। हालांकि, "मिश्रण वितरण" से संबद्ध समस्याएं उप-जनसंख्या के गुणों से समग्र जनसंख्या के गुणों को प्राप्त करने से संबंधित हैं मिश्रण मॉडल का उपयोग उप-जनसंख्या के गुणों के विषय में सांख्यिकीय अनुमान लगाने के लिए किया जाता है, जो केवल टिप्पणियों पर दिया जाता है। जनसंख्या, उप-जनसंख्या पहचान जानकारी के अतिरिक्त मिश्रण मॉडल को संरचनागत आंकड़ा के मॉडल के साथ भ्रमित नहीं होना चाहिए। अर्थात, आंकड़ा जिसके घटक एक स्थिर मान (1, 100%, आदि) के योग के लिए विवश हैं। हालाँकि, संरचनागत मॉडल को मिश्रण मॉडल के रूप में माना जा सकता है जहाँ जनसंख्या के सदस्यों का यादृच्छिक रूप से प्रतिरूप लिया जाता है। इसके विपरीत, मिश्रण मॉडल को रचनात्मक मॉडल के रूप में माना जा सकता है, जहां कुल आकार पढ़ने वाली जनसंख्या को सामान्य कर दिया गया है। | ||

== संरचना == | == संरचना == | ||

| Line 63: | Line 63: | ||

==== गाऊसी मिश्रण मॉडल ==== | ==== गाऊसी मिश्रण मॉडल ==== | ||

[[File:nonbayesian-gaussian-mixture.svg|right|250px|thumb|प्लेट संकेतन का उपयोग करते हुए गैर-बायेसियन गॉसियन मिश्रण | [[File:nonbayesian-gaussian-mixture.svg|right|250px|thumb|प्लेट संकेतन का उपयोग करते हुए गैर-बायेसियन गॉसियन मिश्रण मॉडल छोटे वर्ग निश्चित पैरामीटर को दर्शाते हैं और बड़े वृत्त यादृच्छिक चर दर्शाते हैं। भरी हुई आकृतियाँ ज्ञात मानों को दर्शाती हैं। संकेत [K] का अर्थ K आकार का एक सदिश है।]]एक विशिष्ट गैर-बायेसियन गाऊसी वितरण मिश्रण मॉडल इस प्रकार है: | ||

:<math> | :<math> | ||

| Line 77: | Line 77: | ||

\end{array} | \end{array} | ||

</math> | </math> | ||

[[File:bayesian-gaussian-mixture.svg|right|300px|thumb|प्लेट | [[File:bayesian-gaussian-mixture.svg|right|300px|thumb|प्लेट संकेत का उपयोग करते हुए बायेसियन गाऊसी मिश्रण मॉडल छोटे वर्ग निश्चित पैरामीटर दर्शाते हैं बड़े वृत्त यादृच्छिक चर दर्शाते हैं। भरी हुई आकृतियाँ ज्ञात मानों को दर्शाती हैं। संकेत [K] का अर्थ K आकार का एक सदिश है।]]गाऊसी वितरण मिश्रण मॉडल का बायेसियन संस्करण इस प्रकार है: | ||

:<math> | :<math> | ||

| Line 95: | Line 95: | ||

\end{array} | \end{array} | ||

</math><math></math> | </math><math></math> | ||

[[File:Parameter estimation process infinite Gaussian mixture model.webm|thumb|बायेसियन गॉसियन मिश्रण मॉडल का उपयोग करके एक-आयामी आंकड़ा के लिए क्लस्टरिंग प्रक्रिया | [[File:Parameter estimation process infinite Gaussian mixture model.webm|thumb|बायेसियन गॉसियन मिश्रण मॉडल का उपयोग करके एक-आयामी आंकड़ा के लिए क्लस्टरिंग प्रक्रिया की सजीवता जहां सामान्य वितरण एक [[डिरिचलेट प्रक्रिया]] से तैयार किए जाते हैं। समूहों के हिस्टोग्राम को विभिन्न रंगों में दिखाया गया है। पैरामीटर आकलन प्रक्रिया के समय नए क्लस्टर बनाए जाते हैं और आंकड़ा पर बढ़ते हैं। किंवदंती क्लस्टर रंग और प्रत्येक क्लस्टर को निर्दिष्ट आंकड़ा बिन्दु की संख्या को दर्शाती है।]] | ||

==== बहुचर गाऊसी मिश्रण मॉडल ==== | ==== बहुचर गाऊसी मिश्रण मॉडल ==== | ||

| Line 120: | Line 120: | ||

==== श्रेणीबद्ध मिश्रण मॉडल ==== | ==== श्रेणीबद्ध मिश्रण मॉडल ==== | ||

[[File:nonbayesian-categorical-mixture.svg|right|250px|thumb|प्लेट | [[File:nonbayesian-categorical-mixture.svg|right|250px|thumb|प्लेट संकेत का उपयोग करते हुए गैर-बायेसियन श्रेणीबद्ध मिश्रण मॉडल छोटे वर्ग निश्चित पैरामीटर को दर्शाते हैं और बड़े वृत्त यादृच्छिक चर दर्शाते हैं। भरी हुई आकृतियाँ ज्ञात मानों को दर्शाती हैं। संकेत [के] का अर्थ है आकार के सदिश इसी प्रकार [वी] के लिए।]]श्रेणीबद्ध वितरण टिप्पणियों वाला एक विशिष्ट गैर-बायेसियन मिश्रण मॉडल इस प्रकार है: | ||

*<math>K,N:</math> ऊपरोक्त के अनुसार | *<math>K,N:</math> ऊपरोक्त के अनुसार | ||

*<math>\phi_{i=1 \dots K}, \boldsymbol\phi:</math> ऊपरोक्त के अनुसार | *<math>\phi_{i=1 \dots K}, \boldsymbol\phi:</math> ऊपरोक्त के अनुसार | ||

*<math>z_{i=1 \dots N}, x_{i=1 \dots N}:</math> ऊपरोक्त के अनुसार | *<math>z_{i=1 \dots N}, x_{i=1 \dots N}:</math> ऊपरोक्त के अनुसार | ||

*<math>V:</math> श्रेणीबद्ध टिप्पणियों का आयाम, उदाहरण के लिए, शब्द शब्दावली का आकार | *<math>V:</math> श्रेणीबद्ध टिप्पणियों का आयाम, उदाहरण के लिए, शब्द और शब्दावली का आकार | ||

*<math>\theta_{i=1 \dots K, j=1 \dots V}:</math> <math>j</math> घटक <math>j</math> अवलोकन के घटक <math>i</math> की प्रायिकता | *<math>\theta_{i=1 \dots K, j=1 \dots V}:</math> <math>j</math> घटक <math>j</math> अवलोकन के घटक <math>i</math> की प्रायिकता | ||

*<math>\boldsymbol\theta_{i=1 \dots K}:</math> आयाम का सदिश <math>V,</math> की रचना <math>\theta_{i,1 \dots V};</math> योग 1 होना चाहिए | *<math>\boldsymbol\theta_{i=1 \dots K}:</math> आयाम का सदिश <math>V,</math> की रचना <math>\theta_{i,1 \dots V};</math> योग 1 होना चाहिए | ||

| Line 136: | Line 136: | ||

\end{array} | \end{array} | ||

</math> | </math> | ||

[[File:bayesian-categorical-mixture.svg|right|300px|thumb|प्लेट | [[File:bayesian-categorical-mixture.svg|right|300px|thumb|प्लेट संकेत का उपयोग करते हुए बायेसियन श्रेणीबद्ध मिश्रण मॉडल। छोटे वर्ग निश्चित पैरामीटर दर्शाते हैं; बड़े वृत्त यादृच्छिक चर दर्शाते हैं। भरी हुई आकृतियाँ ज्ञात मानों को दर्शाती हैं। संकेत [के] का अर्थ है आकार के सदि; इसी प्रकार [वी] के लिए।]]विशिष्ट वितरण टिप्पणियों वाला एक विशिष्ट बायेसियन मिश्रण मॉडल इस प्रकार है: | ||

*<math>K,N:</math> ऊपरोक्त के अनुसार | *<math>K,N:</math> ऊपरोक्त के अनुसार | ||

| Line 144: | Line 144: | ||

*<math>\theta_{i=1 \dots K, j=1 \dots V}:</math> घटक <math>j</math> अवलोकन के घटक <math>i</math> की प्रायिकता | *<math>\theta_{i=1 \dots K, j=1 \dots V}:</math> घटक <math>j</math> अवलोकन के घटक <math>i</math> की प्रायिकता | ||

*<math>\boldsymbol\theta_{i=1 \dots K}:</math> आयाम <math>V,</math> का सदिश <math>\theta_{i,1 \dots V};</math> की रचना है जिसका योग 1 होना चाहिए। | *<math>\boldsymbol\theta_{i=1 \dots K}:</math> आयाम <math>V,</math> का सदिश <math>\theta_{i,1 \dots V};</math> की रचना है जिसका योग 1 होना चाहिए। | ||

*<math>\alpha:</math> प्रत्येक घटक के लिए <math>\boldsymbol\theta</math> का साझा एकाग्रता | *<math>\alpha:</math> प्रत्येक घटक के लिए <math>\boldsymbol\theta</math> का साझा एकाग्रता हाइपर पैरामीटर | ||

*<math>\beta:</math> <math>\boldsymbol\phi</math> की सघनता | *<math>\beta:</math> <math>\boldsymbol\phi</math> की सघनता हाइपर पैरामीटर | ||

यादृच्छिक चर: | यादृच्छिक चर: | ||

:<math> | :<math> | ||

| Line 158: | Line 158: | ||

=== एक वित्तीय मॉडल === | === एक वित्तीय मॉडल === | ||

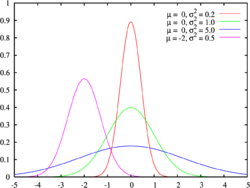

[[File:Normal distribution pdf.png|thumb|right|250px|सामान्य वितरण को विभिन्न माध्यमों और भिन्नताओं का उपयोग करके प्लॉट किया जाता | [[File:Normal distribution pdf.png|thumb|right|250px|सामान्य वितरण को विभिन्न माध्यमों और भिन्नताओं का उपयोग करके प्लॉट किया जाता है। ]]वित्तीय वापसी प्रायः सामान्य परिस्थितियों में और संकट के समय में अलग प्रकार व्यवहार करते हैं। वापसी आंकड़ा के लिए एक मिश्रण मॉडल उपयुक्त प्रतीत होता है।<ref>Dinov, ID. "[http://repositories.cdlib.org/socr/EM_MM/ Expectation Maximization and Mixture Modeling Tutorial]". ''[http://repositories.cdlib.org/escholarship California Digital Library]'', Statistics Online Computational Resource, Paper EM_MM, http://repositories.cdlib.org/socr/EM_MM, December 9, 2008</ref> कभी-कभी उपयोग किया जाने वाला मॉडल एक कूद-प्रसार मॉडल होता है या दो सामान्य वितरणों के मिश्रण के रूप में होता है। आगे के संदर्भ के लिए {{slink|वित्तीय अर्थशास्त्र#चुनौतियां और आलोचना}} और {{slink|वित्तीय जोखिम प्रबंधन # बैंकिंग}} देखें। | ||

=== घर की कीमत === | === घर की कीमत === | ||

मान लें कि हम N विभिन्न घरों की कीमतों का निरीक्षण करते हैं। अलग-अलग क्षेत्र में अलग-अलग प्रकार के घरों की कीमतें अपेक्षाकृत अलग होंगी, लेकिन किसी विशेष निकट क्षेत्र में एक विशेष प्रकार के घर की कीमत (उदाहरण के लिए, मध्यम उच्च स्तर के पास में तीन-बेडरूम का घर) औसत के आसपास अपेक्षाकृत सूक्ष्मता से निरक्षण करता है ऐसी कीमतों का एक संभावित मॉडल यह मानना होगा कि कीमतों को मिश्रण मॉडल द्वारा के विभिन्न घटकों के साथ शुद्ध रूप से वर्णित किया गया है, प्रत्येक अज्ञात माध्य और भिन्नता के साथ सामान्य वितरण के रूप में वितरित किया गया है, प्रत्येक घटक घर के प्रकार/पड़ोस के विशेष संयोजन को निर्दिष्ट करता है। इस मॉडल को देखी गई कीमतों के लिए प्रयुक्त करना, उदाहरण के लिए, अपेक्षा-अधिकतमकरण | मान लें कि हम N विभिन्न घरों की कीमतों का निरीक्षण करते हैं। अलग-अलग क्षेत्र में अलग-अलग प्रकार के घरों की कीमतें अपेक्षाकृत अलग होंगी, लेकिन किसी विशेष निकट क्षेत्र में एक विशेष प्रकार के घर की कीमत (उदाहरण के लिए, मध्यम उच्च स्तर के पास में तीन-बेडरूम का घर) औसत के आसपास अपेक्षाकृत सूक्ष्मता से निरक्षण करता है ऐसी कीमतों का एक संभावित मॉडल यह मानना होगा कि कीमतों को मिश्रण मॉडल द्वारा के विभिन्न घटकों के साथ शुद्ध रूप से वर्णित किया गया है, प्रत्येक अज्ञात माध्य और भिन्नता के साथ सामान्य वितरण के रूप में वितरित किया गया है, प्रत्येक घटक घर के प्रकार/पड़ोस के विशेष संयोजन को निर्दिष्ट करता है। इस मॉडल को देखी गई कीमतों के लिए प्रयुक्त करना, उदाहरण के लिए, अपेक्षा-अधिकतमकरण कलनविधि का उपयोग करके, घर के प्रकार के अनुसार कीमतों को क्लस्टर करना होगा और प्रत्येक प्रकार में कीमतों के विस्तार को प्रकट करना होगा। ध्यान दें कि कीमतों या आय जैसे मानों के लिए जो धनात्मक होने के लिए उत्तरदायी है और जो तीव्रता से बढ़ने लगते हैं, लघुगणक सामान्य वितरण मान वास्तव में सामान्य वितरण से अपेक्षाकृत अच्छे मॉडल हो सकते है। | ||

=== दस्तावेज़ में विषय === | === दस्तावेज़ में विषय === | ||

| Line 245: | Line 245: | ||

| doi = 10.1007/978-3-030-00937-3_14 | | doi = 10.1007/978-3-030-00937-3_14 | ||

}} | }} | ||

</ref> उदाहरण के लिए छात्र के टी-वितरण और वाटसन वितरण / बिंगहैम वितरण को मॉडल मुख्य स्थिति और अक्ष निर्देशन से अलग करना सीपीडी और टीएमएम की तुलना में अंतर्निहित, शुद्धता के संदर्भ में | </ref> उदाहरण के लिए छात्र के टी-वितरण और वाटसन वितरण / बिंगहैम वितरण को मॉडल मुख्य स्थिति और अक्ष निर्देशन से अलग करना सीपीडी और टीएमएम की तुलना में अंतर्निहित, शुद्धता के संदर्भ में भेदभावपूर्ण क्षमता है। | ||

== पहचान योग्यता == | == पहचान योग्यता == | ||

| Line 273: | Line 273: | ||

प्रायिकतात्मक मिश्रण मॉडलिंग को गुप्त आंकड़ा समस्या के रूप में सोचना सामान्य है। इसे समझने का एक तरीका यह मान लेना है कि जिन आंकड़ा बिंदुओं पर विचार किया जा रहा है, उनमें से किसी एक वितरण में सदस्यता है जिसका उपयोग हम आंकड़ा को मॉडल करने के लिए कर रहे हैं। जब हम प्रारम्भ करते हैं, तो यह सदस्यता अज्ञात होती है या लुप्त होती है। अनुमान का कार्य हमारे द्वारा चयन किए गए मॉडल कार्यों के लिए उपयुक्त पैरामीटर तैयार करना है, आंकड़ा बिंदुओं के संबंध के साथ व्यक्तिगत मॉडल वितरण में उनकी सदस्यता के रूप में प्रतिनिधित्व किया जा रहा है। | प्रायिकतात्मक मिश्रण मॉडलिंग को गुप्त आंकड़ा समस्या के रूप में सोचना सामान्य है। इसे समझने का एक तरीका यह मान लेना है कि जिन आंकड़ा बिंदुओं पर विचार किया जा रहा है, उनमें से किसी एक वितरण में सदस्यता है जिसका उपयोग हम आंकड़ा को मॉडल करने के लिए कर रहे हैं। जब हम प्रारम्भ करते हैं, तो यह सदस्यता अज्ञात होती है या लुप्त होती है। अनुमान का कार्य हमारे द्वारा चयन किए गए मॉडल कार्यों के लिए उपयुक्त पैरामीटर तैयार करना है, आंकड़ा बिंदुओं के संबंध के साथ व्यक्तिगत मॉडल वितरण में उनकी सदस्यता के रूप में प्रतिनिधित्व किया जा रहा है। | ||

मिश्रण अपघटन की समस्या के लिए कई प्रकार के दृष्टिकोण प्रस्तावित किए गए हैं, जिनमें से कई अधिकतम संभावना विधियों पर ध्यान केंद्रित हैं जैसे कि अपेक्षा अधिकतमकरण (ईएम) या अधिकतम पश्च अनुमान (एमएपी) सामान्यतः ये विधियां प्रणाली पहचान और पैरामीटर अनुमान के प्रश्नों पर अलग से विचार करती हैं मिश्रण के भीतर घटकों की संख्या और कार्यात्मक रूप निर्धारित करने के तरीकों को संबंधित पैरामीटर मानों का अनुमान लगाने के तरीकों से अलग किया जाता है। कुछ उल्लेखनीय विचलन टार्टर और लॉक<ref name="Jain">{{cite journal |first1=M.A.T. |last1=Figueiredo |first2=A.K. |last2=Jain |title=परिमित मिश्रण मॉडल की अनपर्यवेक्षित शिक्षा|journal=IEEE Transactions on Pattern Analysis and Machine Intelligence |volume=24 |issue=3 |pages=381–396 |date=March 2002 |doi=10.1109/34.990138 |citeseerx=10.1.1.362.9811 }}</ref> और हाल ही में न्यूनतम संदेश लंबाई (एमएमएल) तकनीकों जैसे कि फिगुएरेडो और जैन<ref name="tart">{{citation | |||

|title=Model Free Curve Estimation | |title=Model Free Curve Estimation | ||

|first=Michael E. |last=Tarter | |first=Michael E. |last=Tarter | ||

|date=1993 | |date=1993 | ||

|publisher=Chapman and Hall | |publisher=Chapman and Hall | ||

}}</ref> और कुछ अन्य मैकविलियम और लोह (2009) द्वारा अनुरूप पैटर्न विश्लेषण दिनचर्या में उल्लिखित ग्राफिकल विधियां हैं।<ref name="mcwilli"> | |||

{{citation | {{citation | ||

|title=Incorporating Multidimensional Tail-Dependencies in the Valuation of Credit Derivatives (Working Paper) | |title=Incorporating Multidimensional Tail-Dependencies in the Valuation of Credit Derivatives (Working Paper) | ||

| Line 285: | Line 285: | ||

}} [http://www.misys.com/cds-portlets/digitalAssets/4/2797_CDsAndTailDep_forPublication_final1.pdf]</ref> | }} [http://www.misys.com/cds-portlets/digitalAssets/4/2797_CDsAndTailDep_forPublication_final1.pdf]</ref> | ||

=== अपेक्षा अधिकतमकरण (ईएम) === | === अपेक्षा अधिकतमकरण (ईएम) === | ||

अपेक्षा अधिकतमकरण ( | अपेक्षा अधिकतमकरण (ईएम) प्रतीत होता है कि सबसे लोकप्रिय तकनीक है जिसका उपयोग किसी प्राथमिकता वाले घटकों की संख्या के साथ मिश्रण के मापदंडों को निर्धारित करने के लिए किया जाता है। यह इस समस्या के लिए अधिकतम संभावना अनुमान प्रयुक्त करने का एक विशेष प्रकार है। ईएम परिमित सामान्य मिश्रणों के लिए विशेष रूप से अपील करता है जहां विवृत रूप मे अभिव्यक्तियां संभव हैं जैसे डेम्पस्टर पद्धति द्वारा निम्नलिखित पुनरावृत्त कलनविधि में निम्न अभिव्यक्तियां संभव हैं:<ref name="dempster1977">{{cite journal |first1=A.P. |last1=Dempster |first2=N.M. |last2=Laird |first3=D.B. |last3=Rubin |title=ईएम एलगोरिद्म द्वारा आंशिक डेटा से अधिकतम संभावना है|journal=Journal of the Royal Statistical Society, Series B |volume=39 |issue=1 |pages=1–38 | date = 1977 |jstor=2984875 |citeseerx = 10.1.1.163.7580 }} | ||

</ref> | </ref> | ||

:<math> w_s^{(j+1)} = \frac{1}{N} \sum_{t =1}^N h_s^{(j)}(t) </math> | :<math> w_s^{(j+1)} = \frac{1}{N} \sum_{t =1}^N h_s^{(j)}(t) </math> | ||

| Line 292: | Line 292: | ||

पश्च संभावनाओं के साथ | पश्च संभावनाओं के साथ | ||

:<math> h_s^{(j)}(t) = \frac{w_s^{(j)} p_s(x^{(t)}; \mu_s^{(j)},\Sigma_s^{(j)}) }{ \sum_{i = 1}^n w_i^{(j)} p_i(x^{(t)}; \mu_i^{(j)}, \Sigma_i^{(j)})}. </math> | :<math> h_s^{(j)}(t) = \frac{w_s^{(j)} p_s(x^{(t)}; \mu_s^{(j)},\Sigma_s^{(j)}) }{ \sum_{i = 1}^n w_i^{(j)} p_i(x^{(t)}; \mu_i^{(j)}, \Sigma_i^{(j)})}. </math> | ||

इस प्रकार | इस प्रकार मापदंडों के लिए वर्तमान अनुमान के आधार पर स्थिति s से उत्पन्न होने वाले किसी दिए गए अवलोकन x<sup>(t)</sup> के लिए सशर्त संभावना प्रत्येक t = 1, …, N के लिए निर्धारित की जाती है N प्रतिरूप आकार है। मापदंडों को तब अद्यतन किया जाता है जैसे कि नए घटक भार औसत सशर्त संभाव्यता के अनुरूप होते हैं और प्रत्येक घटक माध्य और सहप्रसरण प्रतिरूप के माध्य और सहप्रसरण का घटक विशिष्ट भारित औसत होता है। | ||

डेम्पस्टर<ref name="dempster1977"/>यह भी दिखाया कि प्रत्येक क्रमिक ईएम पुनरावृत्ति संभावना को कम नहीं | डेम्पस्टर पद्धति<ref name="dempster1977"/> मे भी यह भी दिखाया गया है कि प्रत्येक क्रमिक ईएम पुनरावृत्ति संभावना को अपेक्षाकृत कम नहीं करता है अन्य प्रवणता आधारित अधिकतमकरण तकनीकों द्वारा साझा नहीं की जाने वाली संपत्ति इसके अतिरिक्त, ईएम स्वाभाविक रूप से प्रायिकतात्मक सदिश पर बाधाओं को अन्तः स्थापित करता है और पर्याप्त रूप से बड़े प्रतिरूप आकार के लिए सहसंयोजक पुनरावृत्तियों की धनात्मक निश्चितता यह एक प्रमुख लाभ है क्योंकि स्पष्ट रूप से विवश विधियों में उपयुक्त मान की जांच और संरक्षण के लिए अतिरिक्त कम्प्यूटेशनल लागत होती हैं। सैद्धांतिक रूप से ईएम एक प्रथम-क्रम एल्गोरिथम है और इस प्रकार धीरे-धीरे एक निश्चित-बिंदु समाधान में परिवर्तित हो जाता है। रेडनर और वाकर (1984){{full citation needed|date=November 2012}} इस बिंदु को उच्च रैखिक और दूसरे क्रम के न्यूटन और अर्ध-न्यूटन विधियों के पक्ष में तर्क दें और उनके अनुभवजन्य परीक्षणों के आधार पर ईएम में धीमे अभिसरण की रिपोर्ट करें। वे स्वीकार करते हैं कि प्रायिकतात्मक में अभिसरण तीव्र से था यद्यपि पैरामीटर मानों में अभिसरण स्वयं नहीं था। अन्य साहित्य में ईएम और अन्य कलनविधि बनाम अभिसरण के सापेक्ष गुणों पर चर्चा की गई है।<ref name=XuJordam>{{cite journal |first1=L. |last1=Xu |first2=M.I. |last2=Jordan |title=गॉसियन मिश्रण के लिए ईएम एल्गोरिथम के अभिसरण गुणों पर|journal=Neural Computation |volume=8 |issue=1 |pages=129–151 |date=January 1996 |doi=10.1162/neco.1996.8.1.129 |hdl=10338.dmlcz/135225 |s2cid=207714252 |hdl-access=free }}</ref> | ||

ईएम के उपयोग के लिए अन्य आम आपत्तियां यह हैं कि इसमें स्थानीय मैक्सिमा की | |||

ईएम के उपयोग के लिए अन्य आम आपत्तियां यह हैं कि इसमें स्थानीय मैक्सिमा की प्रतिरूप पहचान करने की प्रवृत्ति है, साथ ही प्रारंभिक मानो के प्रति संवेदनशीलता प्रदर्शित होती है।<ref name="McLachlan_2">{{citation | |||

|title=Finite Mixture Models | |title=Finite Mixture Models | ||

|first=G.J. |last=McLachlan | |first=G.J. |last=McLachlan | ||

| Line 301: | Line 302: | ||

|date=2000 | |date=2000 | ||

}}</ref><ref name="botev2004global">{{Cite book |author1=Botev, Z.I. |author2=Kroese, D.P. |author-link2=Dirk Kroese|title=Global likelihood optimization via the cross-entropy method with an application to mixture models | }}</ref><ref name="botev2004global">{{Cite book |author1=Botev, Z.I. |author2=Kroese, D.P. |author-link2=Dirk Kroese|title=Global likelihood optimization via the cross-entropy method with an application to mixture models | ||

|journal=[[Proceedings of the 2004 Winter Simulation Conference]] |volume= 1 |pages=517 |year=2004 |doi=10.1109/WSC.2004.1371358|isbn=978-0-7803-8786-7 |citeseerx=10.1.1.331.2319 |s2cid=6880171 }}</ref> पैरामीटर | |journal=[[Proceedings of the 2004 Winter Simulation Conference]] |volume= 1 |pages=517 |year=2004 |doi=10.1109/WSC.2004.1371358|isbn=978-0-7803-8786-7 |citeseerx=10.1.1.331.2319 |s2cid=6880171 }}</ref> पैरामीटर समष्टि में कई प्रारम्भिक बिंदुओं पर ईएम का मूल्यांकन करके इन समस्याओं का समाधान किया जा सकता है लेकिन यह कम्प्यूटेशनल रूप से कीमती है और अन्य दृष्टिकोण, जैसे कि यूडिया और नाकानो (1998) की एनीलिंग ईएम विधि (जिसमें प्रारंभिक घटकों को अनिवार्य रूप से ओवरलैप करने के लिए जटिल किया जाता है प्रारंभिक अनुमानों के लिए कम विषम आधार प्रदान करना अपेक्षाकृत रूप से अच्छा हो सकता है। | ||

फिगुएरेडो और जैन<ref name="Jain" />ध्यान दें कि सीमा पर प्राप्त 'अर्थहीन' पैरामीटर मानों का अभिसरण | फिगुएरेडो और जैन<ref name="Jain" />ध्यान दें कि सीमा पर प्राप्त 'अर्थहीन' पैरामीटर मानों का अभिसरण जहां नियमितता की स्थिति विभाजित हो जाती है, उदाहरण के लिए, घोष और सेन (1985) को प्रायः देखा जाता है जब मॉडल घटकों की संख्या इष्टतम/सही एक से अधिक हो जाती है। इस आधार पर वे अनुमान और पहचान के लिए एक एकीकृत दृष्टिकोण का सुझाव देते हैं जिसमें प्रारंभिक n को अपेक्षित इष्टतम मान से बहुत अधिक चयन किया जाता है। उनका अनुकूलन रूटीन एक न्यूनतम संदेश लंबाई (एमएमएल) मानदंड के माध्यम से बनाया गया है जो एक उम्मीदवार घटक को प्रभावी रूप से समाप्त कर देता है यदि इसका समर्थन करने के लिए अपर्याप्त जानकारी है। इस प्रकार n में विभाजन को व्यवस्थित करना और संयुक्त रूप से अनुमान और पहचान पर विचार करना संभव होता है। | ||

==== | ==== अपेक्षा चरण ==== | ||

मिश्रण मॉडल के मापदंडों के लिए प्रारंभिक अनुमानों के साथ, प्रत्येक घटक वितरण में प्रत्येक आंकड़ा बिंदु की "आंशिक सदस्यता" की गणना प्रत्येक आंकड़ा बिंदु के सदस्यता चर के लिए अपेक्षित मान की गणना करके की जाती है। अर्थात्, प्रत्येक आंकड़ा बिंदु x<sub>j</sub> और वितरण Y<sub>i</sub> के लिए, सदस्यता मान y<sub>i</sub>, j है: | |||

:<math> y_{i,j} = \frac{a_i f_Y(x_j;\theta_i)}{f_{X}(x_j)}.</math> | :<math> y_{i,j} = \frac{a_i f_Y(x_j;\theta_i)}{f_{X}(x_j)}.</math> | ||

==== अधिकतम चरण ==== | ==== अधिकतम चरण ==== | ||

समूह सदस्यता के लिए अपेक्षित | समूह सदस्यता के लिए अपेक्षित मानों के साथ वितरण मापदंडों के लिए [[प्लग-इन अनुमान|प्रयुक्त अनुमानों]] की पुन: गणना की जाती है। | ||

मिश्रण गुणांक | मिश्रण गुणांक ''a<sub>i</sub>'' और N आंकड़ा बिंदुओं पर सदस्यता मानों का अर्थ है: | ||

:<math> a_i = \frac{1}{N}\sum_{j=1}^N y_{i,j}</math> | :<math> a_i = \frac{1}{N}\sum_{j=1}^N y_{i,j}</math> | ||

घटक मॉडल पैरामीटर θ<sub>i</sub>आंकड़ा बिंदु x का उपयोग करके अपेक्षा अधिकतमकरण द्वारा भी | घटक मॉडल पैरामीटर θ<sub>i</sub> की गणना आंकड़ा बिंदु x<sub>j</sub> का उपयोग करके अपेक्षा अधिकतमकरण द्वारा भी की जाती है जिसे सदस्यता मानों का उपयोग करके भारित किया गया है। उदाहरण के लिए, यदि θ एक माध्य μ है: | ||

:<math> \mu_{i} = \frac{\sum_{j} y_{i,j}x_{j}}{\sum_{j} y_{i,j}}.</math> | :<math> \mu_{i} = \frac{\sum_{j} y_{i,j}x_{j}}{\sum_{j} y_{i,j}}.</math> | ||

''a<sub>i</sub>'' और θ<sub>i</sub> के लिए नए अनुमानों के साथ, नए सदस्यता मानों की पुनर्गणना करने के लिए अपेक्षा चरण को दोहराया जाता है। पूरी प्रक्रिया तब तक दोहराई जाती है जब तक कि मॉडल पैरामीटर अभिसरण नहीं हो जाते है। | |||

=== मार्कोव | === मार्कोव श्रृंखला मॉन्टे कार्लो === | ||

ईएम एल्गोरिथम के विकल्प के रूप में, मिश्रण मॉडल पैरामीटर को [[ पश्च नमूनाकरण |पश्च प्रतिरूपकरण]] का उपयोग करके घटाया जा सकता है जैसा कि बेयस प्रमेय द्वारा दर्शाया गया है। यह अभी भी एक अपूर्ण आंकड़ा समस्या के रूप में माना जाता है जिससे आंकड़ा बिंदुओं की सदस्यता लुप्त आंकड़ा है। [[ गिब्स नमूनाकरण |गिब्स प्रतिरूपकरण]] के रूप में जानी जाने वाली दो-चरणीय पुनरावृत्ति प्रक्रिया का उपयोग किया जा सकता है। | |||

दो गाऊसी वितरणों के मिश्रण का पिछला उदाहरण प्रदर्शित कर सकता है कि विधि कैसे | दो गाऊसी वितरणों के मिश्रण का पिछला उदाहरण प्रदर्शित कर सकता है कि विधि कैसे कार्य करती है। पहले की तरह, मिश्रण मॉडल के लिए प्राचलों का प्रारंभिक अनुमान लगाया जाता है। प्रत्येक मौलिक वितरण के लिए आंशिक सदस्यता की गणना करने के अतिरिक्त प्रत्येक आंकड़ा बिंदु के लिए एक सदस्यता मान बर्नौली वितरण से तैयार किया जाता है (अर्थात, इसे पहले या दूसरे गॉसियन को निर्धारित किया जाएगा)। बर्नौली पैरामीटर θ घटक वितरण में से एक के आधार पर प्रत्येक आंकड़ा बिंदु के लिए निर्धारित किया जाता है।{{Vague|What does this mean?|date=March 2008}} वितरण से कर्षण को प्रत्येक आंकड़ा बिंदु के लिए सदस्यता संघों को उत्पन्न करता है। निर्धारित अनुमानकों का उपयोग ईएम के M चरण के रूप में मिश्रण मॉडल पैरामीटर का एक नया समूह उत्पन्न करने के लिए किया जा सकता है और द्विपद कर्षण चरण को दोहराया जाता है। | ||

=== क्षण | === क्षण अनुरूपण === | ||

[[क्षणों की विधि (सांख्यिकी)]] 1894 के कार्ल पियर्सन के सेमिनल कार्य से संबंधित मिश्रण मापदंडों को निर्धारित करने के लिए सबसे पुरानी तकनीकों में से एक है। | [[क्षणों की विधि (सांख्यिकी)]] 1894 के कार्ल पियर्सन के सेमिनल कार्य से संबंधित मिश्रण मापदंडों को निर्धारित करने के लिए सबसे पुरानी तकनीकों में से एक है। इस दृष्टिकोण में मिश्रण के पैरामीटर इस प्रकार निर्धारित किए जाते हैं कि समग्र वितरण में कुछ दिए गए मान के अनुरूपण क्षण होते हैं। कई उदाहरणों में पल समीकरणों के समाधान निकालने से गैर-तुच्छ बीजगणितीय या कम्प्यूटेशनल समस्याएं हो सकती हैं। इसके अतिरिक्त, दिन के अनुसार से संख्यात्मक विश्लेषण<ref name=day>{{Cite journal | last1 = Day | first1 = N. E. | title = सामान्य वितरण के मिश्रण के घटकों का अनुमान लगाना| journal = Biometrika | volume = 56 | issue = 3 | pages = 463–474 | doi = 10.2307/2334652 | jstor = 2334652| year = 1969 }}</ref> ने संकेत दिया है कि ईएम की तुलना में ऐसी विधियां अक्षम हो सकती हैं। जो इस पद्धति में नए सिरे से रुचि दिखाई गई है, उदाहरण के लिए, क्रेगमील और टिटरिंगटन (1998) और वांग<ref name=wang>{{citation | ||

इस दृष्टिकोण में मिश्रण के पैरामीटर इस | |||

|title=Generating daily changes in market variables using a multivariate mixture of normal distributions | |title=Generating daily changes in market variables using a multivariate mixture of normal distributions | ||

|first = J. | last = Wang | |first = J. | last = Wang | ||

|date = 2001 | |date = 2001 | ||

|journal = Proceedings of the 33rd Winter Conference on Simulation |pages =283–289 | |journal = Proceedings of the 33rd Winter Conference on Simulation |pages =283–289 | ||

}}</ref> | }}</ref>, मैकविलियम और लोह (2009) बड़े आयामी प्रणालियों में एक हाइपर-क्यूबॉइड सामान्य मिश्रण [[कोप्युला (सांख्यिकी)]] के लक्षण वर्णन पर विचार करते हैं जिसके लिए ईएम कम्प्यूटेशनल रूप से निषेधात्मक होता है यहाँ एक पैटर्न विश्लेषण रूटीन का उपयोग बहुचर पूंछ-निर्भरता उत्पन्न करने के लिए किया जाता है, जो एक प्रकार के अविभाजित और (कुछ अर्थों में) द्विभाजित क्षणों के अनुरूप होता है। इस पद्धति के प्रदर्शन का मूल्यांकन कोलमोगोरोव-स्मिर्नोव परीक्षण आंकड़ों के साथ निर्दिष्ट अभिलेखित आंकड़ा का उपयोग करके किया जाता है जो एक अच्छा वर्णनात्मकता का सुझाव देता है। | ||

मैकविलियम और लोह (2009) बड़े आयामी प्रणालियों में एक हाइपर-क्यूबॉइड सामान्य मिश्रण [[कोप्युला (सांख्यिकी)]] के लक्षण वर्णन पर विचार करते हैं जिसके लिए ईएम कम्प्यूटेशनल रूप से निषेधात्मक | |||

=== [[वर्णक्रमीय विधि]] === | |||

[[वर्णक्रमीय विधि|वर्णक्रमीय विधियों]] का उपयोग करके मिश्रण मॉडल के आकलन में कुछ समस्याओं को हल किया जा सकता है। विशेष रूप से यह उपयोगी हो जाता है यदि आंकड़ा बिंदु x<sub>i</sub> है उच्च-आयामी [[वास्तविक समन्वय स्थान|वास्तविक समन्वय समष्टि]] में बिंदु हैं और छिपे हुए वितरण को लघुगणक रूप से अवतल कार्य लघुगणक-अवतल (जैसे गॉसियन वितरण या घातीय वितरण) के रूप में जाना जाता है। प्रशिक्षण के मिश्रण मॉडल के वर्णक्रमीय तरीके एक आव्यूह के एकल मान अपघटन के उपयोग पर आधारित होते हैं जिसमें आंकड़ा बिंदु होते हैं। विचार शीर्ष k एकल सदिश पर विचार करना है, जहाँ k प्रक्षेपण के लिए वितरण की संख्या है। प्रत्येक आंकड़ा बिंदु उन सदिश समूहों द्वारा विस्तृत एक रेखीय उप-समष्टि की ओर संकेत करता है जो समान वितरण से उत्पन्न होते हैं और एक साथ बहुत निकट होते हैं, जबकि विभिन्न वितरणों के अंक दूर-दूर रहते हैं। | |||

वर्णक्रमीय पद्धति की एक विशिष्ट विशेषता यह है कि यह हमें [[गणितीय प्रमाण]] की स्वीकृति प्राप्त होती है कि यदि निश्चित विभाजन की स्थिति को पूरा करते हैं उदाहरण के लिए, बहुत निकट नहीं है तो अनुमानित मिश्रण उच्च संभावना के साथ बहुत निकट हो सकता है। | |||

वर्णक्रमीय पद्धति की एक विशिष्ट विशेषता यह है कि यह हमें [[गणितीय प्रमाण]] की | |||

=== ग्राफिकल तरीके === | === ग्राफिकल तरीके === | ||

टार्टर और लॉक<ref name="tart" />मिश्रण पहचान के लिए एक ग्राफिकल दृष्टिकोण का वर्णन करें जिसमें एक कर्नेल | टार्टर और लॉक<ref name="tart" />मिश्रण पहचान के लिए एक ग्राफिकल दृष्टिकोण का वर्णन करें जिसमें एक कर्नेल फलन को अनुभवजन्य आवृत्ति प्लॉट पर प्रयुक्त किया जाता है ताकि अतः-घटक भिन्नता को कम किया जा सके। इस प्रकार अलग-अलग साधनों वाले घटकों की अधिक आसानी से पहचान की जा सकती है। हालांकि इस λ-पद्धति को घटकों की संख्या या कार्यात्मक रूप के पूर्व ज्ञान की आवश्यकता नहीं होती है लेकिन इसकी सफलता कर्नेल पैरामीटर की रुचि पर निर्भर करती है जो कुछ अपेक्षाकृत घटक संरचना के विषय में धारणाओं को अंतः स्थापित करती है। | ||

=== अन्य तरीके === | === अन्य तरीके === | ||

उनमें से कुछ | उनमें से कुछ लगभग भारी-पुच्छल वाले वितरणों के मिश्रण को भी सीख सकते हैं जो अनंत भिन्नता वाले हैं (नीचे दस्तावेज़ के लिंक देखें)। इस सेटिंग में, ईएम आधारित तरीके कार्य नहीं करेंगे, क्योंकि बाहरी परत की उपस्थिति के कारण अपेक्षा चरण भिन्न हो सकता है। | ||

इस सेटिंग में, | |||

=== | === अनुकरण === | ||

आकार N के | आकार N के एक प्रतिरूप का अनुकरण करने के लिए जो कि वितरण F<sub>i</sub>, i = 1 से n के मिश्रण से है, प्रायिकता p<sub>i</sub> (sum = p<sub>i</sub> = 1) के साथ: | ||

# आकार n | # आकार n के एक स्पष्ट वितरण से N यादृच्छिक संख्या उत्पन्न करें और i = 1 = से n के लिए संभावनाएँ pi ये आपको बताते हैं कि प्रत्येक एन मान किस F<sub>i</sub> से आएगा। i<sup>th</sup> श्रेणी को दी गई यादृच्छिक संख्याओं की मात्रा को m<sub>i</sub> से निरूपित करें। | ||

# प्रत्येक i के लिए, | # प्रत्येक i के लिए, F<sub>i</sub> वितरण से m<sub>i</sub> यादृच्छिक संख्याएँ उत्पन्न करें। | ||

== | == विस्तारण == | ||

बायेसियन अनुमान में, मिश्रण मॉडल को परिभाषित करने वाले [[ग्राफिकल मॉडल]] में अतिरिक्त स्तर | बायेसियन अनुमान में, मिश्रण मॉडल को परिभाषित करने वाले [[ग्राफिकल मॉडल]] में अतिरिक्त स्तर को संबद्ध किया जा सकता हैं उदाहरण के लिए, सामान्य अव्यक्त डिरिचलेट आवंटन विषय मॉडल में, अवलोकन D विभिन्न दस्तावेज़ों से लिए गए शब्दों के समूह हैं और K मिश्रण घटक उन विषयों का प्रतिनिधित्व करते हैं जो दस्तावेज़ों में साझा किए जाते हैं। प्रत्येक दस्तावेज़ में मिश्रण भार का एक अलग समूह होता है, जो उस दस्तावेज़ में प्रचलित विषयों को निर्दिष्ट करता है। मिश्रण भार के सभी समूह सामान्य [[ hyperparameter |हाइपर पैरामीटर]] को झा करते हैं। | ||

यह मानने के | यह मानने के अतिरिक्त कि वे स्वतंत्र रूप से समान रूप से वितरित यादृच्छिक चर हैं, एक मार्कोव श्रृंखला में मिश्रण घटक पहचान को परिभाषित करने वाले अव्यक्त चर को जोड़ने के लिए एक बहुत ही सामान्य विस्तार है। परिणामी मॉडल को एक छिपा हुआ मार्कोव मॉडल कहा जाता है और यह सबसे सामान्य नुक्रमिक श्रेणीबद्ध मॉडल में से एक है। छिपे हुए मार्कोव मॉडल के कई विस्तार विकसित किए गए हैं अधिक जानकारी के लिए परिणामी लेख देखें। | ||

== इतिहास == | == इतिहास == | ||

मिश्रण वितरण और मिश्रण अपघटन की समस्या, जो कि इसके | मिश्रण वितरण और मिश्रण अपघटन की समस्या, जो कि इसके घटकों और उसके मापदंडों की पहचान है जिसका साहित्य में 1846 (मैकलचैन में क्वेटलेट 2000) तक वापस उद्धृत किया गया है।<ref name="McLachlan_2" /> हालांकि सामान्य संदर्भ इसके लिए बनाया गया है [[कार्ल पियर्सन]] (1894) का कार्य पहले लेखक के रूप में मादा किनारे केकड़े की आबादी में माथे से शरीर की लंबाई के अनुपात की गैर-सामान्य विशेषताओं को स्पष्ट रूप से संबोधित करने के लिए अपघटन समस्या को संबोधित करता है। इस कार्य के लिए प्रेरणा प्राणी विज्ञानी [[वाल्टर फ्रैंक राफेल वेल्डन]] द्वारा प्रदान की गई थी जिन्होंने 1893 में अनुमान लगाया था (टार्टर और लॉक<ref name="tart" /> में) कि इन अनुपातों के हिस्टोग्राम में विषमता विकासवादी विचलन का संकेत दे सकती है। पियर्सन का दृष्टिकोण मिश्रण के पांच मापदंडों को चुनकर आंकड़ा में दो मानदंडों के एक अविभाज्य मिश्रण को प्रयुक्त करना था जैसे कि अनुभवजन्य क्षण मॉडल के अनुरूप थे। | ||

जबकि उनका | जबकि उनका कार्य दो संभावित अलग-अलग उप-जनसंख्या की पहचान करने में सफल रहा और एक क्षण अनुरूपण उपकरण के रूप में मिश्रण की नम्यता को प्रदर्शित करने में सूत्रीकरण के लिए 9वीं डिग्री (नॉनिक) बहुपद के समाधान की आवश्यकता थी जो उस समय एक महत्वपूर्ण कम्प्यूटेशनल चुनौती थी। इसके बाद के कार्यों ने इन समस्याओं को दूर करने पर ध्यान केंद्रित किया, लेकिन यह तब तक नहीं था जब तक कि आधुनिक कंप्यूटर का आगमन और अधिकतम संभावना (एमएलई) प्राचलीकरण तकनीकों का लोकप्रियकरण नहीं हो गया था, जो वास्तव में शोध से दूर हो गए थे।<ref name="McLachlan_1">{{citation | ||

<nowiki>|</nowiki>title=Mixture Models: inference and applications to clustering | |||

इसके बाद के कार्यों ने इन समस्याओं को दूर करने पर ध्यान केंद्रित किया, लेकिन यह तब तक नहीं था जब तक कि आधुनिक कंप्यूटर का आगमन और अधिकतम संभावना ( | <nowiki>|journal=Statistics: Textbooks and Monographs |</nowiki>first1=G.J. |last1=McLachlan |first2=K.E. |last2=Basford | ||

|title=Mixture Models: inference and applications to clustering | <nowiki>|</nowiki>date=1988 | ||

|journal=Statistics: Textbooks and Monographs |first1=G.J. |last1=McLachlan |first2=K.E. |last2=Basford | <nowiki>|</nowiki>bibcode=1988mmia.book.....M }</ref> उस समय से मत्स्य, [[कृषि]], [[वनस्पति विज्ञान]], [[अर्थशास्त्र]], चिकित्सा, [[आनुवंशिकी]], [[मनोविज्ञान]], जीवाश्म विज्ञान, [[वैद्युतकणसंचलन|वैद्युतकण संचलन]], [[वित्त]], भूविज्ञान और [[ जीव विज्ञानं |जीव विज्ञानं]] जैसे क्षेत्रों में विस्तृत इस विषय पर शोध का एक विशाल निकाय रहा है।<ref name="titter_1">{{harvnb|Titterington|Smith|Makov|1985}}</ref> | ||

|date=1988 | |||

|bibcode=1988mmia.book.....M }</ref> उस समय से मत्स्य, [[कृषि]], [[वनस्पति विज्ञान]], [[अर्थशास्त्र]], चिकित्सा, [[आनुवंशिकी]], [[मनोविज्ञान]], जीवाश्म विज्ञान, [[वैद्युतकणसंचलन]], [[वित्त]], भूविज्ञान और [[ जीव विज्ञानं |जीव विज्ञानं]] जैसे क्षेत्रों में विस्तृत इस विषय पर | |||

== यह भी देखें == | == यह भी देखें == | ||

| Line 441: | Line 425: | ||

* [https://mpatacchiola.github.io/blog/2020/07/31/gaussian-mixture-models.html Gaussian Mixture Models] Blog post on Gaussian Mixture Models trained via Expectation Maximization, with an implementation in Python. | * [https://mpatacchiola.github.io/blog/2020/07/31/gaussian-mixture-models.html Gaussian Mixture Models] Blog post on Gaussian Mixture Models trained via Expectation Maximization, with an implementation in Python. | ||

{{DEFAULTSORT:Mixture Model}} | {{DEFAULTSORT:Mixture Model}} | ||

[[Category: | [[Category:All Wikipedia articles needing clarification|Mixture Model]] | ||

[[Category:Created On 21/03/2023]] | [[Category:All articles with incomplete citations|Mixture Model]] | ||

[[Category:Articles with hatnote templates targeting a nonexistent page|Mixture Model]] | |||

[[Category:Articles with incomplete citations from November 2012|Mixture Model]] | |||

[[Category:Created On 21/03/2023|Mixture Model]] | |||

[[Category:Lua-based templates|Mixture Model]] | |||

[[Category:Machine Translated Page|Mixture Model]] | |||

[[Category:Pages with script errors|Mixture Model]] | |||

[[Category:Short description with empty Wikidata description|Mixture Model]] | |||

[[Category:Templates Vigyan Ready|Mixture Model]] | |||

[[Category:Templates that add a tracking category|Mixture Model]] | |||

[[Category:Templates that generate short descriptions|Mixture Model]] | |||

[[Category:Templates using TemplateData|Mixture Model]] | |||

[[Category:Wikipedia articles needing clarification from March 2008|Mixture Model]] | |||

[[Category:अव्यक्त चर मॉडल|Mixture Model]] | |||

[[Category:क्लस्टर विश्लेषण|Mixture Model]] | |||

[[Category:संभाव्य मॉडल|Mixture Model]] | |||

Latest revision as of 16:33, 9 April 2023

आँकड़ों में, मिश्रण मॉडल समस्त जनसंख्या मे उप-जनसंख्या की उपस्थिति का प्रतिनिधित्व करने के लिए प्रायिकतात्मक मॉडल है किसी देखे गए आंकड़ा मे उप-जनसंख्या की पहचान करने की अवश्यकता होती है जिसमें एक व्यक्तिगत अवलोकन होता है। औपचारिक रूप से एक मिश्रण मॉडल मिश्रण वितरण के अनुरूप होता है जो समग्र जनसंख्या में टिप्पणियों के प्रायिकतात्मक वितरण का प्रतिनिधित्व करता है। हालांकि, "मिश्रण वितरण" से संबद्ध समस्याएं उप-जनसंख्या के गुणों से समग्र जनसंख्या के गुणों को प्राप्त करने से संबंधित हैं मिश्रण मॉडल का उपयोग उप-जनसंख्या के गुणों के विषय में सांख्यिकीय अनुमान लगाने के लिए किया जाता है, जो केवल टिप्पणियों पर दिया जाता है। जनसंख्या, उप-जनसंख्या पहचान जानकारी के अतिरिक्त मिश्रण मॉडल को संरचनागत आंकड़ा के मॉडल के साथ भ्रमित नहीं होना चाहिए। अर्थात, आंकड़ा जिसके घटक एक स्थिर मान (1, 100%, आदि) के योग के लिए विवश हैं। हालाँकि, संरचनागत मॉडल को मिश्रण मॉडल के रूप में माना जा सकता है जहाँ जनसंख्या के सदस्यों का यादृच्छिक रूप से प्रतिरूप लिया जाता है। इसके विपरीत, मिश्रण मॉडल को रचनात्मक मॉडल के रूप में माना जा सकता है, जहां कुल आकार पढ़ने वाली जनसंख्या को सामान्य कर दिया गया है।

संरचना

सामान्य मिश्रण मॉडल

एक विशिष्ट परिमित-आयामी मिश्रण मॉडल एक पदानुक्रमित बेयस मॉडल है जिसमें निम्नलिखित घटक सम्मिलित हैं:

- N यादृच्छिक चर जो देखे गए हैं, प्रत्येक वितरण के समान पैरामीट्रिक समूह से संबंधित घटकों के साथ K घटकों जैसे सभी सामान्य वितरण, सभी जेडआईपीएफ का नियम के विभिन्न मापदंडों के साथ मिश्रण के अनुसार वितरित किया गया है।

- N यादृच्छिक गुप्त चर प्रत्येक अवलोकन के मिश्रण घटक की पहचान को निर्दिष्ट करते हैं, प्रत्येक को K-आयामी श्रेणीबद्ध वितरण के अनुसार वितरित किया जाता है।

- K मिश्रण भार का एक समूह जो कि 1 के योग की प्रायिकतात्मकता हैं।

- K मापदंडों का एक समूह प्रत्येक संबंधित मिश्रण घटक के पैरामीटर को निर्दिष्ट करता है। कई स्थितियों में प्रत्येक पैरामीटर वास्तव में पैरामीटर का समूह होता है। उदाहरण के लिए, यदि मिश्रण घटक गाऊसी वितरण हैं तो प्रत्येक घटक के लिए एक माध्य और विचरण होता है यदि मिश्रण घटक श्रेणीबद्ध वितरण हैं उदाहरण के लिए, जब प्रत्येक अवलोकन आकार V के एक परिमित वर्णमाला से एक टोकन है, तो V संभावनाओं का एक सदिश 1 होता है।

इसके अतिरिक्त बायेसियन अनुमान में, मिश्रण भार और पैरामीटर स्वयं यादृच्छिक चर होंगे और पूर्व वितरण को चर पर रखा जाएगा। ऐसी स्थिति में भार को सामान्यतः एक डीरिचलेट वितरण (श्रेणीबद्ध वितरण से पहले संयुग्मित) से तैयार किए गए के-आयामी यादृच्छिक सदिश के रूप में देखा जाता है और मापदंडों को उनके संबंधित संयुग्म पूर्ववर्तियों के अनुसार वितरित किया जाता है।

गणितीय रूप से, एक मूल पैरामीट्रिक मिश्रण मॉडल को निम्नानुसार वर्णित किया जा सकता है:

बायेसियन सेटिंग में, सभी पैरामीटर यादृच्छिक चर से संबद्ध होते हैं जो इस प्रकार हैं:

यह वर्णन क्रमशः टिप्पणियों और मापदंडों पर अपेक्षाकृत वितरण का वर्णन करने के लिए F और H का उपयोग करता है। सामान्यतः H, F से पहले का संयुग्मी होगा। F के दो सबसे सामान्य विकल्प गॉसियन वितरण व सामान्य वितरण (वास्तविक-मूल्यवान टिप्पणियों के लिए) और श्रेणीबद्ध वितरण (असतत टिप्पणियों के लिए) हैं। मिश्रण घटकों के वितरण के लिए अन्य सामान्य संभावनाएँ हैं:

- द्विपद वितरण, धनात्मक घटनाओं की संख्या के लिए (जैसे, सफलता, वोट, आदि) कुल घटनाओं की एक निश्चित संख्या दी गई है।

- बहुपद वितरण, द्विपद वितरण के समान, लेकिन बहु-मार्गीय घटनाओं की संख्या के लिए (उदाहरण के लिए, हाँ/नहीं/लगभग एक सर्वेक्षण में) है।

- ऋणात्मक द्विपद वितरण, द्विपद-प्रकार के प्रेक्षणों के लिए लेकिन जहां ब्याज की मात्रा दी गई सफलताओं की संख्या होने से पहले विफलताओं की संख्या है।

- पॉसों वितरण, किसी निश्चित समयावधि में किसी घटना की घटनाओं की संख्या के लिए, उस घटना के लिए जो घटना की निश्चित दर से होती है।

- अगली घटना होने से पहले के समय के लिए घातीय वितरण, एक घटना के लिए जो घटना की निश्चित दर से विशेषता है।

- लॉग-सामान्य वितरण , धनात्मक वास्तविक संख्या (जैसे कि आय या कीमतें) के लिए जो घातीय रूप से बढ़ते हैं।

- बहुचर सामान्य वितरण (या बहुचर गॉसियन वितरण), सहसंबद्ध परिणामों के सदिश के लिए जो व्यक्तिगत रूप से गॉसियन-वितरित हैं।

- बहुचर छात्र का टी-वितरण वाले सहसंबद्ध परिणामों के लिए सदिश है।[1]

- बर्नूली प्रमेय-वितरित मानों का एक सदिश, संबंधित, उदाहरण के लिए, एक श्वेत-श्याम छवि के लिए, जिसमें प्रत्येक मान एक पिक्सेल का प्रतिनिधित्व करता है। तथा हस्तलिपि-पहचान का उदाहरण नीचे देखें।

विशिष्ट उदाहरण

गाऊसी मिश्रण मॉडल

एक विशिष्ट गैर-बायेसियन गाऊसी वितरण मिश्रण मॉडल इस प्रकार है:

गाऊसी वितरण मिश्रण मॉडल का बायेसियन संस्करण इस प्रकार है:

- Failed to parse (⧼math_empty_tex⧽): {\displaystyle }

बहुचर गाऊसी मिश्रण मॉडल

बायेसियन गॉसियन मिश्रण मॉडल को सामान्यतः अज्ञात मापदंडों (स्पष्ट चिह्न) या बहुचर सामान्य वितरणों के सदिश में प्रयुक्त करने के लिए विस्तारित किया जाता है। एक बहुचर वितरण में (अर्थात N यादृच्छिक चर के साथ एक सदिश मॉडलिंग) एक गॉसियन मिश्रण मॉडल पूर्व वितरण का उपयोग करके मापदंडों के सदिश (जैसे एक संकेत के कई अवलोकन या एक छवि के भीतर पैच) का मॉडल कर सकता है द्वारा दिए गए अनुमानों के सदिश है:

जहां ith सदिश घटक को भार अर्थात और सहप्रसरण आव्यूह के साथ सामान्य वितरण द्वारा चित्रित किया जाता है। बायेसियन अनुमान में इसे पूर्व में सम्मिलित करने के लिए को ज्ञात वितरण से गुणा किया जाता है आंकड़ा का मापदंडों पर सशर्त अनुमान लगाया जाना है। इस सूत्रीकरण के साथ, पश्च प्रायिकतात्मक रूप का गॉसियन मिश्रण मॉडल भी है:

नए मापदंडों के साथ और जो अपेक्षा-अधिकतमकरण एल्गोरिथम का उपयोग करके अपडेट किए जाते हैं।[2] हालांकि ईएम-आधारित पैरामीटर अपडेट अच्छी तरह से स्थापित हैं, इन पैरामीटरों के लिए प्रारंभिक अनुमान प्रदान करना वर्तमान में सक्रिय शोध का एक क्षेत्र है। ध्यान दें कि यह सूत्रीकरण पूर्ण पश्च वितरण के लिए विवृत रूप समाधान उत्पन्न करता है। यादृच्छिक चर का अनुमान कई अनुमानकों में से एक के माध्यम से प्राप्त किया जा सकता है, जैसे कि पश्च वितरण का औसत या अधिकतम प्राप्त किया जाता है।

इस प्रकार के वितरण छवियों और समूहों के पैच-वार आकार ग्रहण करने के लिए उपयोगी होते हैं, उदाहरण के लिए छवि प्रतिनिधित्व की स्थिति में, प्रत्येक गॉसियन सहप्रसरण आव्यूह के अनुसार झुका, विस्तारित और विकृत हो सकता है समुच्चय का एक गाऊसी वितरण छवि में प्रत्येक पैच (सामान्यतः आकार 8x8 पिक्सेल) के लिए प्रयुक्त होता है। विशेष रूप से, क्लस्टर के चारों ओर बिंदुओं का कोई भी वितरण k पर्याप्त गॉसियन घटकों को शुद्ध रूप से दिया जा सकता है लेकिन किसी दिए गए छवि वितरण या आंकड़ा के क्लस्टर को परिशुद्ध रूप से मॉडल करने के लिए के K = 20 से अधिक घटकों की आवश्यकता होती है।

श्रेणीबद्ध मिश्रण मॉडल

श्रेणीबद्ध वितरण टिप्पणियों वाला एक विशिष्ट गैर-बायेसियन मिश्रण मॉडल इस प्रकार है:

- ऊपरोक्त के अनुसार

- ऊपरोक्त के अनुसार

- ऊपरोक्त के अनुसार

- श्रेणीबद्ध टिप्पणियों का आयाम, उदाहरण के लिए, शब्द और शब्दावली का आकार

- घटक अवलोकन के घटक की प्रायिकता

- आयाम का सदिश की रचना योग 1 होना चाहिए

यादृच्छिक चर:

विशिष्ट वितरण टिप्पणियों वाला एक विशिष्ट बायेसियन मिश्रण मॉडल इस प्रकार है:

- ऊपरोक्त के अनुसार

- ऊपरोक्त के अनुसार

- ऊपरोक्त के अनुसार

- श्रेणीबद्ध टिप्पणियों का आयाम, उदाहरण के लिए, शब्द शब्दावली का आकार

- घटक अवलोकन के घटक की प्रायिकता

- आयाम का सदिश की रचना है जिसका योग 1 होना चाहिए।

- प्रत्येक घटक के लिए का साझा एकाग्रता हाइपर पैरामीटर

- की सघनता हाइपर पैरामीटर

यादृच्छिक चर:

उदाहरण

एक वित्तीय मॉडल

वित्तीय वापसी प्रायः सामान्य परिस्थितियों में और संकट के समय में अलग प्रकार व्यवहार करते हैं। वापसी आंकड़ा के लिए एक मिश्रण मॉडल उपयुक्त प्रतीत होता है।[3] कभी-कभी उपयोग किया जाने वाला मॉडल एक कूद-प्रसार मॉडल होता है या दो सामान्य वितरणों के मिश्रण के रूप में होता है। आगे के संदर्भ के लिए वित्तीय अर्थशास्त्र § चुनौतियां और आलोचना और वित्तीय जोखिम प्रबंधन § बैंकिंग देखें।

घर की कीमत

मान लें कि हम N विभिन्न घरों की कीमतों का निरीक्षण करते हैं। अलग-अलग क्षेत्र में अलग-अलग प्रकार के घरों की कीमतें अपेक्षाकृत अलग होंगी, लेकिन किसी विशेष निकट क्षेत्र में एक विशेष प्रकार के घर की कीमत (उदाहरण के लिए, मध्यम उच्च स्तर के पास में तीन-बेडरूम का घर) औसत के आसपास अपेक्षाकृत सूक्ष्मता से निरक्षण करता है ऐसी कीमतों का एक संभावित मॉडल यह मानना होगा कि कीमतों को मिश्रण मॉडल द्वारा के विभिन्न घटकों के साथ शुद्ध रूप से वर्णित किया गया है, प्रत्येक अज्ञात माध्य और भिन्नता के साथ सामान्य वितरण के रूप में वितरित किया गया है, प्रत्येक घटक घर के प्रकार/पड़ोस के विशेष संयोजन को निर्दिष्ट करता है। इस मॉडल को देखी गई कीमतों के लिए प्रयुक्त करना, उदाहरण के लिए, अपेक्षा-अधिकतमकरण कलनविधि का उपयोग करके, घर के प्रकार के अनुसार कीमतों को क्लस्टर करना होगा और प्रत्येक प्रकार में कीमतों के विस्तार को प्रकट करना होगा। ध्यान दें कि कीमतों या आय जैसे मानों के लिए जो धनात्मक होने के लिए उत्तरदायी है और जो तीव्रता से बढ़ने लगते हैं, लघुगणक सामान्य वितरण मान वास्तव में सामान्य वितरण से अपेक्षाकृत अच्छे मॉडल हो सकते है।

दस्तावेज़ में विषय

मान लें कि एक दस्तावेज़ आकार V की कुल शब्दावली से N भिन्न शब्दों से है, जहाँ प्रत्येक शब्द K संभावित विषयों में से एक के अनुरूप है। ऐसे शब्दों के वितरण को K भिन्न V-आयामी श्रेणीबद्ध वितरण के मिश्रण के रूप में तैयार किया जा सकता है। इस प्रकार के एक मॉडल को सामान्यतः एक विषय मॉडल कहा जाता है। ध्यान दें कि इस प्रकार के मॉडल पर प्रयुक्त होने वाली अपेक्षा अधिकतमकरण सामान्यतः अत्युपपन्न के कारण (अन्य स्थिति के अतिरिक्त) यथार्थवादी परिणाम उत्पन्न करने में विफल रहता है अच्छे परिणाम प्राप्त करने के लिए सामान्यतः कुछ प्रकार की अतिरिक्त धारणाएँ आवश्यक होती हैं। सामान्यतः दो प्रकार के अतिरिक्त घटक मॉडल में जोड़े जाते हैं:

- एक पूर्व वितरण विषय वितरण का वर्णन करने वाले मापदंडों पर रखा गया है, एक एकाग्रता पैरामीटर के साथ डिरिचलेट वितरण का उपयोग करके जो 1 से नीचे प्रयुक्त किया गया है, ताकि विरल वितरण को प्रोत्साहित किया जा सके और जहां केवल कुछ शब्दों में गैर-शून्य संभावनाएं हैं।

- प्राकृतिक क्लस्टरिंग का लाभ प्राप्त करने के लिए, शब्दों की विषय पहचान पर कुछ प्रकार की अतिरिक्त बाधाएँ रखी जाती हैं। उदाहरण के लिए, एक मार्कोव श्रृंखला को विषय की पहचान पर रखा जा सकता है अर्थात, प्रत्येक अवलोकन के मिश्रण घटक को निर्दिष्ट करने वाले अव्यक्त चर, इस तथ्य के अनुरूप कि पास के शब्द समान विषयों से संबंधित हैं। यह एक छिपा हुआ मार्कोव मॉडल में परिणत होता है, विशेष रूप से एक जहां एक पूर्व वितरण स्थिति के परिवर्तनों पर रखा जाता है जो एक ही स्थिति में रहने वाले परिवर्तनों का समर्थन करता है।

- एक अन्य संभावना अव्यक्त डिरिचलेट आवंटन मॉडल है, जो शब्दों को D को विभिन्न दस्तावेजों में विभाजित करता है और मानता है कि प्रत्येक दस्तावेज़ में किसी भी आवृत्ति के साथ केवल कुछ ही विषय होते हैं।

लिखावट की पहचान

निम्नलिखित उदाहरण क्रिस्टोफर एम. बिशप, पैटर्न पहचान और यंत्र प्रशिक्षण एक उदाहरण पर आधारित है।[4] कल्पना कीजिए कि हमें एक N×N श्वेत-श्याम छवि दी गई है जिसे 0 और 9 के बीच हाथ से लिखे अंक के अवलोकन के रूप में जाना जाता है, लेकिन हम नहीं जानते कि कौन सा अंक लिखा गया है। हम एक मिश्रण मॉडल बना सकते हैं विभिन्न घटक, जहाँ प्रत्येक घटक आकार का एक सदिश है बरनौली वितरण (प्रति पिक्सेल एक) इस प्रकार के एक मॉडल को हाथ से लिखे अंकों के बिना लेबल वाले समुच्चय पर अपेक्षा-अधिकतमकरण एल्गोरिथ्म के साथ प्रशिक्षित किया जा सकता है, और प्रभावी रूप से लिखे जा रहे अंकों के अनुसार छवियों को क्लस्टर करता है उसी मॉडल का उपयोग केवल मापदंडों को स्थिर रखते हुए, प्रत्येक संभावित अंक (एक तुच्छ गणना) के लिए नई छवि की प्रायिकता की गणना करके और उच्चतम प्रायिकतात्मक उत्पन्न करने वाले अंक को वापस करके दूसरी छवि के अंक को पहचानने के लिए किया जा सकता है।

प्रक्षेप्य शुद्धता का आकलन (या परिपत्र त्रुटि संभावित, सीईपी)

मिश्रण मॉडल एक लक्ष्य पर कई प्रक्षेप्य को निर्देशित करने की समस्या में प्रयुक्त होते हैं (जैसे वायु, भूमि या समुद्री रक्षा अनुप्रयोगों में), जहां प्रक्षेप्य की भौतिक या सांख्यिकीय विशेषताएं कई प्रक्षेप्य के भीतर भिन्न होती हैं। उदाहरण एक लक्ष्य पर निर्देशित कई स्थानों से कई प्रकार के गोला-बारूद या शॉट्स से हो सकता है। प्रक्षेप्य प्रकारों के संयोजन को गाऊसी मिश्रण मॉडल के रूप में चित्रित किया जा सकता है।[5] इसके अतिरिक्त प्रक्षेप्य के एक समूह के लिए सटीकता का एक प्रसिद्ध उपाय परिपत्र त्रुटि संभावित (सीईपी) है जो कि संख्या R है, औसतन प्रक्षेप्य के समूह का आधा लक्ष्य के विषय में त्रिज्या R के घेरे में आता है। बिंदु मिश्रण मॉडल का उपयोग मान R निर्धारित या अनुमान करने के लिए किया जा सकता है। मिश्रण मॉडल विभिन्न प्रकार के प्रक्षेप्य को उपयुक्त रूप से प्रयुक्त करता है।

प्रत्यक्ष और अप्रत्यक्ष अनुप्रयोग

उपरोक्त वित्तीय उदाहरण मिश्रण मॉडल का एक प्रत्यक्ष अनुप्रयोग है एक ऐसी स्थिति जिसमें हम एक अंतर्निहित तंत्र मानते हैं ताकि प्रत्येक अवलोकन विभिन्न स्रोतों या श्रेणियों में से किसी एक से संबंधित हो। हालाँकि, यह अंतर्निहित तंत्र देखने योग्य हो भी सकता है और नहीं भी, यह मिश्रण के इस रूप में, प्रत्येक स्रोत को एक घटक प्रायिकता घनत्व फलन द्वारा वर्णित किया गया है और इसका मिश्रण भार इस घटक से एक अवलोकन करने की संभावना है।

मिश्रण मॉडल के अप्रत्यक्ष अनुप्रयोग में हम इस प्रकार के तंत्र को नहीं मानते हैं। मिश्रण मॉडल का उपयोग केवल गणितीय नम्यता के लिए किया जाता है। उदाहरण के लिए, अलग-अलग साधनों के साथ दो सामान्य वितरणों के मिश्रण के परिणामस्वरूप दो मोड (सांख्यिकी) के साथ घनत्व हो सकता है, जो मानक पैरामीट्रिक वितरणों द्वारा प्रतिरूपित नहीं किया जाता है। एक और उदाहरण आधारित गॉसियन की तुलना में सामान्यतः मॉडल को प्रयुक्त करने के लिए मिश्रण वितरण की संभावना की जाती है, ताकि अधिक चरम घटनाओं के मॉडलिंग के लिए उम्मीदवार बन सकें। गतिशील स्थिरता के साथ संयुक्त होने पर, यह दृष्टिकोण स्थानीय अस्थिरता मॉडल के संदर्भ में अस्थिरता की उपस्थिति में वित्तीय अवकलन मूल्यांकन पर प्रयुक्त किया गया है। यह हमारे अनुप्रयोगों को परिभाषित करता है।

पूर्वसूचना अनुरक्षण

पूर्वसूचना अनुरक्षण में मशीन की स्थिति की पहचान करने के लिए मिश्रण मॉडल-आधारित क्लस्टरिंग का भी मुख्य रूप से उपयोग किया जाता है। घनत्व भूखंडों का उपयोग उच्च आयामी सुविधाओं के घनत्व का विश्लेषण करने के लिए किया जाता है। यदि बहु-मॉडल घनत्व देखे जाते हैं, तो यह माना जाता है कि घनत्व का एक परिमित समुच्चय सामान्य मिश्रण के परिमित समुच्चय द्वारा बनता है। एक बहुचर गॉसियन मिश्रण मॉडल का उपयोग आकृति आंकड़ा को समूहों की संख्या में क्लस्टर करने के लिए किया जाता है जहां k मशीन के प्रत्येक स्थिति का प्रतिनिधित्व करती है। मशीन की स्थिति एक सामान्य स्थिति, विद्युत बंद स्थिति या दोषपूर्ण स्थिति हो सकती है।[6] वर्णक्रमीय विश्लेषण जैसी तकनीकों का उपयोग करके प्रत्येक गठित क्लस्टर का निदान किया जा सकता है। हाल के वर्षों में, यह अन्य क्षेत्रों में भी व्यापक रूप से उपयोग किया गया है जैसे कि प्रारम्भिक त्रुटि का पता लगाना आदि सम्मिलित है।[7]

फ़ज़ी छवि विभाजन

छवि प्रसंस्करण और कंप्यूटर विज़न में, पारंपरिक छवि विभाजन मॉडल प्रायः एक पिक्सेल को केवल एक विशिष्ट पैटर्न प्रदान करते हैं। फ़ज़ी या सॉफ्ट विभाजन में, किसी भी पैटर्न का किसी एक पिक्सेल पर निश्चित स्वामित्व हो सकता है। यदि पैटर्न गाऊसी हैं तो फजी विभाजन स्वाभाविक रूप से गाऊसी मिश्रण में परिणाम देता है अन्य विश्लेषणात्मक या ज्यामितीय उपकरणों (जैसे, विसरित सीमाओं पर चरण संक्रमण) के साथ संयुक्त, इस प्रकार के स्थानिक नियमित मिश्रण मॉडल अधिक यथार्थवादी और कम्प्यूटेशनल रूप से कुशल विभाजन विधियों को उत्पन्न कर सकते हैं।[8]

बिन्दु समुच्चय पंजीकरण

प्रायिकतात्मक मिश्रण मॉडल जैसे गाऊसी मिश्रण मॉडल (जीएमएम) का उपयोग छवि प्रसंस्करण और कंप्यूटर दृष्टि क्षेत्रों में बिंदु समुच्चय पंजीकरण समस्याओं को हल करने के लिए किया जाता है। जोड़ी-वार बिंदु समुच्चय पंजीकरण के लिए, एक बिंदु समुच्चय को मिश्रण मॉडल के केन्द्रक के रूप में माना जाता है, और दूसरे बिंदु समुच्चय को आंकड़ा बिंदु (अवलोकन) माना जाता है। अत्याधुनिक तरीके हैं सुसंगत बिंदु प्रवाह (सीपीडी) [9] और छात्र का टी-वितरण मिश्रण मॉडल (टीएमएम) के [10] हाल के शोध के परिणाम हाइब्रिड मिश्रण मॉडल की श्रेष्ठता को प्रदर्शित करते हैं [11] उदाहरण के लिए छात्र के टी-वितरण और वाटसन वितरण / बिंगहैम वितरण को मॉडल मुख्य स्थिति और अक्ष निर्देशन से अलग करना सीपीडी और टीएमएम की तुलना में अंतर्निहित, शुद्धता के संदर्भ में भेदभावपूर्ण क्षमता है।

पहचान योग्यता

पहचान योग्यता का तात्पर्य उस वर्ग (समूह) में किसी एक मॉडल के लिए एक अद्वितीय लक्षण वर्णन के अस्तित्व से है, जिस पर विचार किया जा रहा है कि अनुमान प्रक्रिया अपेक्षाकृत सही रूप से परिभाषित नहीं हो सकती है और यदि कोई मॉडल पहचानने योग्य नहीं है तो अनंतस्पर्शी सिद्धांत धारण नहीं कर सकता है।

उदाहरण

माना कि J, n = 2 के साथ सभी द्विपद समूह का वर्ग है तब J के दो सदस्यों का मिश्रण निम्न हो सकता है:

और p2 = 1 − p0 − p1 स्पष्ट रूप से, p0 और p1 दिए जाने पर, उपरोक्त मिश्रण मॉडल को विशिष्ट रूप से निर्धारित करना संभव नहीं है, क्योंकि निर्धारित करने के लिए तीन पैरामीटर (π, θ1, θ2) हैं।

परिभाषा

समान वर्ग के पैरामीट्रिक वितरणों के मिश्रण पर विचार करें। माना कि -

यदि उपरोक्त सभी घटक वितरणों का वर्ग है तब J का अवमुख समावरक K, J में वितरण के सभी परिमित मिश्रण के वर्ग को परिभाषित करता है:

K को पहचानने योग्य कहा जाता है यदि इसके सभी सदस्य अद्वितीय हैं, अर्थात, K में दो सदस्य p और p′ दिए गए हैं, क्रमशः k वितरण और k′ वितरण का J में मिश्रण होने के कारण हमारे पास p = p′ है यदि और केवल यदि, सबसे पहले, k = k′ और दूसरी तरफ हम योगों को इस प्रकार पुनर्क्रमित कर सकते हैं कि सभी i के लिए ai = ai′' और ƒi = ƒi′ हो।

पैरामीटर अनुमान और प्रणाली पहचान

पैरामीट्रिक मिश्रण मॉडल अक्सर उपयोग किए जाते हैं जब हम वितरण Y जानते हैं और हम X से प्रतिरूप ले सकते हैं, लेकिन हम ai और θi मान निर्धारित करना चाहेंगे। ऐसी स्थितियाँ उन अध्ययनों में उत्पन्न हो सकती हैं जिनमें हम एक ऐसी जनसंख्या से प्रतिरूप होते हैं जो कई अलग-अलग उप-जनसंख्याओं से बने होते है।

प्रायिकतात्मक मिश्रण मॉडलिंग को गुप्त आंकड़ा समस्या के रूप में सोचना सामान्य है। इसे समझने का एक तरीका यह मान लेना है कि जिन आंकड़ा बिंदुओं पर विचार किया जा रहा है, उनमें से किसी एक वितरण में सदस्यता है जिसका उपयोग हम आंकड़ा को मॉडल करने के लिए कर रहे हैं। जब हम प्रारम्भ करते हैं, तो यह सदस्यता अज्ञात होती है या लुप्त होती है। अनुमान का कार्य हमारे द्वारा चयन किए गए मॉडल कार्यों के लिए उपयुक्त पैरामीटर तैयार करना है, आंकड़ा बिंदुओं के संबंध के साथ व्यक्तिगत मॉडल वितरण में उनकी सदस्यता के रूप में प्रतिनिधित्व किया जा रहा है।

मिश्रण अपघटन की समस्या के लिए कई प्रकार के दृष्टिकोण प्रस्तावित किए गए हैं, जिनमें से कई अधिकतम संभावना विधियों पर ध्यान केंद्रित हैं जैसे कि अपेक्षा अधिकतमकरण (ईएम) या अधिकतम पश्च अनुमान (एमएपी) सामान्यतः ये विधियां प्रणाली पहचान और पैरामीटर अनुमान के प्रश्नों पर अलग से विचार करती हैं मिश्रण के भीतर घटकों की संख्या और कार्यात्मक रूप निर्धारित करने के तरीकों को संबंधित पैरामीटर मानों का अनुमान लगाने के तरीकों से अलग किया जाता है। कुछ उल्लेखनीय विचलन टार्टर और लॉक[12] और हाल ही में न्यूनतम संदेश लंबाई (एमएमएल) तकनीकों जैसे कि फिगुएरेडो और जैन[13] और कुछ अन्य मैकविलियम और लोह (2009) द्वारा अनुरूप पैटर्न विश्लेषण दिनचर्या में उल्लिखित ग्राफिकल विधियां हैं।[14]

अपेक्षा अधिकतमकरण (ईएम)

अपेक्षा अधिकतमकरण (ईएम) प्रतीत होता है कि सबसे लोकप्रिय तकनीक है जिसका उपयोग किसी प्राथमिकता वाले घटकों की संख्या के साथ मिश्रण के मापदंडों को निर्धारित करने के लिए किया जाता है। यह इस समस्या के लिए अधिकतम संभावना अनुमान प्रयुक्त करने का एक विशेष प्रकार है। ईएम परिमित सामान्य मिश्रणों के लिए विशेष रूप से अपील करता है जहां विवृत रूप मे अभिव्यक्तियां संभव हैं जैसे डेम्पस्टर पद्धति द्वारा निम्नलिखित पुनरावृत्त कलनविधि में निम्न अभिव्यक्तियां संभव हैं:[15]

पश्च संभावनाओं के साथ

इस प्रकार मापदंडों के लिए वर्तमान अनुमान के आधार पर स्थिति s से उत्पन्न होने वाले किसी दिए गए अवलोकन x(t) के लिए सशर्त संभावना प्रत्येक t = 1, …, N के लिए निर्धारित की जाती है N प्रतिरूप आकार है। मापदंडों को तब अद्यतन किया जाता है जैसे कि नए घटक भार औसत सशर्त संभाव्यता के अनुरूप होते हैं और प्रत्येक घटक माध्य और सहप्रसरण प्रतिरूप के माध्य और सहप्रसरण का घटक विशिष्ट भारित औसत होता है।

डेम्पस्टर पद्धति[15] मे भी यह भी दिखाया गया है कि प्रत्येक क्रमिक ईएम पुनरावृत्ति संभावना को अपेक्षाकृत कम नहीं करता है अन्य प्रवणता आधारित अधिकतमकरण तकनीकों द्वारा साझा नहीं की जाने वाली संपत्ति इसके अतिरिक्त, ईएम स्वाभाविक रूप से प्रायिकतात्मक सदिश पर बाधाओं को अन्तः स्थापित करता है और पर्याप्त रूप से बड़े प्रतिरूप आकार के लिए सहसंयोजक पुनरावृत्तियों की धनात्मक निश्चितता यह एक प्रमुख लाभ है क्योंकि स्पष्ट रूप से विवश विधियों में उपयुक्त मान की जांच और संरक्षण के लिए अतिरिक्त कम्प्यूटेशनल लागत होती हैं। सैद्धांतिक रूप से ईएम एक प्रथम-क्रम एल्गोरिथम है और इस प्रकार धीरे-धीरे एक निश्चित-बिंदु समाधान में परिवर्तित हो जाता है। रेडनर और वाकर (1984)[full citation needed] इस बिंदु को उच्च रैखिक और दूसरे क्रम के न्यूटन और अर्ध-न्यूटन विधियों के पक्ष में तर्क दें और उनके अनुभवजन्य परीक्षणों के आधार पर ईएम में धीमे अभिसरण की रिपोर्ट करें। वे स्वीकार करते हैं कि प्रायिकतात्मक में अभिसरण तीव्र से था यद्यपि पैरामीटर मानों में अभिसरण स्वयं नहीं था। अन्य साहित्य में ईएम और अन्य कलनविधि बनाम अभिसरण के सापेक्ष गुणों पर चर्चा की गई है।[16]

ईएम के उपयोग के लिए अन्य आम आपत्तियां यह हैं कि इसमें स्थानीय मैक्सिमा की प्रतिरूप पहचान करने की प्रवृत्ति है, साथ ही प्रारंभिक मानो के प्रति संवेदनशीलता प्रदर्शित होती है।[17][18] पैरामीटर समष्टि में कई प्रारम्भिक बिंदुओं पर ईएम का मूल्यांकन करके इन समस्याओं का समाधान किया जा सकता है लेकिन यह कम्प्यूटेशनल रूप से कीमती है और अन्य दृष्टिकोण, जैसे कि यूडिया और नाकानो (1998) की एनीलिंग ईएम विधि (जिसमें प्रारंभिक घटकों को अनिवार्य रूप से ओवरलैप करने के लिए जटिल किया जाता है प्रारंभिक अनुमानों के लिए कम विषम आधार प्रदान करना अपेक्षाकृत रूप से अच्छा हो सकता है।

फिगुएरेडो और जैन[12]ध्यान दें कि सीमा पर प्राप्त 'अर्थहीन' पैरामीटर मानों का अभिसरण जहां नियमितता की स्थिति विभाजित हो जाती है, उदाहरण के लिए, घोष और सेन (1985) को प्रायः देखा जाता है जब मॉडल घटकों की संख्या इष्टतम/सही एक से अधिक हो जाती है। इस आधार पर वे अनुमान और पहचान के लिए एक एकीकृत दृष्टिकोण का सुझाव देते हैं जिसमें प्रारंभिक n को अपेक्षित इष्टतम मान से बहुत अधिक चयन किया जाता है। उनका अनुकूलन रूटीन एक न्यूनतम संदेश लंबाई (एमएमएल) मानदंड के माध्यम से बनाया गया है जो एक उम्मीदवार घटक को प्रभावी रूप से समाप्त कर देता है यदि इसका समर्थन करने के लिए अपर्याप्त जानकारी है। इस प्रकार n में विभाजन को व्यवस्थित करना और संयुक्त रूप से अनुमान और पहचान पर विचार करना संभव होता है।

अपेक्षा चरण

मिश्रण मॉडल के मापदंडों के लिए प्रारंभिक अनुमानों के साथ, प्रत्येक घटक वितरण में प्रत्येक आंकड़ा बिंदु की "आंशिक सदस्यता" की गणना प्रत्येक आंकड़ा बिंदु के सदस्यता चर के लिए अपेक्षित मान की गणना करके की जाती है। अर्थात्, प्रत्येक आंकड़ा बिंदु xj और वितरण Yi के लिए, सदस्यता मान yi, j है:

अधिकतम चरण

समूह सदस्यता के लिए अपेक्षित मानों के साथ वितरण मापदंडों के लिए प्रयुक्त अनुमानों की पुन: गणना की जाती है।

मिश्रण गुणांक ai और N आंकड़ा बिंदुओं पर सदस्यता मानों का अर्थ है:

घटक मॉडल पैरामीटर θi की गणना आंकड़ा बिंदु xj का उपयोग करके अपेक्षा अधिकतमकरण द्वारा भी की जाती है जिसे सदस्यता मानों का उपयोग करके भारित किया गया है। उदाहरण के लिए, यदि θ एक माध्य μ है:

ai और θi के लिए नए अनुमानों के साथ, नए सदस्यता मानों की पुनर्गणना करने के लिए अपेक्षा चरण को दोहराया जाता है। पूरी प्रक्रिया तब तक दोहराई जाती है जब तक कि मॉडल पैरामीटर अभिसरण नहीं हो जाते है।

मार्कोव श्रृंखला मॉन्टे कार्लो

ईएम एल्गोरिथम के विकल्प के रूप में, मिश्रण मॉडल पैरामीटर को पश्च प्रतिरूपकरण का उपयोग करके घटाया जा सकता है जैसा कि बेयस प्रमेय द्वारा दर्शाया गया है। यह अभी भी एक अपूर्ण आंकड़ा समस्या के रूप में माना जाता है जिससे आंकड़ा बिंदुओं की सदस्यता लुप्त आंकड़ा है। गिब्स प्रतिरूपकरण के रूप में जानी जाने वाली दो-चरणीय पुनरावृत्ति प्रक्रिया का उपयोग किया जा सकता है।

दो गाऊसी वितरणों के मिश्रण का पिछला उदाहरण प्रदर्शित कर सकता है कि विधि कैसे कार्य करती है। पहले की तरह, मिश्रण मॉडल के लिए प्राचलों का प्रारंभिक अनुमान लगाया जाता है। प्रत्येक मौलिक वितरण के लिए आंशिक सदस्यता की गणना करने के अतिरिक्त प्रत्येक आंकड़ा बिंदु के लिए एक सदस्यता मान बर्नौली वितरण से तैयार किया जाता है (अर्थात, इसे पहले या दूसरे गॉसियन को निर्धारित किया जाएगा)। बर्नौली पैरामीटर θ घटक वितरण में से एक के आधार पर प्रत्येक आंकड़ा बिंदु के लिए निर्धारित किया जाता है।[vague] वितरण से कर्षण को प्रत्येक आंकड़ा बिंदु के लिए सदस्यता संघों को उत्पन्न करता है। निर्धारित अनुमानकों का उपयोग ईएम के M चरण के रूप में मिश्रण मॉडल पैरामीटर का एक नया समूह उत्पन्न करने के लिए किया जा सकता है और द्विपद कर्षण चरण को दोहराया जाता है।

क्षण अनुरूपण

क्षणों की विधि (सांख्यिकी) 1894 के कार्ल पियर्सन के सेमिनल कार्य से संबंधित मिश्रण मापदंडों को निर्धारित करने के लिए सबसे पुरानी तकनीकों में से एक है। इस दृष्टिकोण में मिश्रण के पैरामीटर इस प्रकार निर्धारित किए जाते हैं कि समग्र वितरण में कुछ दिए गए मान के अनुरूपण क्षण होते हैं। कई उदाहरणों में पल समीकरणों के समाधान निकालने से गैर-तुच्छ बीजगणितीय या कम्प्यूटेशनल समस्याएं हो सकती हैं। इसके अतिरिक्त, दिन के अनुसार से संख्यात्मक विश्लेषण[19] ने संकेत दिया है कि ईएम की तुलना में ऐसी विधियां अक्षम हो सकती हैं। जो इस पद्धति में नए सिरे से रुचि दिखाई गई है, उदाहरण के लिए, क्रेगमील और टिटरिंगटन (1998) और वांग[20], मैकविलियम और लोह (2009) बड़े आयामी प्रणालियों में एक हाइपर-क्यूबॉइड सामान्य मिश्रण कोप्युला (सांख्यिकी) के लक्षण वर्णन पर विचार करते हैं जिसके लिए ईएम कम्प्यूटेशनल रूप से निषेधात्मक होता है यहाँ एक पैटर्न विश्लेषण रूटीन का उपयोग बहुचर पूंछ-निर्भरता उत्पन्न करने के लिए किया जाता है, जो एक प्रकार के अविभाजित और (कुछ अर्थों में) द्विभाजित क्षणों के अनुरूप होता है। इस पद्धति के प्रदर्शन का मूल्यांकन कोलमोगोरोव-स्मिर्नोव परीक्षण आंकड़ों के साथ निर्दिष्ट अभिलेखित आंकड़ा का उपयोग करके किया जाता है जो एक अच्छा वर्णनात्मकता का सुझाव देता है।

वर्णक्रमीय विधि

वर्णक्रमीय विधियों का उपयोग करके मिश्रण मॉडल के आकलन में कुछ समस्याओं को हल किया जा सकता है। विशेष रूप से यह उपयोगी हो जाता है यदि आंकड़ा बिंदु xi है उच्च-आयामी वास्तविक समन्वय समष्टि में बिंदु हैं और छिपे हुए वितरण को लघुगणक रूप से अवतल कार्य लघुगणक-अवतल (जैसे गॉसियन वितरण या घातीय वितरण) के रूप में जाना जाता है। प्रशिक्षण के मिश्रण मॉडल के वर्णक्रमीय तरीके एक आव्यूह के एकल मान अपघटन के उपयोग पर आधारित होते हैं जिसमें आंकड़ा बिंदु होते हैं। विचार शीर्ष k एकल सदिश पर विचार करना है, जहाँ k प्रक्षेपण के लिए वितरण की संख्या है। प्रत्येक आंकड़ा बिंदु उन सदिश समूहों द्वारा विस्तृत एक रेखीय उप-समष्टि की ओर संकेत करता है जो समान वितरण से उत्पन्न होते हैं और एक साथ बहुत निकट होते हैं, जबकि विभिन्न वितरणों के अंक दूर-दूर रहते हैं।

वर्णक्रमीय पद्धति की एक विशिष्ट विशेषता यह है कि यह हमें गणितीय प्रमाण की स्वीकृति प्राप्त होती है कि यदि निश्चित विभाजन की स्थिति को पूरा करते हैं उदाहरण के लिए, बहुत निकट नहीं है तो अनुमानित मिश्रण उच्च संभावना के साथ बहुत निकट हो सकता है।

ग्राफिकल तरीके

टार्टर और लॉक[13]मिश्रण पहचान के लिए एक ग्राफिकल दृष्टिकोण का वर्णन करें जिसमें एक कर्नेल फलन को अनुभवजन्य आवृत्ति प्लॉट पर प्रयुक्त किया जाता है ताकि अतः-घटक भिन्नता को कम किया जा सके। इस प्रकार अलग-अलग साधनों वाले घटकों की अधिक आसानी से पहचान की जा सकती है। हालांकि इस λ-पद्धति को घटकों की संख्या या कार्यात्मक रूप के पूर्व ज्ञान की आवश्यकता नहीं होती है लेकिन इसकी सफलता कर्नेल पैरामीटर की रुचि पर निर्भर करती है जो कुछ अपेक्षाकृत घटक संरचना के विषय में धारणाओं को अंतः स्थापित करती है।

अन्य तरीके

उनमें से कुछ लगभग भारी-पुच्छल वाले वितरणों के मिश्रण को भी सीख सकते हैं जो अनंत भिन्नता वाले हैं (नीचे दस्तावेज़ के लिंक देखें)। इस सेटिंग में, ईएम आधारित तरीके कार्य नहीं करेंगे, क्योंकि बाहरी परत की उपस्थिति के कारण अपेक्षा चरण भिन्न हो सकता है।

अनुकरण

आकार N के एक प्रतिरूप का अनुकरण करने के लिए जो कि वितरण Fi, i = 1 से n के मिश्रण से है, प्रायिकता pi (sum = pi = 1) के साथ:

- आकार n के एक स्पष्ट वितरण से N यादृच्छिक संख्या उत्पन्न करें और i = 1 = से n के लिए संभावनाएँ pi ये आपको बताते हैं कि प्रत्येक एन मान किस Fi से आएगा। ith श्रेणी को दी गई यादृच्छिक संख्याओं की मात्रा को mi से निरूपित करें।

- प्रत्येक i के लिए, Fi वितरण से mi यादृच्छिक संख्याएँ उत्पन्न करें।

विस्तारण

बायेसियन अनुमान में, मिश्रण मॉडल को परिभाषित करने वाले ग्राफिकल मॉडल में अतिरिक्त स्तर को संबद्ध किया जा सकता हैं उदाहरण के लिए, सामान्य अव्यक्त डिरिचलेट आवंटन विषय मॉडल में, अवलोकन D विभिन्न दस्तावेज़ों से लिए गए शब्दों के समूह हैं और K मिश्रण घटक उन विषयों का प्रतिनिधित्व करते हैं जो दस्तावेज़ों में साझा किए जाते हैं। प्रत्येक दस्तावेज़ में मिश्रण भार का एक अलग समूह होता है, जो उस दस्तावेज़ में प्रचलित विषयों को निर्दिष्ट करता है। मिश्रण भार के सभी समूह सामान्य हाइपर पैरामीटर को झा करते हैं।

यह मानने के अतिरिक्त कि वे स्वतंत्र रूप से समान रूप से वितरित यादृच्छिक चर हैं, एक मार्कोव श्रृंखला में मिश्रण घटक पहचान को परिभाषित करने वाले अव्यक्त चर को जोड़ने के लिए एक बहुत ही सामान्य विस्तार है। परिणामी मॉडल को एक छिपा हुआ मार्कोव मॉडल कहा जाता है और यह सबसे सामान्य नुक्रमिक श्रेणीबद्ध मॉडल में से एक है। छिपे हुए मार्कोव मॉडल के कई विस्तार विकसित किए गए हैं अधिक जानकारी के लिए परिणामी लेख देखें।

इतिहास

मिश्रण वितरण और मिश्रण अपघटन की समस्या, जो कि इसके घटकों और उसके मापदंडों की पहचान है जिसका साहित्य में 1846 (मैकलचैन में क्वेटलेट 2000) तक वापस उद्धृत किया गया है।[17] हालांकि सामान्य संदर्भ इसके लिए बनाया गया है कार्ल पियर्सन (1894) का कार्य पहले लेखक के रूप में मादा किनारे केकड़े की आबादी में माथे से शरीर की लंबाई के अनुपात की गैर-सामान्य विशेषताओं को स्पष्ट रूप से संबोधित करने के लिए अपघटन समस्या को संबोधित करता है। इस कार्य के लिए प्रेरणा प्राणी विज्ञानी वाल्टर फ्रैंक राफेल वेल्डन द्वारा प्रदान की गई थी जिन्होंने 1893 में अनुमान लगाया था (टार्टर और लॉक[13] में) कि इन अनुपातों के हिस्टोग्राम में विषमता विकासवादी विचलन का संकेत दे सकती है। पियर्सन का दृष्टिकोण मिश्रण के पांच मापदंडों को चुनकर आंकड़ा में दो मानदंडों के एक अविभाज्य मिश्रण को प्रयुक्त करना था जैसे कि अनुभवजन्य क्षण मॉडल के अनुरूप थे।

जबकि उनका कार्य दो संभावित अलग-अलग उप-जनसंख्या की पहचान करने में सफल रहा और एक क्षण अनुरूपण उपकरण के रूप में मिश्रण की नम्यता को प्रदर्शित करने में सूत्रीकरण के लिए 9वीं डिग्री (नॉनिक) बहुपद के समाधान की आवश्यकता थी जो उस समय एक महत्वपूर्ण कम्प्यूटेशनल चुनौती थी। इसके बाद के कार्यों ने इन समस्याओं को दूर करने पर ध्यान केंद्रित किया, लेकिन यह तब तक नहीं था जब तक कि आधुनिक कंप्यूटर का आगमन और अधिकतम संभावना (एमएलई) प्राचलीकरण तकनीकों का लोकप्रियकरण नहीं हो गया था, जो वास्तव में शोध से दूर हो गए थे।[21] उस समय से मत्स्य, कृषि, वनस्पति विज्ञान, अर्थशास्त्र, चिकित्सा, आनुवंशिकी, मनोविज्ञान, जीवाश्म विज्ञान, वैद्युतकण संचलन, वित्त, भूविज्ञान और जीव विज्ञानं जैसे क्षेत्रों में विस्तृत इस विषय पर शोध का एक विशाल निकाय रहा है।[22]

यह भी देखें

मिश्रण

वर्गीकृत मॉडल

- ग्राफिकल मॉडल

- वर्गीकृत बेयस मॉडल

बाहरी पहचान

संदर्भ

- ↑ Chatzis, Sotirios P.; Kosmopoulos, Dimitrios I.; Varvarigou, Theodora A. (2008). "टी वितरण के आधार पर एक मजबूत अव्यक्त अंतरिक्ष मॉडल का उपयोग करके सिग्नल मॉडलिंग और वर्गीकरण". IEEE Transactions on Signal Processing. 56 (3): 949–963. doi:10.1109/TSP.2007.907912. S2CID 15583243.

- ↑ Yu, Guoshen (2012). "Solving Inverse Problems with Piecewise Linear Estimators: From Gaussian Mixture Models to Structured Sparsity". IEEE Transactions on Image Processing. 21 (5): 2481–2499. arXiv:1006.3056. Bibcode:2012ITIP...21.2481G. doi:10.1109/tip.2011.2176743. PMID 22180506. S2CID 479845.

- ↑ Dinov, ID. "Expectation Maximization and Mixture Modeling Tutorial". California Digital Library, Statistics Online Computational Resource, Paper EM_MM, http://repositories.cdlib.org/socr/EM_MM, December 9, 2008

- ↑ Bishop, Christopher (2006). पैटर्न मान्यता और मशीन प्रवीणता. New York: Springer. ISBN 978-0-387-31073-2.

- ↑ Spall, J. C. and Maryak, J. L. (1992). "A feasible Bayesian estimator of quantiles for projectile accuracy from non-i.i.d. data." Journal of the American Statistical Association, vol. 87 (419), pp. 676–681. JSTOR 2290205

- ↑ Amruthnath, Nagdev; Gupta, Tarun (2018-02-02). मॉडल-आधारित क्लस्टरिंग दृष्टिकोण का उपयोग करके अनपर्यवाइज्ड लर्निंग में फॉल्ट क्लास प्रेडिक्शन. Unpublished. doi:10.13140/rg.2.2.22085.14563.

- ↑ Amruthnath, Nagdev; Gupta, Tarun (2018-02-01). प्रिडिक्टिव मेंटेनेंस में फॉल्ट डिटेक्शन के लिए अनसुपरवाइज्ड मशीन लर्निंग एल्गोरिदम पर एक शोध अध्ययन. Unpublished. doi:10.13140/rg.2.2.28822.24648.

- ↑ Shen, Jianhong (Jackie) (2006). "A stochastic-variational model for soft Mumford-Shah segmentation". International Journal of Biomedical Imaging. 2006: 2–16. Bibcode:2006IJBI.200649515H. doi:10.1155/IJBI/2006/92329. PMC 2324060. PMID 23165059.

- ↑ Myronenko, Andriy; Song, Xubo (2010). "Point set registration: Coherent point drift". IEEE Trans. Pattern Anal. Mach. Intell. 32 (12): 2262–2275. arXiv:0905.2635. doi:10.1109/TPAMI.2010.46. PMID 20975122. S2CID 10809031.

- ↑ Ravikumar, Nishant; Gooya, Ali; Cimen, Serkan; Frangi, Alexjandro; Taylor, Zeike (2018). "Group-wise similarity registration of point sets using Student's t-mixture model for statistical shape models". Med. Image Anal. 44: 156–176. doi:10.1016/j.media.2017.11.012. PMID 29248842.

- ↑ Bayer, Siming; Ravikumar, Nishant; Strumia, Maddalena; Tong, Xiaoguang; Gao, Ying; Ostermeier, Martin; Fahrig, Rebecca; Maier, Andreas (2018). "Intraoperative brain shift compensation using a hybrid mixture model". Medical Image Computing and Computer Assisted Intervention – MICCAI 2018. Granada, Spain: Springer, Cham. pp. 116–124. doi:10.1007/978-3-030-00937-3_14.

- ↑ 12.0 12.1 Figueiredo, M.A.T.; Jain, A.K. (March 2002). "परिमित मिश्रण मॉडल की अनपर्यवेक्षित शिक्षा". IEEE Transactions on Pattern Analysis and Machine Intelligence. 24 (3): 381–396. CiteSeerX 10.1.1.362.9811. doi:10.1109/34.990138.

- ↑ 13.0 13.1 13.2 Tarter, Michael E. (1993), Model Free Curve Estimation, Chapman and Hall

- ↑ McWilliam, N.; Loh, K. (2008), Incorporating Multidimensional Tail-Dependencies in the Valuation of Credit Derivatives (Working Paper) [1]

- ↑ 15.0 15.1 Dempster, A.P.; Laird, N.M.; Rubin, D.B. (1977). "ईएम एलगोरिद्म द्वारा आंशिक डेटा से अधिकतम संभावना है". Journal of the Royal Statistical Society, Series B. 39 (1): 1–38. CiteSeerX 10.1.1.163.7580. JSTOR 2984875.

- ↑ Xu, L.; Jordan, M.I. (January 1996). "गॉसियन मिश्रण के लिए ईएम एल्गोरिथम के अभिसरण गुणों पर". Neural Computation. 8 (1): 129–151. doi:10.1162/neco.1996.8.1.129. hdl:10338.dmlcz/135225. S2CID 207714252.

- ↑ 17.0 17.1 McLachlan, G.J. (2000), Finite Mixture Models, Wiley

- ↑ Botev, Z.I.; Kroese, D.P. (2004). Global likelihood optimization via the cross-entropy method with an application to mixture models. p. 517. CiteSeerX 10.1.1.331.2319. doi:10.1109/WSC.2004.1371358. ISBN 978-0-7803-8786-7. S2CID 6880171.

{{cite book}}:|journal=ignored (help) - ↑ Day, N. E. (1969). "सामान्य वितरण के मिश्रण के घटकों का अनुमान लगाना". Biometrika. 56 (3): 463–474. doi:10.2307/2334652. JSTOR 2334652.

- ↑ Wang, J. (2001), "Generating daily changes in market variables using a multivariate mixture of normal distributions", Proceedings of the 33rd Winter Conference on Simulation: 283–289

- ↑ {{citation |title=Mixture Models: inference and applications to clustering |journal=Statistics: Textbooks and Monographs |first1=G.J. |last1=McLachlan |first2=K.E. |last2=Basford |date=1988 |bibcode=1988mmia.book.....M }

- ↑ Titterington, Smith & Makov 1985

अग्रिम पठन

मिश्रण मॉडल पर पुस्तकें

- Everitt, B.S.; Hand, D.J. (1981). परिमित मिश्रण वितरण. Chapman & Hall. ISBN 978-0-412-22420-1.

- Lindsay, B. G. (1995). मिश्रण मॉडल: सिद्धांत, ज्यामिति और अनुप्रयोग. NSF-CBMS Regional Conference Series in Probability and Statistics. Vol. 5. Hayward: Institute of Mathematical Statistics.

- Marin, J.M.; Mengersen, K.; Robert, C. P. (2011). "Bayesian modelling and inference on mixtures of distributions" (PDF). In Dey, D.; Rao, C.R. (eds.). आवश्यक बायेसियन मॉडल. Handbook of statistics: Bayesian thinking - modeling and computation. Vol. 25. Elsevier. ISBN 9780444537324.

- McLachlan, G.J.; Peel, D. (2000). परिमित मिश्रण मॉडल. Wiley. ISBN 978-0-471-00626-8.

- Press, WH; Teukolsky, SA; Vetterling, WT; Flannery, BP (2007). "Section 16.1. Gaussian Mixture Models and k-Means Clustering". संख्यात्मक व्यंजनों: वैज्ञानिक कंप्यूटिंग की कला (3rd ed.). New York: Cambridge University Press. ISBN 978-0-521-88068-8.

- Titterington, D.; Smith, A.; Makov, U. (1985). परिमित मिश्रण वितरण का सांख्यिकीय विश्लेषण. Wiley. ISBN 978-0-471-90763-3.

गाऊसी मिश्रण मॉडल का अनुप्रयोग

- Reynolds, D.A.; Rose, R.C. (January 1995). "गॉसियन मिश्रण स्पीकर मॉडल का उपयोग करके मजबूत पाठ-स्वतंत्र वक्ता पहचान". IEEE Transactions on Speech and Audio Processing. 3 (1): 72–83. doi:10.1109/89.365379.

- Permuter, H.; Francos, J.; Jermyn, I.H. (2003). छवि डेटाबेस पुनर्प्राप्ति के लिए बनावट और रंग के गॉसियन मिश्रण मॉडल. IEEE International Conference on Acoustics, Speech, and Signal Processing, 2003. Proceedings (ICASSP '03). doi:10.1109/ICASSP.2003.1199538.

- Permuter, Haim; Francos, Joseph; Jermyn, Ian (2006). "छवि वर्गीकरण और विभाजन के लिए रंग और बनावट सुविधाओं के गॉसियन मिश्रण मॉडल का अध्ययन" (PDF). Pattern Recognition. 39 (4): 695–706. Bibcode:2006PatRe..39..695P. doi:10.1016/j.patcog.2005.10.028. S2CID 8530776.

- Lemke, Wolfgang (2005). टर्म स्ट्रक्चर मॉडलिंग एंड एस्टीमेशन इन ए स्टेट स्पेस फ्रेमवर्क. Springer Verlag. ISBN 978-3-540-28342-3.

- Brigo, Damiano; Mercurio, Fabio (2001). एनालिटिकली-ट्रैक्टेबल स्माइल मॉडल्स के लिए डिसप्लेस्ड एंड मिक्सचर डिफ्यूज़न. Mathematical Finance – Bachelier Congress 2000. Proceedings. Springer Verlag.

- Brigo, Damiano; Mercurio, Fabio (June 2002). "तार्किक-मिश्रण गतिकी और बाजार की अस्थिरता के लिए अंशांकन मुस्कान". International Journal of Theoretical and Applied Finance. 5 (4): 427. CiteSeerX 10.1.1.210.4165. doi:10.1142/S0219024902001511.

- Spall, J. C.; Maryak, J. L. (1992). "गैर-i.i.d से प्रक्षेप्य सटीकता के लिए क्वांटाइल्स का एक व्यवहार्य बायेसियन अनुमानक। आंकड़े". Journal of the American Statistical Association. 87 (419): 676–681. doi:10.1080/01621459.1992.10475269. JSTOR 2290205.

- Alexander, Carol (December 2004). "अनिश्चित अस्थिरता के साथ सामान्य मिश्रण प्रसार: मॉडलिंग लघु और दीर्घकालिक मुस्कान प्रभाव" (PDF). Journal of Banking & Finance. 28 (12): 2957–80. doi:10.1016/j.jbankfin.2003.10.017.

- Stylianou, Yannis; Pantazis, Yannis; Calderero, Felipe; Larroy, Pedro; Severin, Francois; Schimke, Sascha; Bonal, Rolando; Matta, Federico; Valsamakis, Athanasios (2005). जीएमएम-आधारित मल्टीमॉडल बायोमेट्रिक सत्यापन (PDF).

- Chen, J.; Adebomi, 0.E.; Olusayo, O.S.; Kulesza, W. (2010). बहु-लक्ष्य ट्रैकिंग के लिए गॉसियन मिश्रण संभावना परिकल्पना घनत्व दृष्टिकोण का मूल्यांकन. IEEE International Conference on Imaging Systems and Techniques, 2010. doi:10.1109/IST.2010.5548541.

बाहरी संबंध

- Nielsen, Frank (23 March 2012). "K-MLE: A fast algorithm for learning statistical mixture models". k-MLE: A fast algorithm for learning statistical mixture models. pp. 869–872. arXiv:1203.5181. Bibcode:2012arXiv1203.5181N. doi:10.1109/ICASSP.2012.6288022. ISBN 978-1-4673-0046-9. S2CID 935615.

{{cite book}}:|journal=ignored (help) - The SOCR demonstrations of EM and Mixture Modeling

- Mixture modelling page (and the Snob program for Minimum Message Length (MML) applied to finite mixture models), maintained by D.L. Dowe.

- PyMix – Python Mixture Package, algorithms and data structures for a broad variety of mixture model based data mining applications in Python

- sklearn.mixture – A module from the scikit-learn Python library for learning Gaussian Mixture Models (and sampling from them), previously packaged with SciPy and now packaged as a SciKit

- GMM.m Matlab code for GMM Implementation

- GPUmix C++ implementation of Bayesian Mixture Models using EM and MCMC with 100x speed acceleration using GPGPU.

- [2] Matlab code for GMM Implementation using EM algorithm

- [3] jMEF: A Java open source library for learning and processing mixtures of exponential families (using duality with Bregman divergences). Includes a Matlab wrapper.

- Very Fast and clean C implementation of the Expectation Maximization (EM) algorithm for estimating Gaussian Mixture Models (GMMs).

- mclust is an R package for mixture modeling.

- dpgmm Pure Python Dirichlet process Gaussian mixture model implementation (variational).

- Gaussian Mixture Models Blog post on Gaussian Mixture Models trained via Expectation Maximization, with an implementation in Python.